Как социальные сети должны реагировать на дезинформацию?

Опубликовано: 2022-03-09Как общество, у нас сложные отношения с социальными сетями. Когда мы слышим об онлайн-издевательствах, дезинформации и разжигании ненависти, мы справедливо осуждаем уродливую тень, которую они отбрасывают на общество. Но когда Россия блокирует Facebook в попытке контролировать нарратив вокруг Украины, создается впечатление, что у нее отнимают фундаментальное право человека.

Наше замешательство связано с конфликтом ценностей: свобода выражения против свободы от вреда. И это один из самых важных споров нашего времени. Но это также дискуссия, которая стала чрезмерно упрощенной, поляризованной и межплеменной.

Каковы две стороны этого спора?

Одна сторона — это абсолютисты свободы слова, которые не хотят никаких правил. Они способствовали появлению новых платформ социальных сетей, таких как «Truth Social» Габа и Дональда Трампа, которые не имеют ограничений на то, что вы публикуете. Они быстро скатились к белому национализму, антисемитизму и теориям заговора QAnon.

Другая сторона стремится к усилению государственного регулирования социальных сетей. Это привело к появлению новых инициатив, таких как Google Fact Check, Good Information Inc и Trusted News Summit, которые стремятся проверить, что правда. Эта сторона часто недооценивает риски наделения государства полномочиями контролировать интернет. Примерами того, как это может пойти не так, являются репрессии в социальных сетях политическими режимами, стремящимися контролировать свободный поток информации.

На примере Meta (я использую «Facebook», чтобы выделить конкретную платформу социальных сетей) я рассмотрю обе стороны дебатов и предложу решение, направленное на разрешение конфликта ценностей.

Фейсбук под огнем

Почти четверть населения мира пользуется Facebook, что делает его самой популярной социальной сетью в мире.

Но доверие к заявленной ими миссии «создавать сообщество и сближать мир» недавно подверглось критике.

Информаторы обвинили Facebook в сознательном выборе прибыли, а не общества; Они утверждают, что, распространяя дезинформацию, Facebook подрывает целостность демократического процесса. Кроме того, утверждается, что дезинформация в социальных сетях ослабила способность общества эффективно реагировать на пандемию.

Марк Цукерберг ответил следующим образом:

«Идея о том, что мы позволяем дезинформации накапливаться на нашей платформе или что мы каким-то образом извлекаем выгоду из этого контента, неверна».

Защита Facebook заключается в том, что у них больше партнеров по проверке фактов, чем у любой другой технологической платформы. Их усилия, безусловно, впечатляют: ежемесячно они удаляют более 5 миллионов единиц ненавистного контента.

Facebook также укажет вам на свои стандарты сообщества, в которых перечислены 4 типа контента, в отношении которых они могут принимать меры:

- Насильственное и преступное поведение

- Проблемы безопасности (например, издевательства, жестокое обращение с детьми, эксплуатация)

- Нежелательный контент, например порнография и разжигание ненависти.

- Неаутентичный контент (например, дезинформация)

Из них мало разногласий по пунктам с 1 по 3. Существует широкое согласие в том, что Facebook должен действовать для предотвращения вреда от насилия, издевательств и разжигания ненависти.

Это пункт 4, дезинформация, который является спорным.

Рост дезинформации

Иногда кажется, что мы готовы одновременно верить всему и ничему.

И это чувство не ново.

В 1835 году газета New York Sun заявила, что на Луне существует инопланетная цивилизация. Он продавался так хорошо, что сделал New York Sun ведущим изданием.

Однако целенаправленная дезинформация как форма психологического контроля только усилилась с появлением цифровых коммуникаций.

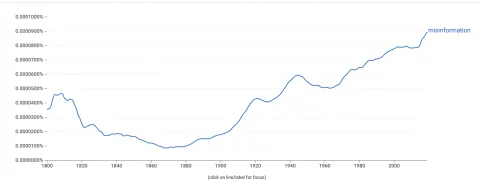

Средство просмотра Google Ngram, измеряющее частоту появления слов в книгах, показывает резкий рост использования нами слова «дезинформация».  Чтобы понять это, мы должны понять, как распространяется дезинформация.

Чтобы понять это, мы должны понять, как распространяется дезинформация.

Алгоритмы Facebook оптимизированы для взаимодействия — это часто продвигает контент, который вызывает сильную эмоциональную реакцию. Для алгоритма важна вовлеченность, а не достоверность передаваемой информации.

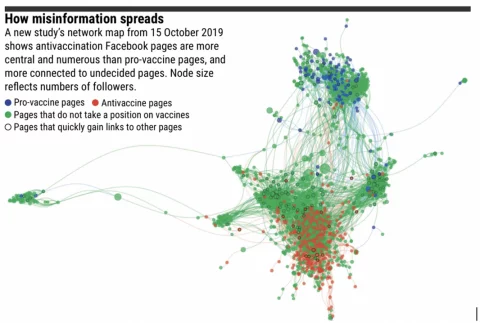

Интересно, что дезинформация не распространяется далеко, когда эхо-камер мало. Контент будет распространяться до тех пор, пока пользователь, который с ним не согласен, впоследствии проверит его и разоблачит как дезинформацию.

Однако онлайн-группы все больше разделяются по идеологическим убеждениям. В этих пузырях дезинформация может далеко распространяться по сети, не встречая сопротивления.

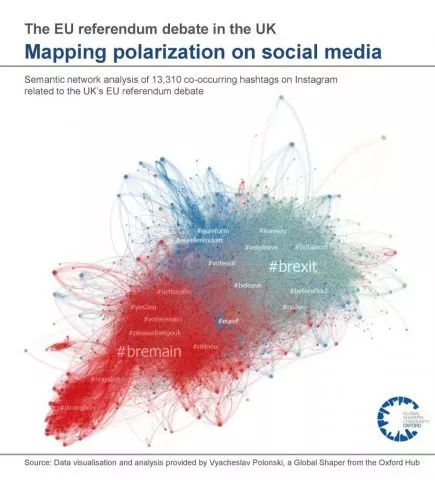

Ниже представлено визуальное представление эхо-камер дебатов по референдуму о выходе Великобритании из ЕС:

Предвзятость подтверждения — это наша склонность искать и верить информации, которая согласуется с нашими существующими взглядами. Психологам известно, что однажды приняв решение, его трудно изменить. Таким образом, вместо этого дезинформация направлена на использование алгоритмов, эхо-камер и предвзятости подтверждения для усиления и укрепления существующих взглядов . Это может привести к экстремизму.

Это особенно проблематично, когда это выплескивается в реальный мир.

Примеры реального воздействия дезинформации:

- Атаки на Капитолий в 2021 году, уходящие корнями в теорию заговора QAnon

- Сорванные выборы в таких странах, как Гана, Нигерия, Тонго, Тунис и Голландия

- Нехватка вакцин против Covid-19 связана с различными источниками дезинформации

- Смерти в Шарлоттсвилле, спровоцированные правыми экстремистскими форумами

- Стрельба из пиццы, также имеющая корни в QAnon

Кроме того, было обнаружено, что дезинформация подрывает наше доверие к институтам и распространяет ложную науку, что влияет на общественное здравоохранение и подрывает демократический процесс.

Итак, какие действия следует предпринять?

Аргумент против цензуры

Чтобы бороться с вредом дезинформации, защитники выступают за более активное вмешательство государства для регулирования социальных сетей и удаления дезинформации.

Например, глава Организации Объединенных Наций, генеральный секретарь Антониу Гутерриш призвал к глобальным правилам регулирования контента в социальных сетях.

«Я не думаю, что мы можем жить в мире, где слишком много власти отдано меньшему числу компаний. Нам нужна новая нормативно-правовая база с правилами, позволяющими делать это в соответствии с законом».

~ Глава Организации Объединенных Наций, Генеральный секретарь Антониу Гутерриш

Трудно не согласиться с настроением, стоящим за этим утверждением. Без надлежащих проверок мощь технологических компаний может выйти из-под нашего контроля.

Однако, прежде чем мы предоставим полномочия органам, которые позволят им решать, какую информацию мы потребляем, мы должны рассмотреть потенциальные недостатки.

Во-первых, цензура сообщений в социальных сетях может быть нарушением статьи Закона о правах человека, которая гласит:

«Каждый человек имеет право на свободу выражения мнений. Это право включает свободу придерживаться своего мнения и свободу получать и распространять информацию и идеи без вмешательства со стороны государственной власти».

~ Статья 10 Закона о правах человека

Интересно, что правительство Великобритании в настоящее время ищет возможность реформировать Закон о правах человека, заменив его «Биллем о правах».

Одно из предложенных изменений заключается в том, что права человека могут быть нарушены, если это «защищает более широкие общественные интересы» (стр. 56, Реформа прав человека). Это изменение может позволить государству усилить цензуру дезинформации.

Второй аргумент против цензуры дезинформации заключается в том, что ею могут злоупотреблять политические режимы, стремящиеся централизовать власть. Право решать, что является дезинформацией, а что нет, может привести к подавлению протестов, коллективных действий и политической активности.

Могла ли «арабская весна» случиться, если бы Twitter и Facebook находились под контролем властей?

Хотя журналисты, вероятно, преувеличивают роль социальных сетей в «арабской весне», тщательный академический анализ показал, что социальные сети действительно привели к активизации позитивных коллективных действий в странах с репрессивными правительствами.

Кроме того, мы можем посмотреть на послужной список стран, которые запретили платформы социальных сетей:

- Китай

- Россия

- Иран

- Северная Корея

Все эти страны перечислены в «Индексе свободы в мире» как имеющие одни из худших гражданских свобод в мире. Я не утверждаю, что у них плохие гражданские свободы, потому что они не разрешают социальные сети, а скорее наблюдаю, что государства, которые пытаются контролировать информацию в Интернете, как правило, имеют плохую репутацию, когда речь идет о правах человека.

Даже если государственная цензура не решает проблему, у нас есть проблема.

Доверие к традиционным источникам новостей быстро испаряется. В этот вакуум устремляется дезинформация, создавая достаточно сильный ветер, который лишает нас понимания того, что является правдой. Это нанесло ущерб обществу из-за нерешительности в отношении вакцин, роста экстремизма и нарушения демократических процессов.

Но рефлекторная реакция с передачей государству права решать, что является правдой, может причинить больший вред, чем дезинформация.

И вообще, это, скорее всего, нарушение прав человека.

Проблемы с решением Facebook

Цель Facebook — предотвратить регулирование со стороны правительств посредством саморегулирования.

Их стратегия борьбы с дезинформацией включает в себя:

- Применение машинного обучения для обнаружения дезинформации

- Команды реагирования на изменение фактов помеченного контента

- Партнерство со сторонними организациями по проверке фактов для проверки контента

Однако сами Facebook признают ограничения этого в значительной степени автоматизированного подхода. Например, как автоматизированная программа определит разницу между сатирическими веб-сайтами и преднамеренной дезинформацией?

Кроме того, огромное количество кликбейтов существует с единственной целью превращения кликов в доходы от рекламы. Они часто используют сайты-шаблоны, которые выглядят как официальные новостные сайты с заманчивыми заголовками, часто обманывая зрителей и заставляя их кликать.

Эти сайты не являются дезинформацией, но и не являются надежными источниками информации.

Между сатирой и кликбейтом есть колонки светской хроники и журналистика мнений. Это «легитимные» СМИ, не претендующие на объективность. Например, правый американский комментатор Бен Шапиро открыто признает, что его новостной веб-сайт The Daily Wire существует не для того, чтобы сообщать новости, а для того, чтобы «выиграть культурную войну». Обман и преувеличение, типичные для этих издателей, являются серой зоной для автоматизированных программ, ищущих дезинформацию.

Марк Цукерберг недавно сказал, что «Facebook делает больше для борьбы с дезинформацией, чем любая другая компания». Он может быть прав. Но достаточно ли?

Предлагаемое решение

Мы видели, как решение дезинформации — это конфликт ценностей: свобода выражения против свободы от вреда. Любое решение должно быть направлено на уравновешивание этих двух факторов.

Я предлагаю потенциальное решение только в качестве мысленного эксперимента — ведь легче выискивать дыры в чужой работе и намного сложнее предложить что-то самому. По общему признанию, это не моя область знаний, и любые предложения будут в лучшем случае непрактичными!

С учетом этой оговорки я бы предложил три пункта:

- Не пытайтесь подвергать цензуре дезинформацию в сообщениях человека в социальных сетях.

- Алгоритмически продвигайте авторитетный контент вместо участия

- Предельные эхо-камеры

1. Отсутствие цензуры дезинформации в сообщениях отдельных лиц.

Это защищает права человека человека. Он также защищает активистов, которые хотят использовать социальные сети для мобилизации против репрессивных политических режимов.

Но это не свобода слова любой ценой.

Facebook должен продолжать удалять контент, поощряющий агрессивное поведение, издевательства, эксплуатацию и ненавистнические высказывания.

2. Продвижение авторитетного контента вместо привлекательного

Алгоритм Facebook «EdgeRank» определяет, какой контент отображается в вашей ленте новостей и в каком порядке.

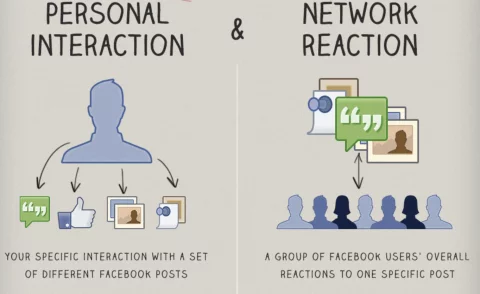

Он стремится персонализировать вашу ленту за счет сочетания ваших личных интересов с тем, как более широкое сообщество взаимодействовало с конкретной публикацией.

Алгоритм Facebook продвигает контент с высокой вовлеченностью. Часто это работает хорошо, и вы видите посты от друзей и семьи, а также вирусные мемы и видео с кошками. Однако тот же самый механизм также продвигает эмоциональное содержание, которое часто вызывает разногласия или не соответствует действительности.

Однако алгоритм можно адаптировать для работы аналогично алгоритму Google PageRank.

Google продвигает авторитетный, а не привлекательный контент. Это делается путем анализа того, сколько раз другие веб-сайты ссылаются на часть контента в виде гиперссылок или «обратных ссылок». Например, то, что я отсылаю вас к этой подробной разбивке того, как работает алгоритм Google PageRank, является показателем надежности этой страницы.

Когда человек публикует статью с веб-сайта на Facebook, Facebook не обязательно должен проверять факты на веб-сайте. Вместо этого он может алгоритмически определять авторитет веб-сайта аналогично Google.

Если источник новостей является авторитетным, таким как BBC, он будет иметь приоритет в новостных лентах над дезинформацией, спамом или кликбейтом.

Важно отметить, что этот процесс децентрализован.

Никто не решил, что Би-би-си является авторитетной. Вместо этого этот вывод является результатом краудсорсинга.

Миллионы отдельных веб-сайтов ссылаются на BBC, подобно тому, как авторитетный ученый получает ссылки, если его работа является законной. Поэтому риски централизованного управления сведены к минимуму.

Это предлагаемое решение уменьшит распространение дезинформации без необходимости превращения Facebook в полицию Интернета.

Так почему же Facebook еще не пробовал что-то подобное?

Ну, это уменьшит их доходы от рекламы. Продвижение авторитетного контента вместо привлекательного сделало бы вашу новостную ленту немного… ну, скучной. Это означает меньше времени, проведенного на платформе, меньше кликов и меньше доходов от рекламы.

Существует также небольшая проблема, заключающаяся в том, что Google владеет интеллектуальной собственностью PageRank. Facebook потребуется разработать собственный алгоритм, который мог бы давать аналогичные результаты, но иметь достаточно разные методы, позволяющие избежать нарушения прав интеллектуальной собственности.

Я сказал, что это всего лишь мысленные эксперименты, ограниченные непрактичностью!

3. Ограничьте эхо-камеры

Исследования показывают, что дезинформация не распространяется далеко там, где меньше эхо-камер. Кроме того, теория групповой поляризации предполагает, что эхо-камеры перемещают целые группы в более экстремальные положения.

Это говорит о том, что, возможно, проблема не в дезинформации, а в эхо-камерах…

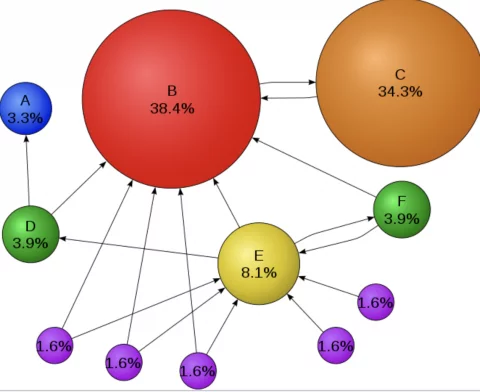

В сети с меньшим количеством групп отдельных пользователей дезинформация распространяется меньше и оказывает меньшее влияние на тех, кого она достигает. Проблема в том, что фраза «кластер отдельных пользователей» — это технический способ сказать «сообщество»!

Сообщество лежит в основе Facebook, но оно также способствует поляризации.

Таким образом, удаление эхо-камер нецелесообразно, но можно предпринять шаги, чтобы ограничить их вред.

Эти шаги могут включать:

- Facebook может предоставить пользователям возможность отключить персонализацию в наших новостных лентах, чтобы мы могли видеть, что потребляют другие, без алгоритмов.

- Facebook может помечать сильно поляризованный или пристрастный контент и предоставлять варианты для просмотра его вместе с контентом с противоположной точки зрения.

- Значки подтверждения могут быть размещены на контенте, который соответствует кодексу поведения журналиста.

Кроме того, можно обеспечить обучение, чтобы помочь людям выйти за пределы своих собственных эхо-камер. Мы обязаны добиваться «опровержения».

Для нас неестественно, но быть информированным гражданином означает потреблять информацию, с которой мы не обязательно согласны.

Нам всем было бы полезно быть немного менее уверенными.

Резюме

Социальные связи формируют ткань нашего общества. Но сама наша склонность к созданию сообществ единомышленников может быть использована, что приведет к дезинформации и разделению. Зов сирены цензуры может показаться привлекательным решением, но он может заманить нас к камню, которого лучше избегать.

Удаление утверждений вне консенсуса может показаться желательным, но, вероятно, усугубит проблему. Цензура может даже сделать людей менее доверяющими властям, загоняя наиболее злонамеренные взгляды в подполье, где они могут распространяться.

Вместо этого нам следует искать децентрализованные решения.

Решения, которые сводят к минимуму вред от дезинформации и при этом защищают наши основные права человека — право на свободу выражения мнений.