Como as mídias sociais devem responder à desinformação?

Publicados: 2022-03-09Como sociedade, temos uma relação complicada com as redes sociais. Quando ouvimos falar de bullying online, desinformação e discurso de ódio, condenamos com razão a sombra feia que lança sobre a sociedade. Mas quando a Rússia bane o Facebook na tentativa de controlar a narrativa em torno da Ucrânia, parece que um direito humano fundamental está sendo retirado.

Nossa confusão se deve a um conflito de valores: liberdade de expressão versus liberdade de danos. E é um dos debates mais importantes do nosso tempo. Mas também é um debate que se tornou excessivamente simplificado, polarizado e tribal.

Quais são os dois lados desse debate?

Um lado é a liberdade de expressão absolutistas que não querem regras. Eles alimentaram o surgimento de novas plataformas de mídia social, como o “Truth Social” de Gab e Donald Trump, que não têm limites para o que você publica. Eles rapidamente caíram no nacionalismo branco, anti-semitismo e teorias da conspiração QAnon.

O outro lado está buscando uma maior regulação estatal das mídias sociais. Isso resultou em novas iniciativas como Google Fact Check, Good Information Inc e Trusted News Summit, que buscam verificar o que é verdade. Esse lado muitas vezes subestima os riscos de conceder poderes a um estado para policiar a internet. Exemplos de como isso pode dar errado são as repressões nas mídias sociais por regimes políticos que procuram controlar o livre fluxo de informações.

Usando o Meta (eu uso “Facebook” para distinguir a plataforma de mídia social específica) como exemplo, examinarei os dois lados do debate – e proponho uma solução destinada a resolver o conflito de valores.

Facebook sob fogo

Quase um quarto da população mundial está no Facebook, tornando-o a plataforma de mídia social mais popular do mundo.

Mas a credibilidade de sua missão declarada, de “construir uma comunidade e aproximar o mundo” foi recentemente criticada.

Denunciantes acusaram o Facebook de conscientemente escolher o lucro em detrimento da sociedade; Eles argumentam que, ao promover a desinformação, o Facebook está diminuindo a integridade do processo democrático. Além disso, argumenta-se que a desinformação nas mídias sociais enfraqueceu a capacidade da sociedade de responder efetivamente à pandemia.

Mark Zuckerberg respondeu com o seguinte:

“A ideia de que permitimos que a desinformação se espalhe em nossa plataforma, ou que de alguma forma nos beneficiamos desse conteúdo, está errada.”

A defesa do Facebook é que eles têm mais parceiros de verificação de fatos do que qualquer outra plataforma de tecnologia. Seus esforços são certamente impressionantes, removendo mais de 5 milhões de conteúdos de ódio todos os meses.

O Facebook também indicará os padrões da comunidade, que listam 4 tipos de conteúdo em que eles podem agir:

- Comportamento violento e criminoso

- Preocupações de segurança (como bullying, abuso infantil, exploração)

- Conteúdo censurável, como pornografia e discurso de ódio

- Conteúdo inautêntico (como desinformação)

Destes, há pouca controvérsia sobre os pontos 1 a 3. Existe um amplo consenso de que o Facebook deve agir para prevenir danos causados por violência, bullying e discurso de ódio.

É o ponto 4, desinformação, que é controverso.

O aumento da desinformação

Às vezes parece que estamos preparados para acreditar simultaneamente em tudo e em nada.

E esse sentimento não é novo.

Em 1835, o jornal New York Sun afirmou que havia uma civilização alienígena na lua. Vendeu tão bem que estabeleceu o New York Sun como uma publicação líder.

No entanto, a desinformação direcionada como forma de controle psicológico só aumentou com o surgimento da comunicação digital.

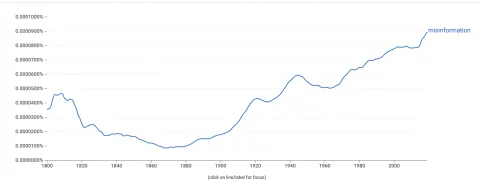

O visualizador do Google Ngram, que mede a frequência com que as palavras aparecem nos livros, mostra um aumento acentuado no uso da palavra “desinformação”.  Para entender isso, devemos entender como a desinformação se espalha.

Para entender isso, devemos entender como a desinformação se espalha.

Os algoritmos do Facebook são otimizados para engajamento – isso geralmente promove conteúdo que provoca uma forte resposta emotiva. O importante para o algoritmo é o engajamento, não a veracidade das informações que estão sendo compartilhadas.

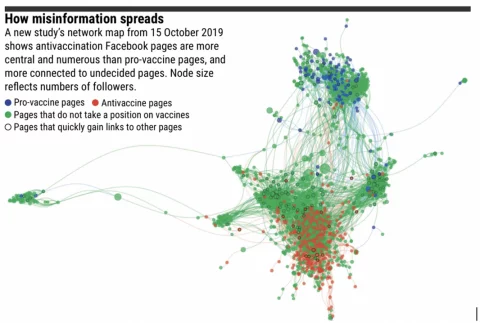

Curiosamente, a desinformação não viaja muito quando há poucas câmaras de eco. O conteúdo viajará até um usuário que discorde dele, que posteriormente o verifique e o revele como desinformação.

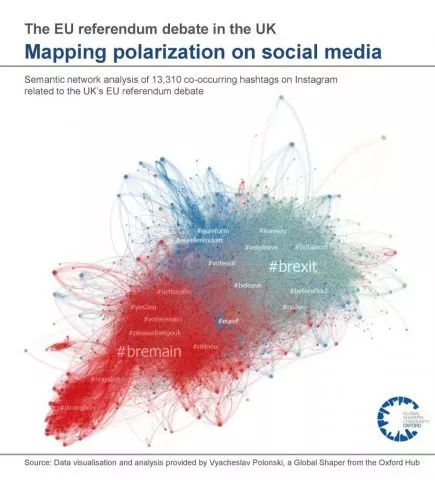

No entanto, os grupos online estão cada vez mais segregados por crenças ideológicas. Nessas bolhas, a desinformação pode viajar pela rede sem ser contestada.

Abaixo está uma representação visual das câmaras de eco do debate do referendo da UE no Reino Unido:

O viés de confirmação é nossa tendência de buscar e acreditar em informações que se alinham com nossas visões existentes. É sabido pelos psicólogos que uma vez que a mente de alguém está decidida, é difícil mudá-la. Então, em vez disso, a desinformação visa explorar algoritmos, câmaras de eco e viés de confirmação para amplificar e fortalecer as visões existentes . Isso pode levar ao extremismo.

Isso é particularmente problemático quando se espalha para o mundo real.

Exemplos do impacto da desinformação no mundo real:

- Os ataques do Capitólio de 2021, com raízes na teoria da conspiração QAnon

- Eleições interrompidas em países como Gana, Nigéria, Tongo, Tunísia e Holanda

- Falta de aceitação de vacinas Covid-19 ligada a uma variedade de fontes de desinformação

- As mortes em Charlottesville, alimentadas por fóruns extremistas de direita

- Tiroteios 'Pizzagate', também com raízes em QAnon

Além disso, descobriu-se que a desinformação prejudica nossa confiança nas instituições e dissemina a falsa ciência, o que afeta a saúde pública e atrapalha o processo democrático.

Então, que ação deve ser tomada?

O argumento contra a censura

Para combater os danos da desinformação, os defensores estão defendendo uma maior intervenção do Estado para regular as mídias sociais e remover a desinformação.

Por exemplo, o chefe das Nações Unidas, secretário-geral Antonio Guterres, pediu regras globais para regular o conteúdo de mídia social.

“Acho que não podemos viver em um mundo onde se dá muito poder a um número reduzido de empresas. Precisamos de um novo marco regulatório com regras que permitam que isso seja feito de acordo com a lei.”

~ Chefe das Nações Unidas, Secretário-Geral Antonio Guterres

É difícil discordar do sentimento por trás dessa afirmação. Sem as verificações apropriadas, o poder das empresas de tecnologia pode ficar além do nosso controle.

No entanto, antes de conceder poderes aos órgãos que lhes permitirão decidir quais informações consumimos, devemos considerar as possíveis desvantagens.

Em primeiro lugar, censurar postagens de mídia social pode ser uma violação do artigo da Lei de Direitos Humanos, que afirma:

"Todos tem o direito de liberdade de expressão. Este direito incluirá a liberdade de ter opiniões e de receber e impactar informações e ideias sem interferência da autoridade pública”.

~ Artigo 10 da Lei de Direitos Humanos

Curiosamente, o governo do Reino Unido está atualmente procurando reformar a Lei de Direitos Humanos, substituindo-a por uma “Declaração de Direitos”.

Uma mudança proposta é que os direitos humanos de um indivíduo podem ser violados se “salvaguardar o interesse público mais amplo” (página 56, Reforma dos Direitos Humanos). Essa mudança pode permitir maior censura à desinformação por parte do Estado.

Um segundo argumento contra a censura da desinformação é que ela está aberta a abusos por parte de regimes políticos que buscam centralizar o poder. O poder de decidir o que é – e o que não é – desinformação pode levar a uma repressão a protestos, ações coletivas e ativismo político.

A Primavera Árabe poderia ter acontecido se o Twitter e o Facebook tivessem sido policiados pelas autoridades?

Embora o papel da mídia social na Primavera Árabe seja provavelmente exagerado pelos jornalistas, uma análise acadêmica cuidadosa descobriu que a mídia social de fato levou a um aumento na ação coletiva positiva em países com governos opressivos.

Além disso, podemos observar o histórico de países que baniram plataformas de mídia social:

- China

- Rússia

- Irã

- Coreia do Norte

Todos esses países estão listados no “Índice de Liberdade no Mundo” como tendo algumas das piores liberdades civis do mundo. Não estou argumentando que eles têm liberdades civis pobres porque não permitem a mídia social, mas observo que os estados que tentam controlar as informações online tendem a ter registros ruins quando se trata de direitos humanos.

Mesmo que a censura estatal não seja a solução, temos um problema.

A confiança nas fontes de notícias tradicionais está evaporando rapidamente. Nesse vácuo corre a desinformação, criando um vento forte o suficiente para dissipar nosso controle sobre o que é verdade. Isso prejudicou a sociedade por meio da hesitação em vacinas, aumento do extremismo e ruptura dos processos democráticos.

Mas uma reação instintiva, com a entrega ao Estado do poder de decidir o que é verdade, poderia causar mais danos do que desinformação.

E de qualquer forma, é provável que seja uma violação dos direitos humanos.

Desafios para a solução do Facebook

O objetivo do Facebook é impedir a regulamentação pelos governos por meio da autorregulação.

Sua estratégia para combater a desinformação inclui:

- Aplicando aprendizado de máquina para detectar desinformação

- Equipes de resposta para alterar o conteúdo sinalizado

- Parceria com organizações de verificação de fatos de terceiros para verificar o conteúdo

No entanto, o próprio Facebook admitirá limitações a essa abordagem amplamente automatizada. Por exemplo, como um programa automatizado determinaria a diferença entre sites satíricos e desinformação intencional?

Além disso, existem grandes quantidades de clickbait com o único propósito de transformar cliques em receitas de publicidade. Eles geralmente usam sites de modelo que se parecem com sites de notícias oficiais com manchetes atraentes, muitas vezes enganando os espectadores para clicar.

Esses sites não são desinformação, mas também não são fontes confiáveis de informação.

Entre sátira e clickbait, há colunas de fofocas e jornalismo de opinião. Esta é uma mídia “legítima” que não faz reivindicações de objetividade. Por exemplo, Ben Shapiro, um comentarista de mídia americano de direita, admite abertamente que seu site de notícias, The Daily Wire, existe não para relatar as notícias, mas para 'ganhar uma guerra cultural'. O giro e o exagero típicos desses editores são uma área cinzenta para programas automatizados que procuram desinformação.

Mark Zuckerberg disse recentemente que “o Facebook faz mais para combater a desinformação do que qualquer outra empresa”. Ele pode estar certo. Mas é o suficiente?

Uma solução proposta

Vimos como a solução para a desinformação é um conflito de valores: liberdade de expressão versus liberdade de danos. Qualquer solução deve procurar equilibrar os dois.

Eu ofereço uma solução em potencial apenas como um experimento mental – afinal, é mais fácil identificar falhas no trabalho dos outros e muito mais difícil sugerir algo você mesmo. É certo que esta não é a minha área de especialização e quaisquer sugestões serão impraticáveis na melhor das hipóteses!

Feita essa ressalva, proponho três pontos:

- Não tente censurar informações erradas nas postagens de mídia social de um indivíduo

- Promova conteúdo autoritário em vez de engajamento algorítmico

- Limitar câmaras de eco

1. Não censurar informações erradas nas postagens do indivíduo

Isso protege os direitos humanos de um indivíduo. Também protege ativistas que desejam usar as mídias sociais para se mobilizar contra regimes políticos opressores.

Mas isso não é liberdade de expressão a todo custo.

O Facebook deve continuar a remover conteúdo que incentive comportamento violento, bullying, exploração e discurso de ódio.

2. Promover conteúdo autoritário em vez de conteúdo envolvente

O algoritmo “EdgeRank” do Facebook determina qual conteúdo é exibido em seu feed de notícias e em qual ordem.

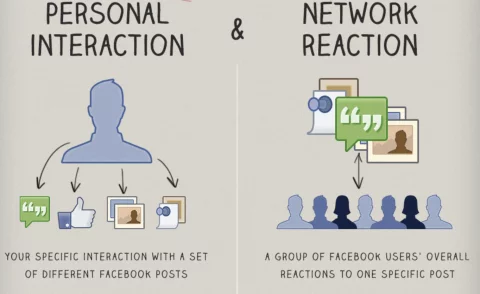

Ele procura personalizar seu feed por meio de uma combinação de seus interesses pessoais com a forma como a comunidade mais ampla interagiu com uma postagem específica.

O algoritmo do Facebook promove conteúdo com alto engajamento. Muitas vezes, isso funciona bem e você vê postagens de amigos e familiares, ao lado de memes virais e vídeos de gatos. No entanto, o mesmo mecanismo também promove conteúdo emotivo, que muitas vezes é divisivo ou falso.

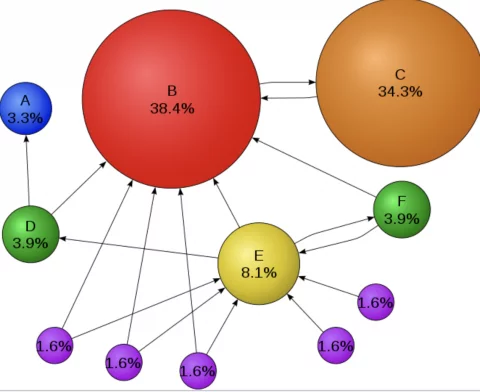

O algoritmo, no entanto, pode ser adaptado para funcionar de maneira semelhante ao algoritmo PageRank do Google.

O Google promove conteúdo autoritário – em vez de envolvente. Ele faz isso analisando quantas vezes outros sites fazem referência a um conteúdo na forma de hiperlinks ou “back-links”. Por exemplo, me referir a você para este detalhamento detalhado de como o algoritmo PageRank do Google funciona é um indicador da confiabilidade dessa página.

Quando um indivíduo publica um artigo de um site no Facebook, o Facebook não precisa necessariamente verificar o site. Em vez disso, poderia determinar algoritmicamente a autoridade do site de maneira semelhante ao Google.

Se a fonte de notícias for autoritária, como a BBC, ela seria priorizada nos feeds de notícias sobre desinformação, spam ou clickbait.

Criticamente, esse processo é descentralizado.

Nenhum indivíduo decidiu que a BBC tem autoridade. Em vez disso, essa conclusão é o resultado do crowdsourcing.

Milhões de sites individuais referenciaram a BBC, assim como um estudioso de autoridade recebe citações se seu trabalho for legítimo. Portanto, os riscos do controle centralizado são minimizados.

Essa solução proposta diminuiria o alcance da desinformação sem a necessidade de o Facebook se tornar a polícia da internet.

Então, por que o Facebook ainda não tentou algo assim?

Bem, isso diminuiria suas receitas de publicidade. Promover conteúdo autoritário em vez de conteúdo envolvente tornaria seu feed de notícias um pouco... bem, chato. Isso significa menos tempo gasto na plataforma, menos cliques e menos receita de publicidade.

Há também o pequeno problema de que o Google possui a propriedade intelectual do PageRank. O Facebook precisaria desenvolver seu próprio algoritmo que pudesse fornecer resultados semelhantes, mas ter métodos suficientemente diferentes para evitar a violação de IP.

Eu disse que eram apenas experimentos mentais limitados pela impraticabilidade!

3. Limite as câmaras de eco

Pesquisas sugerem que a desinformação não vai muito longe onde há menos câmaras de eco. Além disso, a teoria da polarização de grupo sugere que as câmaras de eco movem grupos inteiros para posições mais extremas.

Isso sugere que talvez a desinformação não seja o problema – talvez sejam as câmaras de eco…

Em uma rede com menos grupos de usuários segregados, a desinformação viaja menos e tem um impacto menor naqueles que atinge. O problema é que a frase “grupo de usuários segregados” é uma forma técnica de dizer “a comunidade”!

A comunidade está no coração do Facebook, mas também é o que está impulsionando a polarização.

Portanto, remover as câmaras de eco não é viável, mas medidas podem ser tomadas para limitar seus danos.

Essas etapas podem incluir:

- O Facebook pode fornecer um recurso para os usuários desativarem a personalização em nossos feeds de notícias para que possamos ver o que os outros estão consumindo, sem algoritmos.

- O Facebook pode sinalizar conteúdo altamente polarizado ou partidário e fornecer opções para visualizá-lo ao lado do conteúdo do ponto de vista oposto

- Selos de verificação podem ser colocados em conteúdo que esteja em conformidade com o código de conduta do jornalismo

Além disso, a educação poderia ser fornecida para ajudar os indivíduos a sair de suas próprias câmaras de eco. Temos a responsabilidade de buscar “desconfirmação”.

Não é natural para nós, mas ser um cidadão informado significa consumir informações com as quais não necessariamente concordamos.

Todos nós nos beneficiaríamos se tivéssemos um pouco menos de certeza.

Resumo

As conexões sociais formam o tecido da nossa sociedade. Mas nossa própria tendência de formar comunidades com ideias semelhantes pode ser explorada, levando à desinformação e à divisão. O canto da sereia da censura pode parecer uma solução atraente, mas pode nos atrair para uma rocha que é melhor evitar.

A remoção de reivindicações fora do consenso pode parecer desejável, mas provavelmente piorará o problema. A censura pode até tornar as pessoas menos confiantes na autoridade, empurrando as visões mais maliciosas para o subsolo, onde podem se espalhar.

Em vez disso, devemos buscar soluções descentralizadas.

Soluções que minimizam os danos da desinformação ao mesmo tempo em que protegem nossos direitos humanos fundamentais – o direito à liberdade de expressão.