ソーシャルメディアは誤った情報にどのように対応すべきですか?

公開: 2022-03-09社会として、私たちはソーシャルメディアと複雑な関係を持っています。 オンラインいじめ、誤った情報、悪意のある表現について聞いたとき、私たちはそれが社会に投げかける醜い影を正しく非難します。 しかし、ロシアがウクライナ周辺の物語を支配しようとしてFacebookを禁止すると、基本的人権が奪われているように感じます。

私たちの混乱は、表現の自由と危害からの自由という価値観の対立によるものです。 そして、それは私たちの時代の最も重要な議論の1つです。 しかし、それはまた、過度に単純化され、二極化され、部族化された議論でもあります。

この議論の両面は何ですか?

一方は、ルールを望まない言論の自由です。 彼らは、GabやDonald Trumpの「TruthSocial」など、投稿内容に制限のない新しいソーシャルメディアプラットフォームの台頭を後押ししました。 彼らはすぐに白人至上主義、反ユダヤ主義、そしてQAnon陰謀論に陥りました。

反対側は、ソーシャルメディアのより大きな州の規制を探しています。 これにより、 Google Fact Check、Good Information Inc、Trusted News Summitなど、何が真実かを検証しようとする新しいイニシアチブが生まれました。 この側は、インターネットを監視する州の権限を付与するリスクを過小評価することがよくあります。 これがどのようにうまくいかないかの例は、情報の自由な流れを制御しようとしている政治体制によるソーシャルメディアの取り締まりです。

例としてメタ(特定のソーシャルメディアプラットフォームを区別するために「Facebook」を使用)を使用して、議論の両側を検討し、価値の対立を解決することを目的としたソリューションを提案します。

Facebookが攻撃中

世界の人口のほぼ4分の1がFacebookを利用しており、Facebookは世界で最も人気のあるソーシャルメディアプラットフォームとなっています。

しかし、「コミュニティを構築し、世界をより緊密にする」という彼らの表明された使命の信頼性は、最近、非難されています。

内部告発者は、Facebookが社会よりも利益を故意に選んだと非難している。 誤報を助長することで、Facebookは民主的プロセスの完全性を低下させているとちょっと主張します。 さらに、ソーシャルメディアの誤った情報がパンデミックに効果的に対応する社会の能力を弱めていると主張されています。

マーク・ザッカーバーグは次のように答えました。

「私たちが誤った情報を私たちのプラットフォームで妨害することを許可するという考え、または私たちがこのコンテンツから何らかの形で利益を得るという考えは間違っています。」

Facebookの防御は、他のどの技術プラットフォームよりも多くのファクトチェックパートナーを持っていることです。 彼らの努力は確かに印象的で、毎月500万を超える不快なコンテンツを削除しています。

Facebookはまた、彼らが行動を起こす可能性のある4種類のコンテンツをリストしている彼らのコミュニティ基準にあなたを向けます:

- 暴力的および犯罪的な行動

- 安全上の懸念(いじめ、児童虐待、搾取など)

- ポルノや悪意のある表現などの不快なコンテンツ

- 不正なコンテンツ(誤った情報など)

これらのうち、ポイント1から3については、ほとんど論争がありません。Facebookは、暴力、いじめ、悪意のある表現による危害を防ぐために行動すべきであるという幅広い合意があります。

物議を醸しているのはポイント4、誤報です。

誤報の台頭

すべてを同時に信じ、何も信じないように準備されているように感じることがあります。

そして、この気持ちは新しいものではありません。

1835年、ニューヨークサン紙は月にエイリアン文明があったと主張しました。 それは非常によく売れたので、ニューヨークサンを主要な出版物として確立しました。

しかし、心理的コントロールの一形態としての標的とされた誤報は、デジタル通信の台頭とともに増加しただけです。

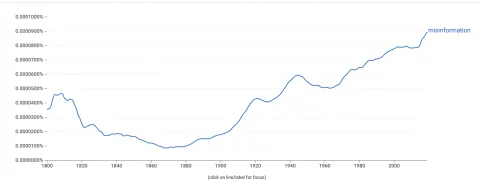

単語が本に現れる頻度を測定するGoogleNgramビューアは、「誤報」という単語の使用が急増していることを示しています。  これを理解するには、誤った情報がどのように広がるかを理解する必要があります。

これを理解するには、誤った情報がどのように広がるかを理解する必要があります。

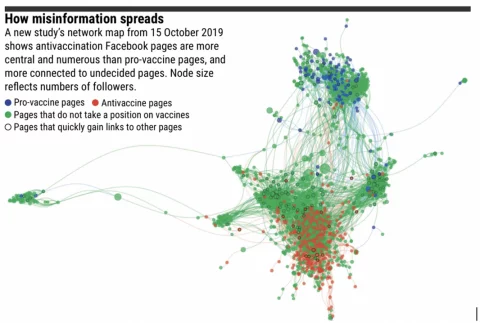

Facebookのアルゴリズムはエンゲージメントのために最適化されています-これはしばしば強い感情的な反応を引き出すコンテンツを促進します。 アルゴリズムにとって重要なのは、共有されている情報の信憑性ではなく、関与です。

興味深いことに、エコーチェンバーが少ない場合、誤った情報は遠くまで伝わりません。 コンテンツは、それに同意しないユーザーまで移動します。ユーザーはその後、コンテンツを事実確認し、誤った情報として明らかにします。

しかし、オンライングループはイデオロギー的信念によってますます分離されています。 これらのバブルでは、誤った情報は、異議を唱えられることなく、ネットワークをはるかに通過する可能性があります。

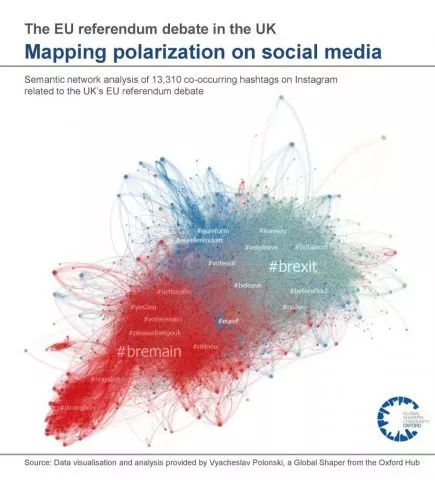

以下は、英国のEU国民投票の討論からのエコーチェンバーの視覚的表現です。

確証バイアスは、私たちの既存の見解と一致する情報を探し出し、信じる傾向です。 心理学者は、誰かの心が決まったら、それを変えるのは難しいことを知っています。 したがって、代わりに、誤った情報は、アルゴリズム、エコーチェンバー、確証バイアスを利用して、既存のビューを増幅および強化することを目的としています。 これは過激主義につながる可能性があります。

これは、現実の世界に流出する場合に特に問題になります。

誤った情報の実際の影響の例:

- QAnon陰謀説にルーツを持つ2021年国会議事堂の攻撃

- ガーナ、ナイジェリア、トンゴ、チュニジア、オランダなどの国での選挙の混乱

- さまざまな誤った情報源に関連するCovid-19ワクチンの摂取不足

- 右翼過激派フォーラムによって煽られたシャーロッツビルでの死

- QAnonにルーツを持つ「ピザゲート」射撃

さらに、誤った情報は、私たちの制度への信頼を損ない、誤った科学を広め、公衆衛生に影響を与え、民主的なプロセスを混乱させることがわかっています。

では、どのような行動を取るべきでしょうか?

検閲に反対する議論

誤った情報の害と戦うために、支持者はソーシャルメディアを規制し、誤った情報を取り除くためのより大きな国家介入を主張しています。

たとえば、国連の首長であるアントニオ・グテーレス事務総長は、ソーシャルメディアのコンテンツを規制するためのグローバルなルールを求めました。

「少ない企業に力を入れすぎている世界に住むことはできないと思います。 法律に沿ってそれを行うことを可能にする規則を備えた新しい規制の枠組みが必要です。」

〜国連長官、アントニオ・グテーレス事務総長

この声明の背後にある感情に異議を唱えるのは難しい。 適切なチェックがなければ、テクノロジー企業の力は私たちのコントロールを超えて膨らむ可能性があります。

ただし、消費する情報を決定できる権限を団体に付与する前に、潜在的なマイナス面を考慮する必要があります。

第一に、ソーシャルメディアの投稿を検閲することは、次のように述べている人権法の条項に違反している可能性があります。

「誰もが言論の自由を得る権利があります。 この権利には、公的機関による干渉なしに意見を保持し、情報やアイデアを受け取り、影響を与える自由が含まれるものとします。」

〜人権法第10条

興味深いことに、英国政府は現在、人権法を「権利章典」に置き換えて改革しようとしています。

提案された変更の1つは、「より広い公共の利益を保護する」場合、個人の人権が侵害される可能性があるというものです(56ページ、人権改革)。 この変更により、州による誤った情報の検閲が強化される可能性があります。

誤った情報の検閲に反対する第2の議論は、権力の集中化を目指す政治体制による虐待の可能性があるということです。 誤った情報が何であるか、何がそうでないかを決定する力は、抗議、集団行動、政治活動の取り締まりにつながる可能性があります。

TwitterとFacebookが当局によって取り締まられていたら、アラブの春は起こったのだろうか?

アラブの春におけるソーシャルメディアの役割はジャーナリストによって過大評価されている可能性がありますが、慎重な学術分析により、ソーシャルメディアは実際に抑圧的な政府を持つ国で積極的な集団行動の増加につながっていることがわかりました。

さらに、ソーシャルメディアプラットフォームを禁止した国の実績を見ることができます。

- 中国

- ロシア

- イラン

- 北朝鮮

これらの国はすべて、世界で最悪の市民的自由のいくつかを持っているとして「世界自由度指数」にリストされています。 私は、彼らがソーシャルメディアを許可していないために市民の自由が貧弱であると主張しているのではなく、オンラインで情報を管理しようとする州は人権に関して悪い記録を持っている傾向があることを観察しています。

州の検閲が解決策ではない場合でも、問題があります。

従来のニュースソースへの信頼は急速に失われています。 この真空に誤った情報が殺到し、それが真実であるという私たちのグリップを吹き飛ばすのに十分な強さの風を作り出します。 これは、ワクチンの躊躇、過激主義の増加、民主的プロセスの崩壊を通じて社会に害を及ぼしてきました。

しかし、何が真実であるかを決定する力を国家に引き渡すというひざまずく反応は、誤った情報よりも大きな害を生み出す可能性があります。

そしてとにかく、それは人権の侵害である可能性が高いです。

Facebookのソリューションへの挑戦

Facebookの目的は、自主規制を通じて政府による規制を防ぐことです。

誤った情報に取り組む彼らの戦略には以下が含まれます:

- 機械学習を適用して誤った情報を検出する

- フラグが立てられたコンテンツを事実変更するための対応チーム

- サードパーティのファクトチェック組織と提携してコンテンツを検証する

ただし、Facebook自体は、この大部分が自動化されたアプローチに対する制限を認めます。 たとえば、自動化されたプログラムは、風刺的なWebサイトと意図的な誤報の違いをどのように判断しますか?

さらに、クリックを広告収入に変えることを唯一の目的として、膨大な量のクリックベイトが存在します。 これらは多くの場合、魅力的な見出しのある公式ニュースWebサイトのように見えるテンプレート化されたサイトを使用し、視聴者をだましてクリックさせます。

これらのサイトは誤った情報ではありませんが、信頼できる情報源でもありません。

風刺とクリックベイトの間には、芸能記者と時事評論があります。 これは、客観性を主張しない「正当な」メディアです。 たとえば、右翼のアメリカのメディアコメンテーターであるベンシャピーロは、彼のニュースWebサイトThe Daily Wireがニュースを報告するためではなく、「文化戦争に勝つ」ために存在することを公然と認めています。 これらの出版社に典型的なスピンと誇張は、誤った情報を探す自動プログラムの灰色の領域です。

Mark Zuckerbergは最近、「Facebookは他のどの企業よりも誤った情報に対処するために多くのことを行っている」と述べています。 彼は正しいかもしれません。 しかし、それで十分ですか?

提案された解決策

私たちは、誤った情報の解決策が価値観の対立である方法を見てきました。表現の自由と危害からの自由です。 どのソリューションも、2つのバランスを取るように努める必要があります。

私は思考実験としてのみ潜在的な解決策を提供します。結局のところ、他の人の仕事に穴を開けるのは簡単で、自分で何かを提案するのははるかに困難です。 確かに、これは私の専門分野ではなく、提案はせいぜい実用的ではありません。

その警告が言ったので、私は3つのポイントを提案します:

- 個人のソーシャルメディアの投稿で誤った情報を検閲しようとしないでください

- エンゲージメントよりも信頼できるコンテンツをアルゴリズムで宣伝する

- エコーチェンバーを制限する

1.個人の投稿の誤った情報を検閲しない

これにより、個人の人権が保護されます。 それはまた、抑圧的な政治体制に対して動員するためにソーシャルメディアを使用したい活動家を保護します。

しかし、これは言論の自由ではありません。

Facebookは、暴力的な行動、いじめ、搾取、悪意のある表現を助長するコンテンツを引き続き削除する必要があります。

2.魅力的なコンテンツよりも信頼できるコンテンツを宣伝する

Facebookの「EdgeRank」アルゴリズムは、ニュースフィードに表示されるコンテンツとその順序を決定します。

それは、あなたの個人的な興味と、より広いコミュニティが特定の投稿とどのように相互作用したかを組み合わせることによって、あなたのフィードをパーソナライズしようとします。

Facebookのアルゴリズムは、エンゲージメントの高いコンテンツを宣伝します。 多くの場合、これはうまく機能し、バイラルミームや猫の動画とともに、友人や家族からの投稿が表示されます。 ただし、同じメカニズムによって感情的なコンテンツも促進されます。これは、分裂的または真実ではないことがよくあります。

ただし、このアルゴリズムは、GoogleのPageRankアルゴリズムと同じように機能するように適合させることができます。

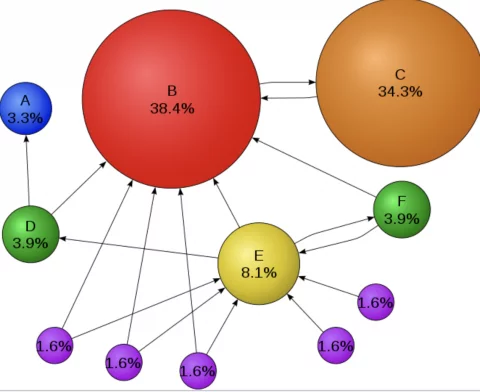

Googleは、魅力的なコンテンツではなく、信頼できるコンテンツを宣伝しています。 これは、他のWebサイトがハイパーリンクまたは「バックリンク」の形式でコンテンツを参照している回数を分析することによって行われます。 たとえば、GoogleのPageRankアルゴリズムがどのように機能するかについてのこの詳細な内訳を紹介することは、そのページの信頼性の指標です。

個人がウェブサイトからFacebookに記事を投稿する場合、Facebookは必ずしもウェブサイトをファクトチェックする必要はありません。 代わりに、Googleと同様の方法でウェブサイトの権限をアルゴリズムで決定できます。

ニュースソースがBBCのように信頼できるものである場合、ニュースフィードでは、誤った情報、スパム、クリックベイトよりも優先されます。

重要なことに、このプロセスは分散化されています。

BBCが権威あると判断した人は誰もいません。 代わりに、この結論はクラウドソーシングの結果です。

権威ある学者が彼らの仕事が合法である場合に引用を受け取るように、何百万もの個々のウェブサイトがBBCを参照しています。 したがって、集中管理のリスクは最小限に抑えられます。

この提案された解決策は、Facebookがインターネットの警察になる必要なしに誤った情報の到達範囲を減らすでしょう。

では、なぜFacebookはこのようなことをまだ試していなかったのでしょうか。

まあ、それは彼らの広告収入を減らすでしょう。 魅力的なコンテンツよりも信頼できるコンテンツを宣伝すると、ニュースフィードが少し…まあ、退屈になります。 これは、プラットフォームに費やす時間が減り、クリック数が減り、広告収入が減ることを意味します。

GoogleがPageRankの知的財産を所有しているという小さな問題もあります。 Facebookは、同様の結果をもたらすことができる独自のアルゴリズムを開発する必要がありますが、IP侵害を回避するために十分に異なる方法を持っています。

私はこれらが非実用性によって制限された単なる思考実験であると言いました!

3.エコーチェンバーを制限します

研究によると、エコーチェンバーが少ない場所では誤った情報が遠くまで伝わることはありません。 さらに、グループ分極理論は、エコーチャンバーがグループ全体をより極端な位置に移動させることを示唆しています。

これは、おそらく誤った情報が問題ではないことを示唆しています–おそらくそれはエコーチェンバーです…

分離されたユーザーのクラスターが少ないネットワークでは、誤った情報の移動距離が短くなり、到達するユーザーへの影響が少なくなります。 問題は、「分離されたユーザーのクラスター」というフレーズが「コミュニティ」の技術的な言い方であるということです。

コミュニティはFacebookの中心ですが、それは二極化を推進しているものでもあります。

したがって、エコーチェンバーを取り除くことは実行可能ではありませんが、それらの害を制限するための措置を講じることができます。

これらの手順には、次のものが含まれます。

- Facebookは、ユーザーがニュースフィードのパーソナライズをオフにする機能を提供できるため、他のユーザーが何を消費しているかをアルゴリズムなしで確認できます。

- Facebookは、高度に二極化された、または党派的なコンテンツにフラグを立て、反対の視点からコンテンツと一緒にそれを表示するオプションを提供することができます

- ジャーナリズムの行動規範に準拠したコンテンツに検証バッジを付けることができます

さらに、個人が自分のエコーチャンバーの外に出るのを助けるための教育を提供することができます。 私たちには「不確認」を求める責任があります。

私たちにとって自然なことではありませんが、情報に通じた市民であるということは、私たちが必ずしも同意しないかもしれない情報を消費することを意味します。

私たちは皆、少し確信が持てないことから恩恵を受けるでしょう。

概要

社会的つながりは私たちの社会の構造を形成します。 しかし、志を同じくするコミュニティを形成するという私たちの傾向が悪用され、誤った情報や分裂につながる可能性があります。 検閲のサイレンの呼びかけは魅力的な解決策のように見えるかもしれませんが、それは私たちが避けたほうがよい岩に私たちを誘惑するかもしれません。

コンセンサス外のクレームを削除することは望ましいように思われるかもしれませんが、問題を悪化させる可能性があります。 検閲は、人々の権威への信頼を低下させ、より悪意のある見解を地下に押しやる可能性さえあります。

代わりに、分散型ソリューションを探す必要があります。

私たちの基本的人権、つまり言論の自由の権利を保護しながら、誤った情報の害を最小限に抑えるソリューション。