Bagaimana seharusnya media sosial menanggapi informasi yang salah?

Diterbitkan: 2022-03-09Sebagai masyarakat, kita memiliki hubungan yang rumit dengan media sosial. Ketika kami mendengar tentang intimidasi online, informasi yang salah, dan ujaran kebencian, kami dengan tepat mengutuk bayangan buruk yang ditimbulkannya pada masyarakat. Tetapi ketika Rusia melarang Facebook dalam upaya untuk mengendalikan narasi di sekitar Ukraina, rasanya seolah-olah hak asasi manusia yang mendasar dirampas.

Kebingungan kami disebabkan oleh konflik nilai: kebebasan berekspresi vs kebebasan dari bahaya. Dan ini adalah salah satu perdebatan paling penting di zaman kita. Tapi itu juga merupakan perdebatan yang telah menjadi terlalu disederhanakan, terpolarisasi dan kesukuan.

Apa dua sisi dari perdebatan ini?

Satu sisi adalah kebebasan berbicara absolutis yang tidak menginginkan aturan. Mereka telah memicu munculnya platform media sosial baru, seperti "Truth Social" Gab dan Donald Trump, yang tidak memiliki batasan pada apa yang Anda posting. Mereka dengan cepat turun ke nasionalisme kulit putih, anti-semitisme, dan teori konspirasi QAnon.

Sisi lain mencari peraturan negara yang lebih besar dari media sosial. Ini telah menghasilkan inisiatif baru seperti Google Fact Check, Good Information Inc, dan Trusted News Summit, yang berupaya memverifikasi kebenaran. Sisi ini sering meremehkan risiko pemberian kekuasaan negara untuk mengawasi internet. Contoh bagaimana ini bisa salah adalah tindakan keras media sosial oleh rezim politik yang ingin mengontrol arus informasi yang bebas.

Menggunakan Meta (Saya menggunakan "Facebook" untuk membedakan platform media sosial tertentu) sebagai contoh, saya akan memeriksa kedua sisi perdebatan - dan saya mengusulkan solusi yang bertujuan untuk menyelesaikan konflik nilai.

Facebook di bawah api

Hampir seperempat populasi dunia ada di Facebook, menjadikannya platform media sosial paling populer di dunia.

Namun kredibilitas misi yang mereka nyatakan, untuk “membangun komunitas dan mendekatkan dunia” baru-baru ini mendapat kecaman.

Pelapor menuduh Facebook sengaja memilih keuntungan daripada masyarakat; Mereka berpendapat bahwa, dalam mempromosikan informasi yang salah, Facebook mengurangi integritas proses demokrasi. Lebih lanjut, dikatakan bahwa misinformasi media sosial telah melemahkan kemampuan masyarakat untuk merespons pandemi secara efektif.

Mark Zuckerberg menanggapi dengan yang berikut:

“Gagasan bahwa kami membiarkan informasi yang salah berkembang di platform kami, atau bahwa kami mendapat manfaat dari konten ini, adalah salah.”

Pertahanan Facebook adalah mereka memiliki lebih banyak mitra pemeriksa fakta daripada platform teknologi lainnya. Upaya mereka tentu saja mengesankan, menghapus lebih dari 5 juta keping konten kebencian setiap bulan.

Facebook juga akan mengarahkan Anda ke standar komunitas mereka, yang mencantumkan 4 jenis konten yang mungkin mereka ambil tindakannya:

- Perilaku kekerasan dan kriminal

- Masalah keamanan (seperti intimidasi, pelecehan anak, eksploitasi)

- Konten yang tidak pantas, seperti pornografi dan ujaran kebencian

- Konten tidak autentik (seperti misinformasi)

Dari jumlah tersebut, ada sedikit kontroversi mengenai poin 1 hingga 3. Ada kesepakatan luas bahwa Facebook harus bertindak untuk mencegah bahaya dari kekerasan, intimidasi, dan ujaran kebencian.

Ini adalah poin 4, misinformasi, yang kontroversial.

Munculnya informasi yang salah

Kadang-kadang kita merasa seperti siap untuk secara bersamaan percaya segalanya dan tidak ada apa-apa.

Dan perasaan ini bukanlah hal baru.

Pada tahun 1835, surat kabar New York Sun mengklaim ada peradaban asing di bulan. Itu terjual dengan sangat baik sehingga mendirikan New York Sun sebagai publikasi terkemuka.

Namun, misinformasi yang ditargetkan sebagai bentuk kontrol psikologis hanya meningkat dengan munculnya komunikasi digital.

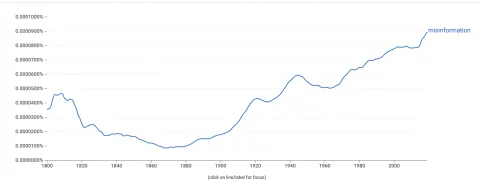

Penampil Google Ngram, yang mengukur frekuensi kemunculan kata di buku, menunjukkan peningkatan tajam dalam penggunaan kata "misinformasi".  Untuk memahami hal ini, kita harus memahami bagaimana misinformasi menyebar.

Untuk memahami hal ini, kita harus memahami bagaimana misinformasi menyebar.

Algoritme Facebook dioptimalkan untuk keterlibatan – ini sering kali mempromosikan konten yang memunculkan respons emotif yang kuat. Yang penting bagi algoritme adalah keterlibatan, bukan kebenaran informasi yang dibagikan.

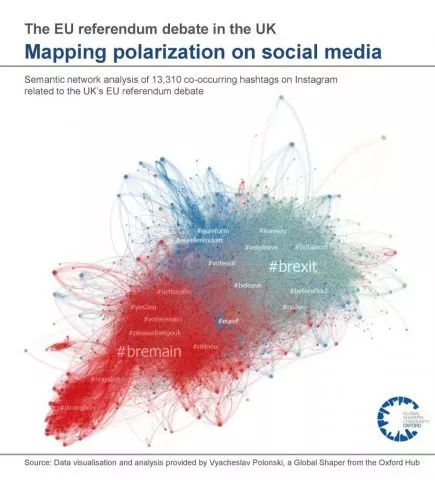

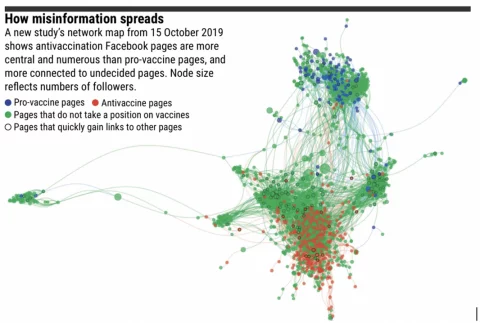

Menariknya, informasi yang salah tidak menyebar jauh ketika ada beberapa ruang gema. Konten akan berjalan sejauh pengguna yang tidak setuju dengannya, yang kemudian memeriksa fakta dan mengungkapkannya sebagai informasi yang salah.

Namun, kelompok online semakin dipisahkan oleh keyakinan ideologis. Dalam gelembung-gelembung ini, informasi yang salah dapat menyebar jauh melalui jaringan tanpa ditentang.

Di bawah ini adalah representasi visual dari ruang gema dari debat referendum UE Inggris:

Bias konfirmasi adalah kecenderungan kita untuk mencari dan mempercayai informasi yang sejalan dengan pandangan kita yang ada. Para psikolog diketahui bahwa sekali pikiran seseorang sudah bulat, sulit untuk mengubahnya. Jadi, informasi yang salah bertujuan untuk mengeksploitasi algoritme, ruang gema, dan bias konfirmasi untuk memperkuat dan memperkuat pandangan yang ada . Ini bisa mengarah pada ekstremisme.

Ini sangat bermasalah ketika tumpah ke dunia nyata.

Contoh dampak dunia nyata dari misinformasi:

- Serangan Capitol 2021, dengan akar teori konspirasi QAnon

- Pemilu yang terganggu di negara-negara termasuk Ghana, Nigeria, Tongo, Tunisia dan Belanda

- Kurangnya penyerapan vaksin Covid-19 terkait dengan berbagai sumber informasi yang salah

- Kematian di Charlottesville, dipicu oleh forum ekstremis sayap kanan

- Penembakan 'Pizzagate', juga dengan akar di QAnon

Selain itu, informasi yang salah telah ditemukan merusak kepercayaan kita pada institusi dan menyebarkan ilmu palsu, yang berdampak pada kesehatan masyarakat dan mengganggu proses demokrasi.

Lantas, tindakan apa yang harus dilakukan?

Argumen menentang sensor

Untuk memerangi bahaya misinformasi, para advokat memperdebatkan intervensi negara yang lebih besar untuk mengatur media sosial dan menghapus misinformasi.

Misalnya, Sekjen PBB Antonio Guterres, menyerukan aturan global untuk mengatur konten media sosial.

“Saya tidak berpikir bahwa kita dapat hidup di dunia di mana terlalu banyak kekuatan diberikan kepada sejumlah kecil perusahaan. Kami membutuhkan kerangka peraturan baru dengan aturan yang memungkinkan hal itu dilakukan sesuai dengan hukum.”

~ Sekjen PBB, Antonio Guterres

Sulit untuk tidak setuju dengan sentimen di balik pernyataan ini. Tanpa pemeriksaan yang tepat, kekuatan perusahaan teknologi dapat menggelembung di luar kendali kita.

Namun, sebelum kita memberikan kekuasaan kepada badan yang memungkinkan mereka memutuskan informasi apa yang kita konsumsi, kita harus mempertimbangkan potensi kerugiannya.

Pertama, menyensor posting media sosial mungkin merupakan pelanggaran Pasal Undang-Undang Hak Asasi Manusia, yang menyatakan:

“Setiap orang berhak atas kebebasan berekspresi. Hak ini harus mencakup kebebasan untuk memiliki pendapat dan untuk menerima dan mempengaruhi informasi dan gagasan tanpa campur tangan otoritas publik.”

~ Pasal 10 UU HAM

Menariknya, Pemerintah Inggris saat ini sedang berupaya untuk mereformasi Undang-Undang Hak Asasi Manusia, menggantikannya dengan “Bill of Rights”.

Salah satu perubahan yang diusulkan adalah bahwa hak asasi individu dapat dilanggar jika “menjaga kepentingan publik yang lebih luas” (halaman 56, Reformasi Hak Asasi Manusia). Perubahan ini memungkinkan penyensoran informasi yang salah oleh negara bagian.

Argumen kedua yang menentang penyensoran informasi yang salah adalah bahwa hal itu terbuka untuk disalahgunakan oleh rezim politik yang ingin memusatkan kekuasaan. Kekuatan untuk memutuskan apa yang - dan apa yang tidak - informasi yang salah dapat mengarah pada tindakan keras terhadap protes, aksi kolektif, dan aktivisme politik.

Mungkinkah Musim Semi Arab terjadi jika Twitter dan Facebook diawasi oleh pihak berwenang?

Sementara peran media sosial di Musim Semi Arab kemungkinan besar dimainkan oleh jurnalis, analisis akademis yang cermat menemukan bahwa media sosial memang menyebabkan peningkatan aksi kolektif positif di negara-negara dengan pemerintahan yang menindas.

Selanjutnya, kita dapat melihat rekam jejak negara-negara yang telah melarang platform media sosial:

- Cina

- Rusia

- Iran

- Korea Utara

Semua negara ini terdaftar dalam "Indeks Kebebasan di Dunia" sebagai negara dengan kebebasan sipil terburuk di dunia. Saya tidak berargumen bahwa mereka memiliki kebebasan sipil yang buruk karena mereka tidak mengizinkan media sosial, melainkan mengamati bahwa negara-negara yang mencoba mengontrol informasi online cenderung memiliki catatan buruk dalam hal hak asasi manusia.

Bahkan jika sensor negara bukanlah solusi, kami memiliki masalah.

Kepercayaan pada sumber berita tradisional dengan cepat menguap. Ke dalam ruang hampa ini mengalir informasi yang salah, menciptakan angin yang cukup kuat sehingga telah menghancurkan cengkeraman kita pada apa yang benar. Ini telah merugikan masyarakat melalui keragu-raguan terhadap vaksin, meningkatnya ekstremisme, dan gangguan proses demokrasi.

Tetapi reaksi spontan, dengan menyerahkan kekuasaan kepada negara untuk memutuskan apa yang benar, dapat menimbulkan kerugian yang lebih besar daripada informasi yang salah.

Lagi pula, itu kemungkinan besar merupakan pelanggaran hak asasi manusia.

Tantangan untuk solusi Facebook

Tujuan Facebook adalah untuk mencegah regulasi oleh pemerintah melalui regulasi mandiri.

Strategi mereka untuk mengatasi misinformasi meliputi:

- Menerapkan pembelajaran mesin untuk mendeteksi informasi yang salah

- Tim respons terhadap fakta mengubah konten yang ditandai

- Bermitra dengan organisasi pemeriksa fakta pihak ketiga untuk memverifikasi konten

Namun, Facebook sendiri akan mengakui keterbatasan pada pendekatan yang sebagian besar otomatis ini. Misalnya, bagaimana program otomatis menentukan perbedaan antara situs web satir dan misinformasi yang disengaja?

Selain itu, sejumlah besar clickbait ada untuk satu-satunya tujuan mengubah klik menjadi pendapatan iklan. Ini sering menggunakan situs templat yang terlihat seperti situs web berita resmi dengan tajuk utama yang menarik, sering kali menipu pemirsa untuk mengklik.

Situs-situs ini bukanlah informasi yang salah, tetapi juga bukan sumber informasi yang tepercaya.

Di antara satire dan clickbait, ada kolom gosip dan jurnalisme opini. Ini adalah media yang “sah” yang tidak mengklaim objektivitas. Misalnya, Ben Shapiro, seorang komentator media sayap kanan Amerika, secara terbuka mengakui bahwa situs beritanya, The Daily Wire, ada bukan untuk melaporkan berita tetapi untuk 'memenangkan perang budaya'. Putaran dan berlebihan yang khas dari penerbit ini adalah area abu-abu untuk program otomatis yang mencari informasi yang salah.

Mark Zuckerberg baru-baru ini mengatakan bahwa "Facebook melakukan lebih banyak untuk mengatasi informasi yang salah daripada perusahaan lain". Dia mungkin benar. Tapi apakah itu cukup?

Solusi yang diusulkan

Kita telah melihat bagaimana solusi untuk misinformasi adalah konflik nilai: kebebasan berekspresi vs kebebasan dari bahaya. Setiap solusi harus berusaha untuk menyeimbangkan keduanya.

Saya menawarkan solusi potensial hanya sebagai eksperimen pemikiran – lagi pula, lebih mudah untuk mencari lubang dalam pekerjaan orang lain dan jauh lebih sulit untuk menyarankan sesuatu sendiri. Memang, ini bukan bidang keahlian saya dan saran apa pun akan sangat tidak praktis!

Dengan peringatan itu, saya akan mengusulkan tiga poin:

- Jangan berusaha menyensor informasi yang salah di postingan media sosial seseorang

- Promosikan konten otoritatif melalui keterlibatan secara algoritme

- Batasi ruang gema

1. Tidak menyensor informasi yang salah di postingan individu

Ini melindungi hak asasi manusia individu. Ini juga melindungi para aktivis yang ingin menggunakan media sosial untuk memobilisasi melawan rezim politik yang menindas.

Tapi ini sama sekali bukan kebebasan berbicara.

Facebook harus terus menghapus konten yang mendorong perilaku kekerasan, intimidasi, eksploitasi, dan ujaran kebencian.

2. Mempromosikan konten otoritatif daripada konten yang menarik

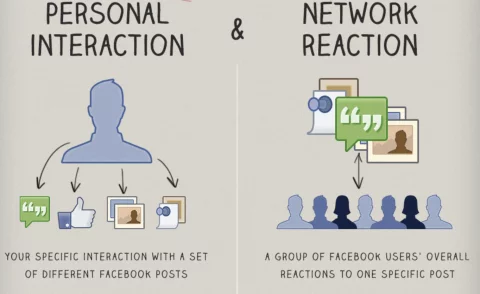

Algoritme "EdgeRank" Facebook menentukan konten apa yang ditampilkan di umpan berita Anda dan dalam urutan apa.

Ini berupaya mempersonalisasi umpan Anda melalui kombinasi minat pribadi Anda dengan bagaimana komunitas yang lebih luas berinteraksi dengan pos tertentu.

Algoritme Facebook mempromosikan konten dengan keterlibatan tinggi. Seringkali, ini berfungsi dengan baik dan Anda melihat posting dari teman dan keluarga, di samping meme viral dan video kucing. Namun, mekanisme yang sama juga mempromosikan konten emotif, yang seringkali memecah belah atau tidak benar.

Algoritma, bagaimanapun, dapat diadaptasi untuk bekerja dengan cara yang mirip dengan algoritma PageRank Google.

Google mempromosikan konten yang otoritatif – bukan menarik –. Ini dilakukan dengan menganalisis berapa kali situs web lain mereferensikan konten dalam bentuk hyperlink atau "tautan balik". Misalnya, saya merujuk Anda ke perincian terperinci tentang cara kerja algoritma PageRank Google ini adalah indikator kepercayaan halaman itu.

Ketika seseorang memposting artikel dari situs web ke Facebook, Facebook tidak perlu memeriksa fakta situs web tersebut. Sebagai gantinya, itu dapat secara algoritme menentukan otoritas situs web dengan cara yang mirip dengan Google.

Jika sumber berita otoritatif, seperti BBC, itu akan diprioritaskan dalam umpan berita daripada informasi yang salah, spam, atau clickbait.

Secara kritis, proses ini terdesentralisasi.

Tidak ada satu orang pun yang memutuskan bahwa BBC adalah pihak yang berwenang. Sebaliknya, kesimpulan ini adalah hasil dari crowdsourcing.

Jutaan situs web individu telah mereferensikan BBC, seperti halnya seorang sarjana otoritatif menerima kutipan jika pekerjaan mereka sah. Oleh karena itu, risiko pengendalian terpusat diminimalkan.

Solusi yang diusulkan ini akan mengurangi jangkauan misinformasi tanpa perlu Facebook menjadi polisi internet.

Jadi mengapa Facebook belum mencoba sesuatu seperti ini?

Yah, itu akan mengurangi pendapatan iklan mereka. Mempromosikan konten otoritatif daripada konten yang menarik akan membuat umpan berita Anda sedikit… yah, membosankan. Ini berarti lebih sedikit waktu yang dihabiskan di platform, lebih sedikit klik, dan lebih sedikit pendapatan iklan.

Ada juga masalah kecil bahwa Google memiliki kekayaan intelektual PageRank. Facebook perlu mengembangkan algoritmenya sendiri yang dapat memberikan hasil serupa, tetapi memiliki metode yang cukup berbeda untuk menghindari pelanggaran IP.

Saya memang mengatakan ini hanya eksperimen pemikiran yang dibatasi oleh ketidakpraktisan!

3. Batasi ruang gema

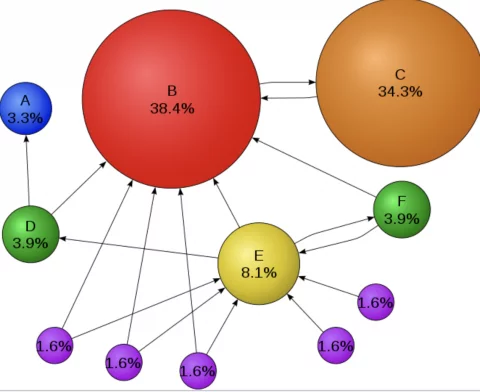

Penelitian menunjukkan bahwa informasi yang salah tidak menyebar jauh di mana ada lebih sedikit ruang gema. Lebih jauh, teori polarisasi kelompok menunjukkan bahwa ruang gema memindahkan seluruh kelompok ke posisi yang lebih ekstrem.

Ini menunjukkan bahwa mungkin informasi yang salah bukanlah masalahnya – mungkin itu adalah ruang gema…

Dalam jaringan dengan lebih sedikit kelompok pengguna yang terpisah, informasi yang salah berjalan lebih sedikit dan memiliki dampak yang berkurang pada orang-orang yang dijangkaunya. Masalahnya adalah frasa "cluster of segregated users" adalah cara teknis untuk mengatakan "komunitas"!

Komunitas adalah jantung dari Facebook, namun juga yang mendorong polarisasi.

Jadi, menghapus ruang gema tidak dapat dilakukan, tetapi langkah-langkah dapat diambil untuk membatasi bahayanya.

Langkah-langkah ini dapat mencakup:

- Facebook dapat menyediakan fitur bagi pengguna untuk mematikan personalisasi di umpan berita kami sehingga kami dapat melihat apa yang dikonsumsi orang lain, tanpa algoritme.

- Facebook dapat menandai konten yang sangat terpolarisasi atau partisan dan memberikan opsi untuk melihatnya bersama konten dari sudut pandang yang berlawanan

- Lencana verifikasi dapat ditempatkan pada konten yang mematuhi kode etik jurnalisme

Selanjutnya, pendidikan dapat diberikan untuk membantu individu melangkah keluar dari ruang gema mereka sendiri. Kami memiliki tanggung jawab untuk mencari "diskonfirmasi".

Itu tidak wajar bagi kami, tetapi menjadi warga negara yang terinformasi berarti mengonsumsi informasi yang mungkin belum tentu kami setujui.

Kita semua akan mendapat manfaat dari menjadi sedikit kurang yakin.

Ringkasan

Hubungan sosial membentuk struktur masyarakat kita. Tetapi kecenderungan kita untuk membentuk komunitas yang berpikiran sama dapat dieksploitasi, yang mengarah pada kesalahan informasi dan perpecahan. Seruan penyensoran sirene mungkin tampak sebagai solusi yang menarik, tetapi mungkin memikat kita ke arah batu yang lebih baik kita hindari.

Menghapus klaim di luar konsensus mungkin tampak diinginkan, tetapi kemungkinan akan memperburuk masalah. Penyensoran bahkan dapat membuat orang kurang mempercayai otoritas, mendorong pandangan yang lebih jahat ke bawah tanah di mana ia dapat menyebar.

Sebaliknya, kita harus mencari solusi terdesentralisasi.

Solusi yang meminimalkan bahaya misinformasi sambil menjaga hak asasi manusia kita yang mendasar – hak atas kebebasan berekspresi.