Cum ar trebui să răspundă rețelele sociale la dezinformări?

Publicat: 2022-03-09Ca societate, avem o relație complicată cu rețelele sociale. Când auzim despre hărțuirea online, dezinformarea și discursul instigator la ură, condamnăm pe bună dreptate umbra urâtă pe care o aruncă asupra societății. Dar când Rusia interzice Facebook în încercarea de a controla narațiunea din jurul Ucrainei, se simte ca și cum un drept fundamental al omului i-a fost luat.

Confuzia noastră se datorează unui conflict de valori: libertatea de exprimare vs libertatea de a face rău. Și este una dintre cele mai importante dezbateri ale timpului nostru. Dar este și o dezbatere care a devenit excesiv de simplificată, polarizată și tribală.

Care sunt cele două părți ale acestei dezbateri?

O parte este libertatea de exprimare absolutiștii care nu vor reguli. Ei au alimentat ascensiunea noilor platforme de social media, cum ar fi „Truth Social” al lui Gab și Donald Trump, care nu au limite la ceea ce postați. Au coborât rapid în naționalismul alb, antisemitism și teoriile conspirației QAnon.

Cealaltă parte caută o mai mare reglementare de stat a rețelelor sociale. Acest lucru a dus la noi inițiative precum Google Fact Check, Good Information Inc și Trusted News Summit, care încearcă să verifice ceea ce este adevărat. Această parte subestimează adesea riscurile acordării de competențe unui stat de a supraveghea internetul. Exemple în care acest lucru poate merge prost sunt represiunile din rețelele sociale ale regimurilor politice care caută să controleze fluxul liber al informațiilor.

Folosind Meta (folosesc „Facebook” pentru a distinge platforma specifică de social media) ca exemplu, voi examina ambele părți ale dezbaterii – și propun o soluție menită să rezolve conflictul de valori.

Facebook sub foc

Aproape un sfert din populația lumii se află pe Facebook, ceea ce o face cea mai populară platformă de socializare din lume.

Dar credibilitatea misiunii lor declarate, de a „construi comunitate și de a aduce lumea mai aproape împreună” a fost recent criticată.

Denunțătorii au acuzat Facebook că a ales cu bună știință profitul în detrimentul societății; Ei susțin că , prin promovarea dezinformării, Facebook diminuează integritatea procesului democratic. În plus, se susține că dezinformarea în rețelele sociale a slăbit capacitatea societății de a răspunde eficient la pandemie.

Mark Zuckerberg a răspuns cu următoarele:

„Ideea că permitem dezinformării pe platforma noastră sau că beneficiem cumva de pe urma acestui conținut este greșită.”

Apărarea Facebook este că are mai mulți parteneri de verificare decât orice altă platformă tehnologică. Eforturile lor sunt cu siguranță impresionante, eliminând peste 5 milioane de bucăți de conținut instigator la ură în fiecare lună.

De asemenea, Facebook vă va îndruma către standardele comunității lor, care enumeră 4 tipuri de conținut asupra cărora pot lua măsuri:

- Comportament violent și criminal

- Probleme de siguranță (cum ar fi hărțuirea, abuzul asupra copiilor, exploatarea)

- Conținut inacceptabil, cum ar fi porno și discursul instigator la ură

- Conținut neautentic (cum ar fi informarea greșită)

Dintre acestea, există puține controverse cu privire la punctele 1 la 3. Există un acord larg că Facebook ar trebui să acționeze pentru a preveni vătămările cauzate de violență, agresiune și discursuri instigatoare la ură.

Este punctul 4, dezinformare, care este controversat.

Creșterea dezinformării

Uneori pare că suntem pregătiți să credem simultan totul și nimic.

Și acest sentiment nu este nou.

În 1835, ziarul New York Sun a susținut că există o civilizație extraterestră pe Lună. S-a vândut atât de bine încât a stabilit New York Sun ca o publicație de top.

Cu toate acestea, dezinformarea vizată ca formă de control psihologic a crescut doar odată cu creșterea comunicării digitale.

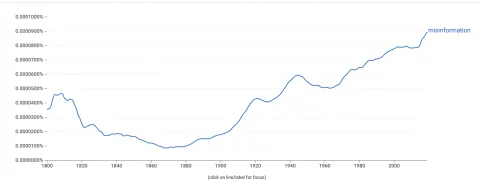

Vizualizatorul Google Ngram, care măsoară frecvența cu care cuvintele apar în cărți, arată o creștere semnificativă a utilizării de către noi a cuvântului „informare greșită”.  Pentru a înțelege acest lucru, ar trebui să înțelegem cum se răspândește dezinformarea.

Pentru a înțelege acest lucru, ar trebui să înțelegem cum se răspândește dezinformarea.

Algoritmii Facebook sunt optimizați pentru implicare – acest lucru promovează adesea conținutul care provoacă un răspuns emoțional puternic. Ceea ce este important pentru algoritm este implicarea, nu veridicitatea informațiilor partajate.

Interesant este că dezinformarea nu călătorește departe atunci când există puține camere de ecou. Conținutul va călători până la un utilizator care nu este de acord cu acesta, care ulterior îl verifică și îl dezvăluie ca dezinformare.

Cu toate acestea, grupurile online sunt din ce în ce mai segregate de convingeri ideologice. În aceste bule, dezinformarea poate călători departe prin rețea fără a fi contestată.

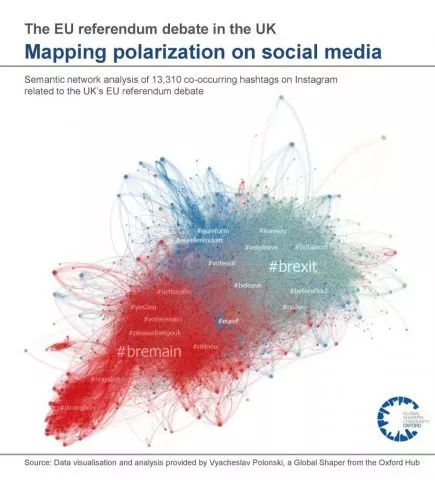

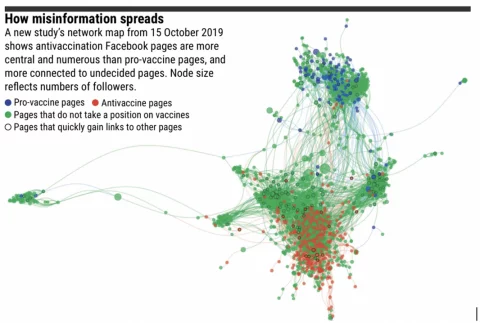

Mai jos este o reprezentare vizuală a camerelor de eco din dezbaterea referendumului UE din Marea Britanie:

Prejudecățile de confirmare este tendința noastră de a căuta și de a crede informații care se aliniază cu opiniile noastre existente. Psihologii știu că odată ce cuiva este hotărât, este greu să o schimbi. Deci, în schimb, dezinformarea urmărește să exploateze algoritmi, camere de eco și părtinire de confirmare pentru a amplifica și a consolida opiniile existente . Acest lucru poate duce la extremism.

Acest lucru este deosebit de problematic atunci când se revarsă în lumea reală.

Exemple de impactul real al dezinformarii:

- Atacurile de la Capitoliu din 2021, cu rădăcini în teoria conspirației QAnon

- Alegeri perturbate în țări precum Ghana, Nigeria, Tongo, Tunisia și Olanda

- Lipsa de absorbție a vaccinurilor Covid-19 este legată de o varietate de surse de dezinformare

- Decesele de la Charlottesville, alimentate de forurile extremiste de dreapta

- Filmări „Pizzagate”, tot cu rădăcini în QAnon

În plus, s-a descoperit că dezinformarea ne subminează încrederea în instituții și răspândește știință falsă, care afectează sănătatea publică și perturbă procesul democratic.

Deci, ce măsuri ar trebui luate?

Argumentul împotriva cenzurii

Pentru a combate daunele dezinformării, avocații pledează pentru o intervenție mai mare a statului pentru a reglementa rețelele sociale și pentru a elimina dezinformarea.

De exemplu, șeful Națiunilor Unite, secretarul general Antonio Guterres, a cerut reguli globale pentru a reglementa conținutul rețelelor sociale.

„Nu cred că putem trăi într-o lume în care se acordă prea multă putere unui număr redus de companii. Avem nevoie de un nou cadru de reglementare cu reguli care să permită ca acest lucru să se facă în conformitate cu legea.”

~ Șeful Națiunilor Unite, secretarul general Antonio Guterres

Este greu să fii de acord cu sentimentul din spatele acestei afirmații. Fără verificări adecvate, puterea companiilor tehnologice ar putea depăși controlul nostru.

Cu toate acestea, înainte de a acorda competențe organismelor care să le permită să decidă ce informații consumăm, ar trebui să luăm în considerare potențialele dezavantaje.

În primul rând, cenzurarea postărilor pe rețelele sociale poate fi o încălcare a articolului din Legea privind drepturile omului, care prevede:

„Orice persoană are dreptul la libertatea de exprimare. Acest drept include libertatea de a avea opinii și de a primi și de a influența informații și idei fără interferența autorității publice.”

~ Articolul 10 din Legea drepturilor omului

Interesant este că guvernul Regatului Unit caută în prezent să reformeze Legea drepturilor omului, înlocuindu-le cu o „Carta drepturilor”.

O modificare propusă este că drepturile omului ar putea fi încălcate dacă „protejează interesul public mai larg” (pagina 56, Reforma drepturilor omului). Această modificare poate permite o cenzură mai mare a dezinformării de către stat.

Un al doilea argument împotriva cenzurii dezinformarii este că aceasta este deschisă pentru abuz de către regimurile politice care doresc să centralizeze puterea. Puterea de a decide ce este – și ce nu este – dezinformare ar putea duce la o reprimare a protestelor, acțiunilor colective și activismului politic.

Ar fi putut avea loc Primăvara Arabă dacă Twitter și Facebook ar fi fost supravegheate de autorități?

În timp ce rolul rețelelor sociale în Primăvara arabă este probabil exagerat de jurnaliști, o analiză academică atentă a constatat că rețelele sociale au condus într-adevăr la o creștere a acțiunilor colective pozitive în țările cu guverne opresive.

În plus, ne putem uita la istoricul țărilor care au interzis platformele de social media:

- China

- Rusia

- Iranul

- Coreea de Nord

Toate aceste țări sunt enumerate în „Indexul libertății în lume” ca având unele dintre cele mai proaste libertăți civile din lume. Nu susțin că au libertăți civile slabe pentru că nu permit rețelele sociale, mai degrabă observând că statele care încearcă să controleze informațiile online tind să aibă înregistrări proaste când vine vorba de drepturile omului.

Chiar dacă cenzura de stat nu este soluția, avem o problemă.

Încrederea în sursele tradiționale de știri se evaporă rapid. În acest vid se năpustește dezinformarea, creând un vânt suficient de puternic încât să ne zdrobească stăpânirea pe ceea ce este adevărat. Acest lucru a afectat societatea prin ezitarea la vaccin, extremismul sporit și perturbarea proceselor democratice.

Dar o reacție bruscă, cu predarea statului a puterii de a decide ce este adevărat, ar putea crea un rău mai mare decât dezinformarea.

Și oricum, este probabil o încălcare a drepturilor omului.

Provocări pentru soluția Facebook

Scopul Facebook este de a preveni reglementarea de către guverne prin autoreglementare.

Strategia lor de a combate dezinformarea include:

- Aplicarea învățării automate pentru a detecta dezinformarea

- Echipele de răspuns la modificarea faptelor conținutul semnalat

- Parteneriat cu organizații terțe de verificare a faptelor pentru a verifica conținutul

Cu toate acestea, Facebook însuși va admite limitări ale acestei abordări în mare măsură automatizate. De exemplu, cum ar determina un program automat diferența dintre site-urile web satirice și dezinformarea intenționată?

În plus, există cantități mari de clickbait cu singurul scop de a transforma clicurile în venituri din publicitate. Acestea folosesc adesea site-uri șablon care arată ca site-uri oficiale de știri cu titluri atrăgătoare, deseori păcălind spectatorii să facă clic.

Aceste site-uri nu sunt dezinformări, dar nici surse de încredere de informare.

Între satiră și clickbait, există rubrici de bârfă și jurnalism de opinie. Aceasta este o mass-media „legitimă” care nu pretinde obiectivitate. De exemplu, Ben Shapiro, un comentator media american de dreapta, admite deschis că site-ul său de știri, The Daily Wire, există nu pentru a raporta știrile, ci pentru a „câștiga un război cultural”. Rotirea și exagerarea tipice acestor editori este o zonă gri pentru programele automate care caută dezinformare.

Mark Zuckerberg a spus recent că „Facebook face mai mult pentru a aborda dezinformarea decât orice altă companie”. Poate avea dreptate. Dar este suficient?

O soluție propusă

Am văzut cum soluția pentru dezinformare este un conflict de valori: libertatea de exprimare vs libertatea de a face rău. Orice soluție trebuie să caute să echilibreze cele două.

Ofer o soluție potențială doar ca experiment de gândire – la urma urmei, este mai ușor să faci găuri în munca altora și mult mai greu să sugerezi ceva tu însuți. Desigur, aceasta nu este domeniul meu de expertiză și orice sugestie va fi în cel mai bun caz impracticabilă!

Cu acest avertisment spus, aș propune trei puncte:

- Nu căutați să cenzurați dezinformările în postările unei persoane pe rețelele sociale

- Promovați conținut cu autoritate în detrimentul angajamentului algoritmic

- Limitați camerele de eco

1. Nu cenzura dezinformările în postările individuale

Acest lucru protejează drepturile omului ale unei persoane. De asemenea, îi protejează pe activiștii care doresc să folosească rețelele sociale pentru a se mobiliza împotriva regimurilor politice opresive.

Dar aceasta nu este libertatea de exprimare cu orice preț.

Facebook ar trebui să continue să elimine conținutul care încurajează comportamentul violent, hărțuirea, exploatarea și discursul instigator la ură.

2. Promovarea conținutului cu autoritate în detrimentul conținutului captivant

Algoritmul „EdgeRank” al Facebook determină ce conținut este afișat în fluxul de știri și în ce ordine.

Acesta caută să vă personalizeze feedul printr-o combinație de interese personale cu modul în care comunitatea mai largă a interacționat cu o anumită postare.

Algoritmul Facebook promovează conținut cu implicare ridicată. Adesea, acest lucru funcționează bine și vezi postări de la prieteni și familie, alături de meme virale și videoclipuri cu pisici. Cu toate acestea, același mecanism promovează și conținutul emoțional, care este adesea dezbinător sau neadevărat.

Cu toate acestea, algoritmul ar putea fi adaptat pentru a funcționa într-un mod similar cu algoritmul PageRank de la Google.

Google promovează conținut cu autoritate, spre deosebire de conținut captivant. Face acest lucru analizând de câte ori alte site-uri fac referire la o bucată de conținut sub formă de hyperlink-uri sau „back-link-uri”. De exemplu, dacă vă referim la această defalcare detaliată a modului în care funcționează algoritmul PageRank Google este un indicator al credibilității acelei pagini.

Când o persoană postează un articol de pe un site web pe Facebook, Facebook nu trebuie neapărat să verifice site-ul. În schimb, ar putea determina algoritmic autoritatea site-ului web într-un mod similar cu Google.

Dacă sursa de știri este autorizată, cum ar fi BBC, aceasta ar avea prioritate în fluxurile de știri față de dezinformarea, spam-ul sau clickbait.

În mod critic, acest proces este descentralizat.

Nimeni nu a decis că BBC este autoritară. În schimb, această concluzie este rezultatul crowdsourcing-ului.

Milioane de site-uri web individuale au făcut referire la BBC, la fel cum un savant autorizat primește citate dacă munca lor este legitimă. Prin urmare, riscurile controlului centralizat sunt minimizate.

Această soluție propusă ar diminua raza de dezinformare fără a fi nevoie ca Facebook să devină poliția internetului.

Deci, de ce Facebook nu a încercat deja așa ceva?

Ei bine, le-ar diminua veniturile din publicitate. Promovarea conținutului cu autoritate în detrimentul conținutului captivant ar face ca fluxul de știri să fie puțin... ei bine, plictisitor. Acest lucru înseamnă mai puțin timp petrecut pe platformă, mai puține clicuri și mai puține venituri din publicitate.

Există, de asemenea, mica problemă că Google deține proprietatea intelectuală a PageRank. Facebook ar trebui să-și dezvolte propriul algoritm care ar putea oferi rezultate similare, dar să aibă metode suficient de diferite pentru a evita încălcarea IP.

Am spus că acestea au fost doar experimente gândite limitate de impracticabilitate!

3. Limitați camerele de eco

Cercetările sugerează că dezinformarea nu călătorește departe acolo unde există mai puține camere de ecou. În plus, teoria polarizării grupului sugerează că camerele de ecou mută grupuri întregi în poziții mai extreme.

Acest lucru sugerează că poate dezinformarea nu este problema - poate sunt camerele de ecou...

Într-o rețea cu mai puține grupuri de utilizatori segregați, dezinformarea călătorește mai puțin departe și are un impact diminuat asupra celor pe care îi ajunge. Problema este expresia „cluster de utilizatori segregați” este un mod tehnic de a spune „comunitatea”!

Comunitatea este în centrul Facebook, dar este și ceea ce provoacă polarizarea.

Deci, îndepărtarea camerelor de eco nu este viabilă, dar ar putea fi luate măsuri pentru a limita daunele acestora.

Acești pași ar putea include:

- Facebook ar putea oferi utilizatorilor o funcție care să dezactiveze personalizarea în fluxurile noastre de știri, astfel încât să putem vedea ce consumă alții, fără algoritm.

- Facebook ar putea semnala conținut extrem de polarizat sau partizan și poate oferi opțiuni pentru a-l vizualiza alături de conținut din punct de vedere opus

- Ecusoanele de verificare ar putea fi plasate pe conținut care respectă codul de conduită al jurnalismului

Mai mult, ar putea fi oferită educație pentru a ajuta indivizii să iasă din propriile camere de ecou. Avem responsabilitatea de a căuta „desconfirmare”.

Nu este firesc pentru noi, dar a fi un cetățean informat înseamnă a consuma informații cu care s-ar putea să nu fim neapărat de acord.

Cu toții am beneficia de a fi puțin mai puțin siguri.

rezumat

Legăturile sociale formează structura societății noastre. Însă însăși tendința noastră de a forma comunități asemănătoare poate fi exploatată, ceea ce duce la dezinformare și divizare. Apelul de sirenă al cenzurii poate părea o soluție atrăgătoare, dar ne poate ademeni către o stâncă pe care e mai bine să o evităm.

Eliminarea afirmațiilor în afara consensului poate părea de dorit, dar este probabil să înrăutățească problema. Cenzura poate chiar face ca oamenii să aibă mai puțină încredere în autoritate, împingând opiniile mai rău intenționate în subteran acolo unde s-ar putea răspândi.

În schimb, ar trebui să căutăm soluții descentralizate.

Soluții care reduc la minimum daunele dezinformarii, salvând în același timp drepturile fundamentale ale omului – dreptul la libertatea de exprimare.