Facebook limita el intercambio de contenido en Etiopía para limitar la difusión de información errónea y el discurso de odio

Publicado: 2022-04-08Entre los diversos problemas y preocupaciones destacados por la reciente filtración de datos internos de 'Facebook Files' estaba la sugerencia de que compartir contenido en Facebook es en realidad una de las acciones más dañinas, ya que la facilidad de amplificar contenido cuestionable simplemente tocando 'Compartir' aumenta significativamente la cantidad de personas haciendo exactamente eso.

De hecho, uno de los informes más recientes compartidos por la denunciante de Facebook, Frances Haugen, indicó que la propia investigación de Facebook ha demostrado que la opción 'Compartir' es dañina, particularmente en relación con las acciones.

Como informa Alex Kantrowitz en su boletín Big Technology :

El informe señaló que las personas tienen cuatro veces más probabilidades de ver información errónea cuando encuentran una publicación a través de un recurso compartido, algo así como un retweet de un retweet, en comparación con una foto o un enlace típicos en Facebook. Agregue algunas acciones más a la cadena, y las personas tienen entre cinco y diez veces más probabilidades de ver información errónea. Empeora en ciertos países. En India, las personas que se encuentran con "comparticiones profundas", como los llaman los investigadores, tienen veinte veces más probabilidades de ver información errónea.

En otras palabras, es mucho más probable que el contenido que tiende a ser compartido repetidamente incluya información errónea, lo que tiene sentido dada la naturaleza más lasciva y divisiva de tales afirmaciones.

La pregunta entonces, sin embargo, es qué va a hacer Facebook o Meta al respecto, con Haugen afirmando que la compañía ha ignorado estos hallazgos.

Aunque eso no es del todo correcto. Hoy, en una actualización de las medidas que se implementaron en Facebook específicamente para detener la difusión de información errónea y discursos de odio en Etiopía antes de las recientes elecciones de la nación, Meta incluyó esta nota:

“ Para abordar el posible contenido viral, seguimos reduciendo el contenido que ha sido compartido por una cadena de dos o más personas. También continuamos reduciendo la distribución de contenido que nuestra tecnología de detección proactiva identifica como probable de violar nuestras políticas contra el discurso de odio, así como de cuentas que recientemente y repetidamente publicaron contenido violatorio”.

Entonces, Meta en realidad está buscando implementar ciertas restricciones en el intercambio de publicaciones, en línea con sus hallazgos anteriores.

Lo cual es bueno, y dada la investigación, tiene sentido. Pero, de nuevo, si Meta reconoce que compartir acciones es un problema potencial, que puede contribuir a la amplificación de publicaciones dañinas, ¿por qué no implementar esto como una regla general, o incluso más, por qué no eliminar la opción 'Compartir' por completo para eliminar este tipo de amplificación rápida?

Para ser claros, si Facebook eliminara el botón 'Compartir', los usuarios aún podrían compartir contenido.

- Los usuarios aún podrían publicar enlaces de artículos en sus propias actualizaciones, pero sería más probable que incluyeran sus propios pensamientos personales en cada uno, dado que tendrían que crear una nueva publicación.

- Los usuarios aún podrían reaccionar y dar "Me gusta" a las publicaciones, lo que luego aumenta la exposición a sus conexiones y redes más amplias, a través de la actividad de participación.

- Los usuarios aún podrían comentar las publicaciones, lo que también aumenta la exposición según el algoritmo que busca mostrar el contenido más atractivo a más usuarios.

Teóricamente, las personas también podrían compartir publicaciones a través de mensajes, según esta iteración de la interfaz de usuario de publicaciones de Facebook que Facebook probó en 2018, que reemplazó el botón "Compartir" por uno de "Mensaje".

Por lo tanto, todavía habría opciones para interactuar con el contenido a través de Facebook, pero la investigación sugiere que tener una opción rápida para 'Compartir' puede contribuir significativamente a la rápida difusión de afirmaciones cuestionables.

Tal vez, al eliminarlo e idealmente obligar a los usuarios a tomarse más tiempo y pensar en su proceso, eso disminuiría el intercambio ciego y ralentizaría la difusión de tales publicaciones.

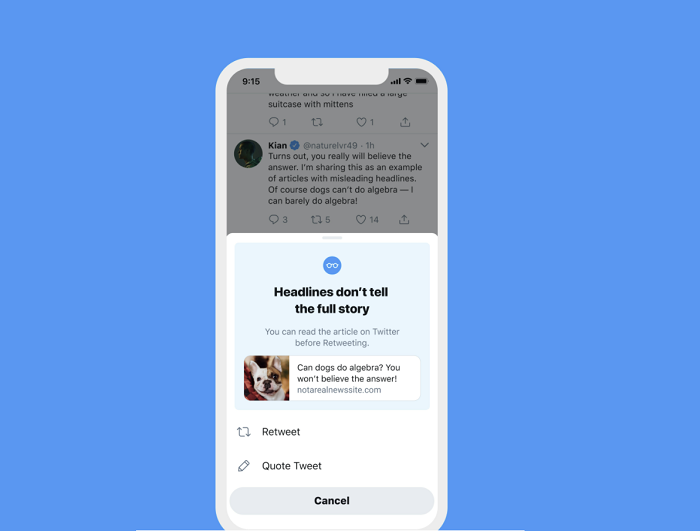

Esa es la misma teoría que usó Twitter cuando eliminó el retuiteo directo como una opción para los usuarios estadounidenses en octubre del año pasado, antes de las elecciones presidenciales.

Como puede ver aquí, en lugar de permitir a los usuarios retuitear cualquier afirmación a ciegas y rápidamente, Twitter prefirió que los usuarios usaran su opción 'Citar tuit' para, idealmente, hacer que las personas pensaran un poco más profundamente sobre lo que quieren. estaban compartiendo, en lugar de simplemente volver a amplificar el contenido y las citas.

Eso tuvo algún impacto. Después de restablecer los retweets regulares en diciembre, Twitter notó que el uso de Quote Tweets aumentó como resultado, "pero el 45% de ellos incluía afirmaciones de una sola palabra y el 70% tenía menos de 25 caracteres".

En otras palabras, los usuarios dudaron un poco más en su actividad de compartir, pero no inspiró mucho más contexto en el proceso.

Pero, de nuevo, tal vez eso es todo lo que se requiere, tal vez, todo lo que necesita es que las personas se tomen un minuto, piensen en el mensaje por un segundo, y eso puede ser suficiente para evitar que difundan información errónea viral y afirmaciones falsas.

Eso funcionó con las alertas emergentes de Twitter sobre artículos que los usuarios intentan retuitear sin abrir el enlace del artículo y leer la publicación primero, y los usuarios abren artículos con un 40% más de frecuencia como resultado de esa mayor fricción.

Facebook ahora ha adaptado lo mismo, indicando nuevamente que hay valor en este enfoque, y nuevamente, con su propia investigación que muestra que las acciones pueden ser un elemento negativo, ¿por qué no simplemente eliminar la opción para generar más consideración en el proceso?

Por supuesto, es probable que haya impactos en los editores, que podrían ver caer su tráfico de referencia, mientras que también afectaría el compromiso de Facebook en general, al reducir las opciones para la interacción posterior.

¿Es por eso que Meta no lo haría? Quiero decir, tiene los datos y ya está implementando sus hallazgos en ciertas situaciones para evitar daños potenciales. Meta sabe que un cambio en su proceso de compartir podría tener un impacto positivo.

¿Por qué no implementar restricciones en todos los ámbitos?

Sería un gran paso, seguro, y hay varias consideraciones dentro de esto. Pero la investigación y otros indicadores muestran que Meta sabe que esto sería efectivo.

Entonces, ¿por qué no hacerlo y reducir el daño potencial a través de una redistribución ciega?