Facebook schränkt das Teilen von Inhalten in Äthiopien ein, um die Verbreitung von Fehlinformationen und Hassreden zu begrenzen

Veröffentlicht: 2022-04-08Unter den verschiedenen Problemen und Bedenken, die durch das jüngste interne Datenleck von „Facebook-Dateien“ hervorgehoben wurden, war der Vorschlag, dass das Teilen von Inhalten auf Facebook tatsächlich eine der schädlichsten Aktionen ist, da die Leichtigkeit, fragwürdige Inhalte zu verstärken, indem man einfach auf „Teilen“ tippt, dies erheblich erhöht Menge Leute, die genau das tun.

Tatsächlich weist einer der jüngsten Berichte der Facebook-Whistleblowerin Frances Haugen darauf hin, dass eigene Recherchen von Facebook gezeigt haben, dass die Option „Teilen“ schädlich ist, insbesondere in Bezug auf Aktien.

Wie von Alex Kantrowitz in seinem Newsletter Big Technology berichtet :

„ Der Bericht stellte fest, dass Menschen mit viermal höherer Wahrscheinlichkeit Fehlinformationen sehen, wenn sie auf einen Beitrag über eine Freigabe einer Freigabe stoßen – ähnlich wie ein Retweet eines Retweets – im Vergleich zu einem typischen Foto oder Link auf Facebook. Fügen Sie der Kette ein paar weitere Aktien hinzu, und die Wahrscheinlichkeit, dass Menschen Fehlinformationen sehen, ist fünf- bis zehnmal höher. In manchen Ländern wird es noch schlimmer. In Indien sehen Menschen, die auf „deep reshares“, wie die Forscher sie nennen, stoßen, zwanzigmal häufiger Fehlinformationen.“

Mit anderen Worten, die Inhalte, die dazu neigen, wiederholt geteilt zu werden, enthalten viel wahrscheinlicher Fehlinformationen – was angesichts der anzüglicheren und spaltenderen Natur solcher Behauptungen sinnvoll ist.

Die Frage ist dann jedoch, was Facebook oder Meta dagegen tun wird, wobei Haugen behauptet, dass das Unternehmen diese Erkenntnisse ignoriert hat.

Auch wenn das nicht ganz richtig ist. Heute, in einem Update zu den Maßnahmen, die speziell auf Facebook umgesetzt wurden, um die Verbreitung von Fehlinformationen und Hassreden in Äthiopien vor den jüngsten Wahlen des Landes zu stoppen, fügte Meta diese Anmerkung hinzu:

„ Um möglichen viralen Inhalten entgegenzuwirken, reduzieren wir weiterhin Inhalte, die von einer Kette von zwei oder mehr Personen geteilt wurden. Wir reduzieren auch weiterhin die Verbreitung von Inhalten, von denen unsere proaktive Erkennungstechnologie erkennt, dass sie wahrscheinlich gegen unsere Richtlinien gegen Hassreden verstoßen, sowie von Konten, die kürzlich und wiederholt verletzende Inhalte gepostet haben.“

Meta versucht also tatsächlich, bestimmte Einschränkungen für das Teilen von Beiträgen einzuführen, in Übereinstimmung mit seinen früheren Erkenntnissen.

Was gut ist und angesichts der Forschung Sinn macht. Aber andererseits, wenn Meta anerkennt, dass Shares of Shares ein potenzielles Problem darstellen, das zur Verstärkung schädlicher Posts beitragen kann, warum sollte man dies nicht als pauschale Regel implementieren – oder noch weiter, warum nicht die „Share“-Option vollständig entfernen? diese Art der schnellen Verstärkung eliminieren?

Um es klar zu sagen: Wenn Facebook die „Teilen“-Schaltfläche entfernen würde, könnten Benutzer immer noch Inhalte teilen.

- Benutzer könnten weiterhin Artikellinks in ihren eigenen Updates posten, aber sie würden eher ihre eigenen persönlichen Gedanken zu jedem hinzufügen, da sie einen neuen Beitrag erstellen müssten

- Die Benutzer könnten weiterhin auf Posts reagieren und diese mit „Gefällt mir“ markieren, was dann die Sichtbarkeit ihrer Verbindungen und breiteren Netzwerke durch Interaktionsaktivitäten erhöht

- Benutzer könnten weiterhin Beiträge kommentieren, was auch die Sichtbarkeit erhöht, da der Algorithmus versucht, mehr Benutzern die ansprechendsten Inhalte zu zeigen

Theoretisch könnten die Leute auch weiterhin Beiträge per Nachricht teilen, wie in dieser Iteration der Facebook-Post-Benutzeroberfläche, die Facebook 2018 getestet hat und die stattdessen den „Teilen“-Button durch einen „Nachricht“-Button ersetzt hat.

Es gäbe also immer noch Möglichkeiten, sich über Facebook mit Inhalten zu beschäftigen, aber die Forschung legt nahe, dass eine schnelle „Teilen“-Option erheblich zur schnellen Verbreitung fragwürdiger Behauptungen beitragen kann.

Vielleicht würde es das blinde Teilen verringern und die Verbreitung solcher Beiträge verlangsamen, indem man es entfernt und die Benutzer im Idealfall dazu zwingt, mehr Zeit und Überlegungen in ihren Prozess zu investieren.

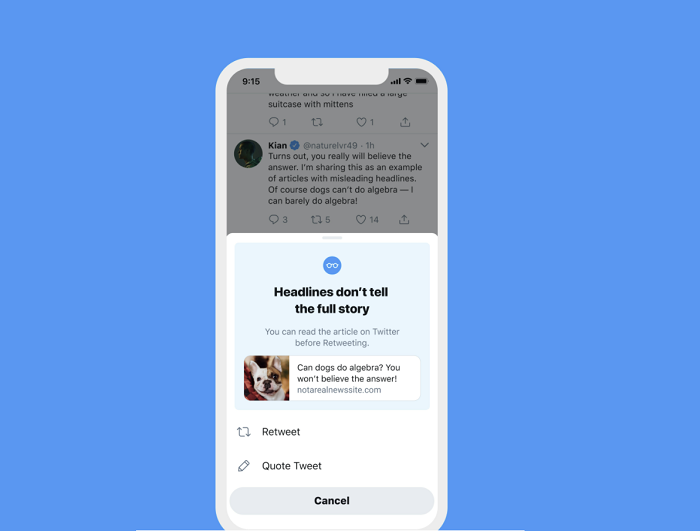

Das ist die gleiche Theorie, die Twitter verwendet hat, als es im Oktober letzten Jahres im Vorfeld der Präsidentschaftswahlen direktes Retweeten als Option für US-Nutzer entfernte .

Wie Sie hier sehen können, hat Twitter, anstatt den Benutzern zu erlauben, jegliche Behauptungen blind und schnell zu retweeten, stattdessen standardmäßig die Option „Tweet zitieren“ verwendet, um die Leute im Idealfall dazu zu bringen, etwas tiefer darüber nachzudenken, was sie tun teilten, anstatt nur Inhalte und Zitate erneut zu verstärken.

Das hatte einige Auswirkungen. Nach der Wiedereinführung regelmäßiger Retweets im Dezember stellte Twitter fest , dass die Verwendung von Zitat-Tweets infolgedessen zunahm, „aber 45 % von ihnen enthielten Bestätigungen aus einem einzigen Wort und 70 % hatten weniger als 25 Zeichen“.

Mit anderen Worten, die Benutzer waren etwas zögerlicher bei ihren Freigabeaktivitäten, aber es inspirierte nicht viel mehr Kontext im Prozess.

Aber andererseits ist das vielleicht alles, was erforderlich ist – vielleicht brauchen Sie nur, dass sich die Leute eine Minute Zeit nehmen, um eine Sekunde über die Nachricht nachzudenken, und das kann durchaus ausreichen, um sie daran zu hindern, virale Fehlinformationen und falsche Behauptungen zu verbreiten.

Das hat mit den Pop-up-Benachrichtigungen von Twitter zu Artikeln funktioniert, die Benutzer versuchen zu retweeten, ohne den Artikellink tatsächlich zu öffnen und den Beitrag zuerst zu lesen, wobei Benutzer Artikel aufgrund dieser erhöhten Reibung 40 % häufiger öffnen .

Facebook hat das Gleiche jetzt angepasst, was wiederum darauf hinweist, dass dieser Ansatz einen Wert hat – und wieder einmal, mit eigenen Untersuchungen, die zeigen, dass Aktien ein negatives Element sein können, warum nicht einfach die Option entfernen, um mehr Rücksicht in den Prozess zu fordern?

Natürlich würde es wahrscheinlich Auswirkungen auf Publisher geben, die möglicherweise einen Rückgang ihres Referral-Traffics verzeichnen würden, während sich dies auch auf das Facebook-Engagement insgesamt auswirken würde, da die Optionen für die Post-Interaktion eingeschränkt würden.

Ist das der Grund, warum Meta es nicht tun würde? Ich meine, es hat die Daten und setzt seine Erkenntnisse bereits in bestimmten Situationen um, um potenziellen Schaden zu vermeiden. Meta weiß, dass eine Änderung in seinem Freigabeprozess positive Auswirkungen haben könnte.

Warum nicht flächendeckend Beschränkungen einführen?

Es wäre sicherlich ein großer Schritt, und es gibt verschiedene Überlegungen dazu. Aber die Forschung und andere Indikatoren zeigen alle, dass Meta weiß, dass dies effektiv wäre.

Warum es also nicht tun und den potenziellen Schaden durch blinde Umverteilung reduzieren?