重复内容 SEO:如何检查重复内容

已发表: 2022-06-14重复的内容可能会影响您的哪些页面出现在搜索结果中并浪费您的抓取预算。 幸运的是,有一些方法可以识别重复内容并将其从您的网站或 Google 的索引中删除,以防止它对您的排名能力产生负面影响。

什么是重复内容?

当相同的内容出现在多个具有唯一 URL 的位置时,就会出现重复的内容。

内容不需要完全匹配才能注册为重复内容——它也可以是谷歌所说的“明显相似”。 即使某些文本可能不同,该内容本质上“足够接近”以被视为重复内容。

大多数网站所有者努力确保他们的内容是新鲜的和原创的,但网络上仍然存在大量重复的内容。 有时网站所有者甚至没有意识到这一点。 那么这是怎么发生的呢?

为什么会出现重复的内容?

Web 上的大多数重复内容是由于对诸如页面的打印友好版本、多个不同 URL 上或链接到的产品以及生成同一页面的桌面版和精简移动版的讨论论坛等事物的索引而发生的.

但这些并不是您最终会在您的网站上出现重复内容的唯一方法。 以下是更多示例,说明重复内容如何在您的网站内部和其他网站的外部发生。

内部生成的重复项

明显相似的产品页面

有时故意创建明显相似的页面是有意义的,尤其是在电子商务中。 例如,假设您在两个不同的国家/地区销售相同的产品。 在这种情况下,您可以选择拥有两个几乎相同的页面,除了一个可能以美元显示价格,而另一个以加元显示价格。

另一个例子是产品页面看起来非常相似,因为它们具有相同的副本,唯一真正的区别是不同的产品图片、产品名称和产品价格。

内容管理系统

有时,内容管理系统会创建您甚至可能不知道的重复内容。 一些系统会自动为搜索添加标签和 URL 参数,从而产生指向完全相同内容的多个路径。

网址变体

如果您有包含相同内容的不同 URL 变体,您也可能会得到重复的内容。 如前所述,内容管理系统可能会自行执行此操作,您最终可能会得到两个 URL 变体,例如https://www.website.com/blog1和https://www.website.com/blogs/blog1 。 其他 URL 变体(如尾部斜杠或大写 URL)可能会导致相同的问题。

发生这种情况时,Google 可能不知道要对哪个页面进行排名,并且一些外部来源可能会链接到其中一个页面,而其他来源可能会链接到重复页面,从而在此过程中破坏您页面的链接资产。

HTTP 与 HTTPS 和 www 与非 www

大多数网站都可以使用或不使用 www 或通过 HTTP 或 HTTPS URL 访问。 但是,如果您的网站配置不正确,Google 可能会将其中多个页面的页面编入索引,从而导致内容重复。

打印机友好和移动友好的 URL

托管在与原始页面不同的 URL 的打印友好或移动友好页面将导致重复内容,除非它们没有正确编入索引。

会话 ID

会话 ID 可以成为跟踪访问您网站的访问者的有用工具。 这通常通过向 URL 添加一个长会话 ID 字符串来完成。 因为每个会话 ID 都是唯一的,所以这会创建一个新 URL 并复制您的内容。

UTM 参数

参数可以跟踪来自各种来源的传入访问者。 与会话 ID 一样,尽管页面内容相同,但它们会生成唯一的 URL,因此如果被编入索引,则会创建重复的内容。

外部生成的重复项

联合内容

将您的内容联合到网络上的其他网站可能是为您的网站带来更多流量并让您的名字出现的好方法。 但是,如果未使用正确的规范标头标签格式化,此内容仍可能显示为重复内容。 例如,在 Medium 文章上使用规范标签可以保护您的原始内容不被注册为重复内容。

抄袭

虽然大多数重复内容本质上是非恶意的,但一些网站管理员确实会故意复制内容,以寻求从他们自己制作的内容中获利。

重复内容搜索引擎优化:为什么重要?

如果重复的内容如此频繁地发生,为什么这很重要? 这里有五种方式可以影响你在搜索结果中排名的能力。

1. 谷歌重复内容处罚

谷歌不会直接惩罚重复的内容——大多数时候。 如果 Google 认为您网站上的重复内容具有“欺骗性”并且“旨在操纵搜索引擎结果”,那么它可能会通过应用重复内容处罚来采取行动。 因此,即使这种情况并不经常发生,根据 Google 重复内容指南,如果您的重复内容足够恶劣并被认为是出于恶意目的,您最终仍可能面临直接处罚。

Google 对重复内容的处罚很少见,因此更紧迫的问题是重复内容与 SEO 之间的关系。

2. 指数膨胀

当搜索引擎爬虫访问和索引不重要或低质量的内容时,就会发生索引膨胀——比如我提到的那些打印友好的页面。 这会影响您让重要页面排名的能力,因为搜索引擎不知道向用户推荐您的内容的哪个版本,并且可能排名与您希望的不同版本。 它还会影响爬网预算。

3. 抓取预算

谷歌限制了它花在抓取网站上的时间。 Google 为抓取您的网站并将其编入索引而提供的资源量就是您的抓取预算。 当您有大量重复内容时,您就有可能将抓取预算浪费在不那么重要的页面上。

4.关键词蚕食

如果一个页面的多个副本正在排名,那么您的页面将相互竞争相同的关键字和可见性。 跟别人竞争已经够难的了,为什么还要跟自己竞争呢?

最终,您不能只忽略 SEO 重复内容问题。 只要有可能,尽量合并或删除重复的内容。

5. 减少链接资产

假设 Google 决定对您的两个明显相似的页面进行排名。 他们如何知道是否将所有内容的价值归因于一个页面,或者是否应该在两个页面之间拆分权限、链接公平性和信任? 这种情况会降低您内容的 SEO 价值,导致其表现不佳。

您的反向链接的链接资产也将在两个页面之间分配,具体取决于其他站点是否选择链接到。

如何检查您自己网站上的重复内容

在您的网站上查找重复内容既免费又简单。 使用免费版本的 Screaming Frog 和 Siteliner 有条不紊地抓取您的网站并识别任何准确或接近重复的页面。

如何使用 Screaming Frog 发现重复内容

Screaming Frog 是一个网站爬虫和 SEO 审计工具,可以帮助您识别网站上的重复内容问题。 以下是如何使用 Screaming Frog 免费扫描多达 500 个 URL。

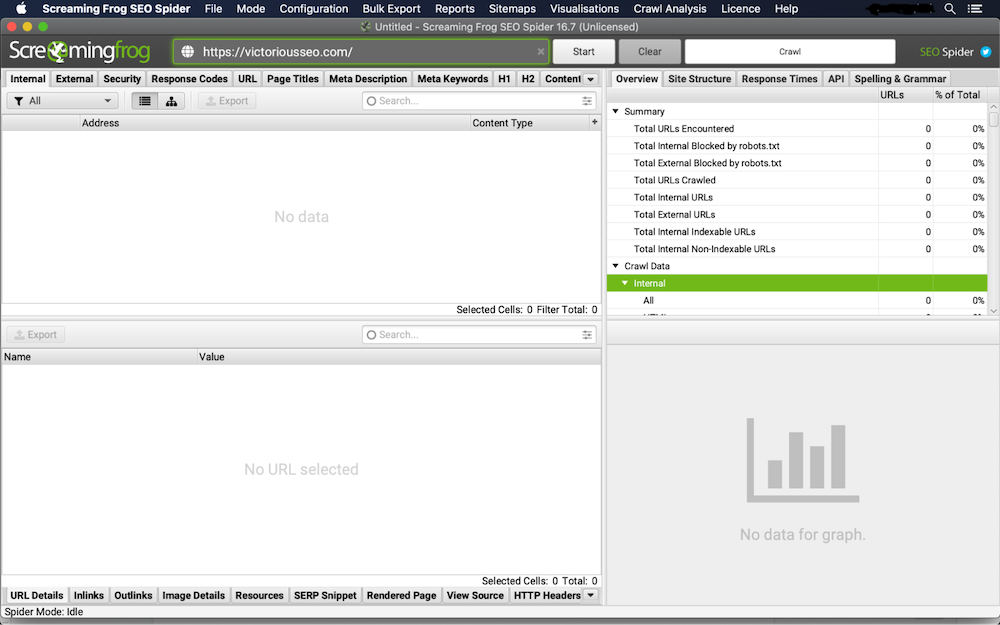

1. 使用 SEO Spider 抓取您的网站

首先,下载并打开 Screaming Frog。 在“输入蜘蛛的 URL”字段中输入您要抓取的网站的 URL,然后单击“开始”。

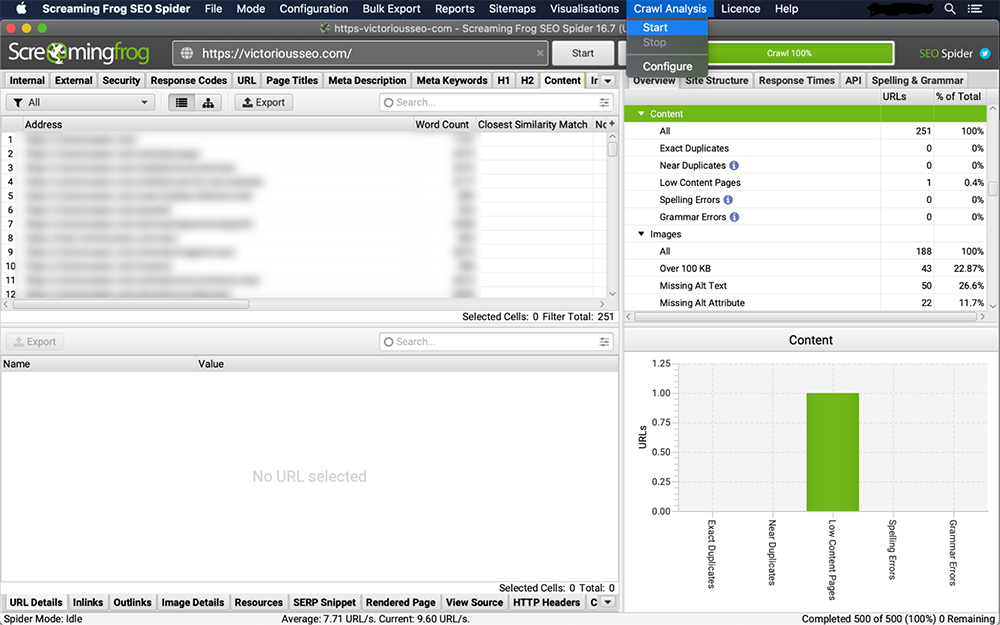

2. 检查“内容”选项卡中的重复项

单击“内容”选项卡以检查确切的重复项和近似重复项。 您将能够实时查看确切的重复项,但您需要执行“抓取分析”以查看接近重复项的列表。

3.检查近乎重复

单击菜单栏上的“抓取分析”选项卡,然后从下拉菜单中选择“开始”。

爬网分析完成后,您将看到填充的近乎重复的列。 您会知道它已完成,因为“分析”进度条将显示 100%,并且几乎重复的过滤器将不再显示“需要抓取分析”消息。

4. 在“内容”选项卡下查看重复项

“最接近的相似性匹配”,“不。 爬网分析完成后,将填充“近重复项”和“地址”列。

“完全重复”过滤器将根据 HTML 代码扫描显示彼此相同的页面。 设置的相似性阈值决定了什么是“接近重复项”。 要更改阈值,请转到“配置→蜘蛛→内容。 默认情况下,此阈值设置为 90%,但您可以随意将其更改为您喜欢的任何值。

扫描完成后,手动检查弹出的任何页面,如完全重复或接近重复。

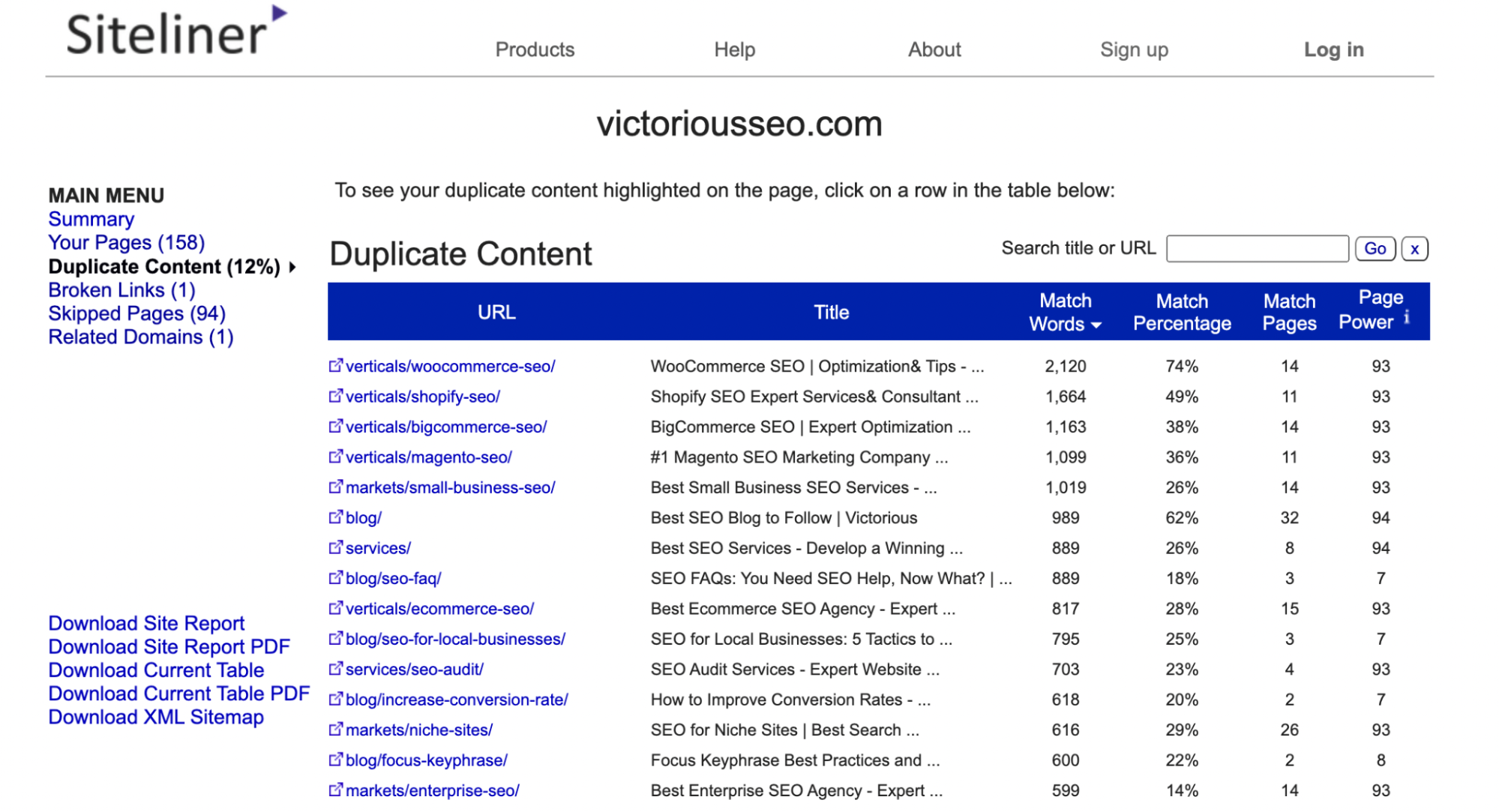

如何使用 Siteliner 发现重复内容

Siteliner 是另一种免费工具,可用于扫描您的网站(或任何网站)以查找重复内容。 但是,免费版本将限制您每 30 天使用一次,并将结果数量限制为 250 页。 如果您需要执行多次搜索或想要查看更多结果,请注册高级版本。

要使用 Siteliner 检查重复内容,只需在其主页上的搜索框中输入您要搜索的 URL。

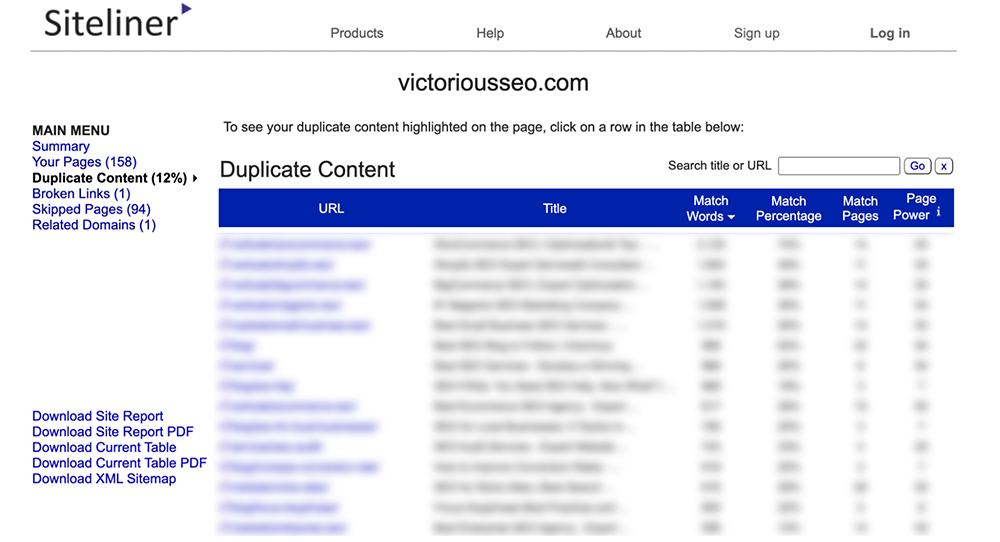

然后,Siteliner 将对网站进行扫描,并告诉您发现了多少重复内容,并突出显示它认为是您最关心的问题。 它还将显示更多指标,包括一些对 SEO 有用的指标,例如平均页面加载时间、内部和外部链接以及入站链接。

在主菜单下,单击“重复内容”以查看 Siteline 识别为具有重复内容的页面。

单击每一行以查看哪些文本被标记为重复。

注意: Siteline 会将出现在多个页面上的页眉和页脚识别为重复内容,因此您可能会看到许多匹配百分比较低的页面,因为它们各自共享相同的菜单或页脚内容。

如何检查其他人是否复制了您的内容

您还可以使用重复的内容搜索工具来检查网络上的其他人是否复制了您的内容。 Copyscape 是一个免费的网站内容检查工具,有效且易于使用。

只需在搜索框中插入一个 URL,然后单击它旁边的“开始”按钮。 Copyscape 然后将执行网络范围的搜索,以查看其他任何地方是否存在类似的文本内容。

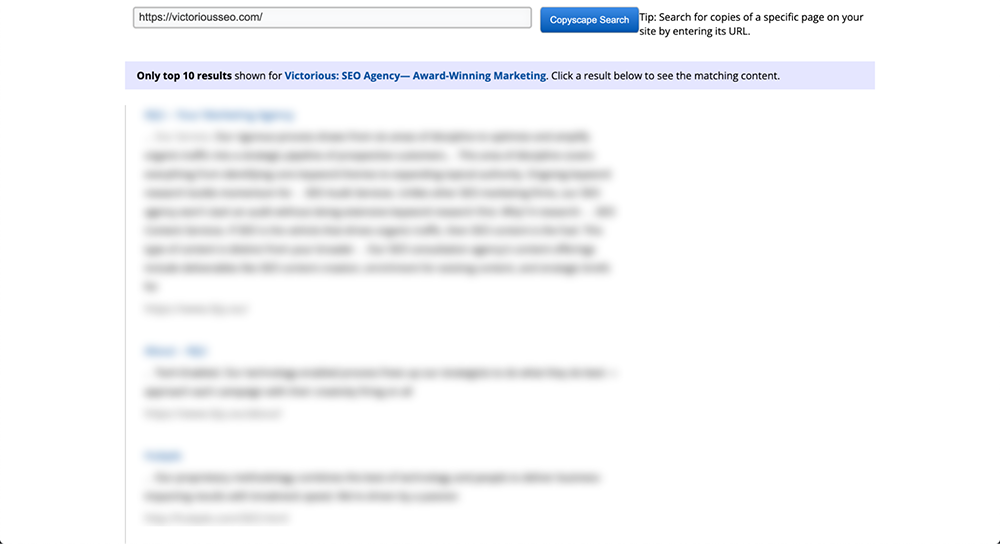

如果它找到任何东西,Copyscape 将返回结果并将它们组织在一个看起来有点像谷歌搜索结果的列表中。 这使您可以轻松地滚动浏览它们并查看您的内容有多少已被复制。 你可以把它想象成一个谷歌重复内容检查器。

如果您发现其他人抄袭了您的内容,您该怎么办?

首先,联系网站所有者并要求他们删除内容或为您网站上的原始内容添加规范链接。 如果这不起作用,请向 Google 提交 DMCA 删除请求。

注意:如果您有意联合您的内容并允许其他网站发布,它仍会显示为重复内容。 这就是为什么要求发布网站在页面上包含规范链接或 noindex 标记以防止其与您自己的页面在搜索引擎排名中竞争的原因。

如何修复重复内容

要解决重复内容问题,请确定您希望 Google 将哪个副本识别为原始版本。 您还需要决定是要完全删除重复页面,还是只是想告诉 Google 不要将它们编入索引。 根据您的决定,有几种不同的方法可以清理您的重复内容。

Noindex 与 Meta Robots 标签和 Robots.txt

将重复内容对您的 SEO 的影响降至最低的一种方法是通过修改元机器人标签来手动取消对任何重复页面的索引。 为此,请使用元机器人标签并将其值设置为“noindex,follow”。 将此标记应用于您希望从搜索结果中排除的每个页面的 HTML 标题。

元机器人标签允许搜索引擎抓取应用它的页面上的链接,但阻止搜索爬虫将它们包含在其索引中。

如果您不想将其编入索引,为什么还要让 Google 抓取该页面? 因为 Google 已明确警告不要限制对您网站上任何重复内容的抓取访问。 他们想知道它的存在,即使您不希望他们将其编入索引。

当应用于您的 HTML 代码时,noindex 标记应如下所示:

<head> [code] <meta name=”robots” content=”noindex, follow”> [如果需要其他代码] </head>

元机器人标签是一种简单有效的方法,可以对重复内容进行索引,并避免可能的 SEO 问题,因为您的网站上有明显相似或完全相同的重复页面。

如果您想要阻止 Google 和其他搜索引擎编制索引的整个目录,请编辑您的 robots.txt 文件。

301 重定向

处理重复内容问题的另一种方法是使用 301 重定向。 301 是永久重定向,将流量从重复页面转发到另一个 URL。 301 重定向对 SEO 友好,可帮助您将多个页面组合到一个 URL 中,从而巩固其链接资产。

当您使用 301 重定向时,重复页面或明显相似的页面将不再接受任何流量,因此请仅在您确定重复页面不再可访问时使用它,例如修剪内容时。 如果您仍然希望该页面可访问,请使用元机器人标签对其进行无索引。

相对规范

管理重复内容的另一种方法是使用 rel=canonical 属性来确定页面的优先级。 将 rel=canonical 属性放在 <head> HTML 标记内,以告诉搜索引擎特定页面作为另一个页面的副本存在,并且属于该页面的所有链接和排名能力实际上都应归因于规范页。

rel=canonical 标签在应用于 HTML 代码时看起来像这样:

<head> [code] <link href=”优先页面的 URL” rel=”canonical” /> </head>

您还可以使用自引用规范标签来指示您希望将特定页面视为原始版本。

从您的 XML 站点地图中删除 URL

您的 XML 站点地图应该只包含您想要编入索引的 URL。 如果您没有使用自动更新站点地图的动态 URL,则需要手动编辑站点地图并删除您未编入索引或重定向的所有 URL。

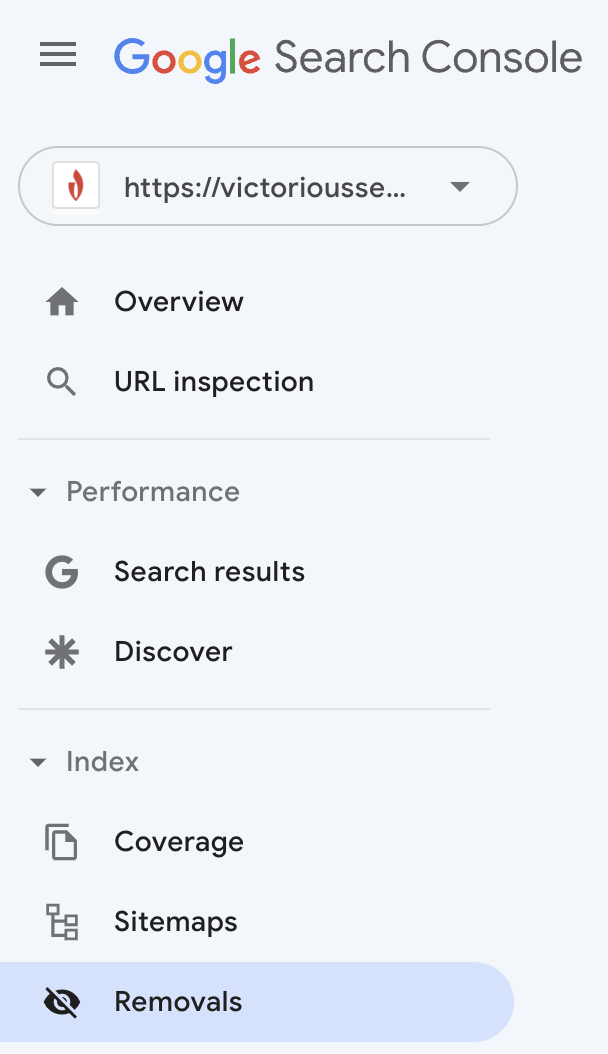

在 Google Search Console 中删除 URL

如果您选择重定向页面或限制索引,请请求 Google 从其索引中删除该 URL。

登录您的 Google Search Console 并从左侧菜单中选择“删除”。

将弹出一个框,让您知道提交 URL 将在六个月内从 Google 的索引中删除它。 在那之后,如果 Google 抓取您的网站并遇到该网址,它将被重新编制索引,除非它已被重定向或被机器人标记阻止。 如果您有多个共享前缀的 URL,您还可以提交前缀以暂时从 Google 索引中删除所有 URL。

六个月后,Google 将再次尝试抓取您的网址。 如果您已正确重定向或未将它们编入索引,它们将不再出现在搜索引擎结果页面 (SERP) 上。

需要帮助识别技术 SEO 问题吗?

希望提高您网站的排名能力? 与数据驱动的 SEO 机构合作,该机构将与您一起确定您网站上的技术 SEO 问题,并制定成功的 SEO 策略来帮助您爬升 SERP。 立即预订免费的 SEO 咨询,看看我们能为您做些什么!