Pesquisa interna do Facebook mostra que compartilhamentos podem aumentar significativamente a desinformação

Publicados: 2022-04-08E se o Facebook removesse completamente os compartilhamentos de postagens, como forma de limitar a disseminação de desinformação em seus aplicativos? Que impacto isso teria no engajamento e na interação do Facebook?

A questão surge após o lançamento de novos insights da pesquisa interna do Facebook, divulgada como parte do vazamento mais amplo de 'Arquivos do Facebook', que mostra que os próprios relatórios do Facebook descobriram que os compartilhamentos de postagens desempenham um papel fundamental na amplificação de informações erradas e na disseminação de danos entre o Facebook. comunidade.

Conforme relatado por Alex Kantrowitz em seu boletim informativo Big Technology:

“ O relatório observou que as pessoas são quatro vezes mais propensas a ver informações erradas quando encontram uma postagem por meio de um compartilhamento – como um retuíte de um retuíte – em comparação com uma foto ou link típico no Facebook. Adicione mais alguns compartilhamentos à cadeia e as pessoas terão cinco a dez vezes mais chances de ver informações erradas. Piora em alguns países. Na Índia, as pessoas que encontram “recompartilhamentos profundos”, como os pesquisadores os chamam, são vinte vezes mais propensas a ver desinformação.

Portanto, não são compartilhamentos diretos, mas compartilhamentos reamplificados, que são mais propensos a ser os tipos de relatórios controversos, divisivos, chocantes ou surpreendentes que ganham força viral no aplicativo. O conteúdo que gera resposta emocional vê mais atividade de compartilhamento a esse respeito, então faz sentido que quanto mais radical a afirmação, mais compartilhamentos ela provavelmente verá, principalmente porque os usuários procuram refutar ou reiterar sua posição pessoal sobre os problemas por meio de relatórios de terceiros.

E tem mais:

“O estudo descobriu que 38% de todas as [visualizações] de postagens de links com informações erradas ocorrem após dois novos compartilhamentos. Para fotos, os números aumentam - 65% das visualizações de desinformação de fotos ocorrem após dois novos compartilhamentos. Enquanto isso, as Páginas do Facebook não dependem de compartilhamentos profundos para distribuição. Cerca de 20% do conteúdo da página é visualizado em uma profundidade de compartilhamento de dois ou mais. ”

Então, novamente, os dados mostram que essas afirmações e postagens mais picantes e controversas têm tração viral significativa por meio do compartilhamento contínuo, à medida que os usuários amplificam e reamplificam essas postagens em toda a rede do Facebook, muitas vezes sem adicionar seus próprios pensamentos ou opiniões sobre isso.

E daí se o Facebook eliminasse completamente os compartilhamentos e forçasse as pessoas a criar suas próprias postagens para compartilhar conteúdo ou a comentar a postagem original, o que retardaria a rápida amplificação disso simplesmente tocando em um botão?

Curiosamente, o Facebook fez mudanças nessa frente, potencialmente vinculadas a esta pesquisa. No ano passado, o WhatsApp, de propriedade do Facebook (agora de propriedade da Meta), implementou novos limites no encaminhamento de mensagens para impedir a disseminação de desinformação por meio de cadeias de mensagens, com compartilhamento restrito a 5x por mensagem.

O que, diz o WhatsApp , tem sido eficaz:

“Desde a implantação do novo limite, globalmente, houve uma redução de 70% no número de mensagens altamente encaminhadas enviadas no WhatsApp. Essa mudança está ajudando a manter o WhatsApp como um local para conversas pessoais e privadas."

O que é um resultado positivo e mostra que há valor provável para esses limites. Mas a pesquisa recém-revelada analisou o Facebook especificamente e, até agora, o Facebook não fez nada para mudar o processo de compartilhamento em seu aplicativo principal, o foco principal de preocupação neste relatório.

A falta de ação da empresa nessa frente agora faz parte da pressão legal do denunciante do Facebook, Frances Haugen, contra a empresa, com o advogado de Haugen pedindo que o Facebook seja removido da App Store se não implementar limites para compartilhamentos.

O Facebook ainda não respondeu a essas novas alegações, mas é interessante observar essa pesquisa no contexto de outros experimentos do Facebook, que aparentemente apoiam e contradizem o foco central das alegações.

Em agosto de 2018, o Facebook realmente experimentou remover o botão Compartilhar das postagens, substituindo-o por um prompt de 'Mensagem'.

Isso parecia inspirado pelo aumento da discussão de conteúdo nos fluxos de mensagens, em oposição ao aplicativo do Facebook – mas, dado o momento do experimento, em relação ao estudo, parece que agora o Facebook estava procurando ver o impacto da remoção de compartilhamento poderia ter no engajamento no aplicativo.

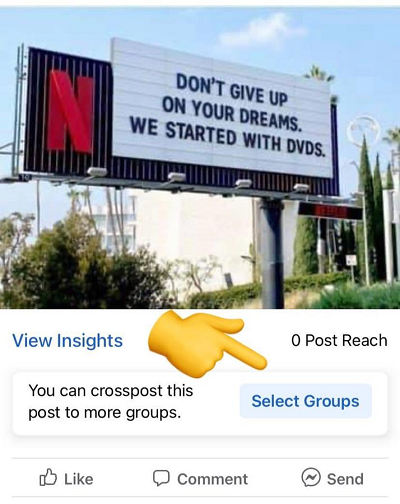

Em outra frente, no entanto, o compartilhamento expandido realmente testado do Facebook, com uma nova opção identificada nos testes que permite aos usuários compartilhar uma postagem em vários grupos do Facebook de uma só vez.

Isso aparentemente está focado no compartilhamento direto de postagens, em oposição aos compartilhamentos, que foram o foco de seu estudo de 2019. Mas, mesmo assim, fornecer mais maneiras de ampliar o conteúdo, postagens potencialmente perigosas ou prejudiciais, com mais facilidade, parece contrariar as descobertas descritas no relatório.

Novamente, não temos supervisão total, porque o Facebook não comentou os relatórios, mas parece que pode haver benefícios em remover totalmente os compartilhamentos de postagens como uma opção, como forma de limitar a rápida recirculação de reivindicações.

Mas, novamente, talvez isso prejudique muito o engajamento do Facebook – talvez, por meio desses vários experimentos, o Facebook tenha descoberto que as pessoas se envolveram menos e gastaram menos tempo no aplicativo, e é por isso que abandonou a ideia.

Esta é a questão central que Haugen levanta em sua crítica à plataforma, que o Facebook, pelo menos perceptualmente, hesita em agir sobre elementos que potencialmente causam danos se isso também significar que poderia prejudicar seus interesses comerciais.

O que, na escala e influência do Facebook, é uma consideração importante e sobre a qual precisamos de mais transparência.

O Facebook afirma que realiza essa pesquisa com a intenção distinta de melhorar seus sistemas, como explica o CEO Mark Zuckerberg:

“ Se quiséssemos ignorar a pesquisa, por que criaríamos um programa de pesquisa líder do setor para entender essas questões importantes em primeiro lugar? Se não nos importássemos em combater conteúdo nocivo, por que empregaríamos muito mais pessoas dedicadas a isso do que qualquer outra empresa em nosso espaço - mesmo aquelas maiores do que nós? Se quiséssemos ocultar nossos resultados, por que teríamos estabelecido um padrão líder do setor para transparência e relatórios sobre o que estamos fazendo?”

O que faz sentido, mas isso não explica se as considerações de negócios influenciam quaisquer decisões subsequentes como resultado, quando um nível de dano potencial é detectado por seus exames.

Esse é o cerne da questão. A influência do Facebook é clara, sua importância como canal de conexão e distribuição de informações é evidente. Mas o que influencia suas decisões em relação ao que agir e o que deixar, ao avaliar essas preocupações?

Há evidências que sugerem que o Facebook evitou pressionar demais, mesmo quando seus próprios dados destacam problemas, como aparentemente mostrado neste caso. E embora o Facebook deva ter o direito de responder e seu dia no tribunal para responder às acusações de Haugen, é nisso que realmente precisamos de respostas, principalmente porque a empresa procura criar ferramentas de conexão ainda mais imersivas e abrangentes para o futuro .