Une régulation efficace peut-elle réduire l'impact des contenus qui divisent sur les réseaux sociaux ?

Publié: 2022-04-08Au milieu d'une nouvelle tempête de controverse suscitée par The Facebook Files, un exposé de divers projets de recherche internes qui, à certains égards, suggèrent que Facebook n'en fait pas assez pour protéger les utilisateurs contre les dommages, la question centrale qui doit être abordée est souvent d'être déformé par les préjugés inhérents et le ciblage spécifique de Facebook, l'entreprise, par opposition aux médias sociaux, et l'amplification algorithmique du contenu en tant que concept.

C'est-à-dire, que fait-on pour y remédier ? Qu'est-ce qui peut être fait, de manière réaliste, qui fera réellement une différence ; Quels changements de réglementation ou de politique pourraient être mis en œuvre pour réduire l'amplification des publications nuisibles et conflictuelles qui alimentent davantage l'angoisse au sein de la société en raison de l'influence croissante des applications de médias sociaux ?

Il est important de considérer les médias sociaux plus largement ici, car chaque plate-forme sociale utilise des algorithmes pour définir la distribution et la portée du contenu. Facebook est de loin le plus grand et a plus d'influence sur les éléments clés, comme le contenu des nouvelles - et bien sûr, les informations de recherche elles-mêmes, dans ce cas, provenaient de Facebook.

L'accent mis sur Facebook, en particulier, a du sens, mais Twitter amplifie également le contenu qui suscite plus d'engagement, LinkedIn trie son flux en fonction de ce qu'il détermine comme étant le plus engageant. L'algorithme de TikTok est très adapté à vos intérêts.

Le problème, comme l'a souligné Frances Haugen, dénonciatrice de Facebook, est la distribution algorithmique, pas Facebook lui-même. Quelles idées avons-nous donc qui peuvent améliorer cet élément de manière réaliste ?

Et la question supplémentaire est de savoir si les plateformes sociales seront disposées à apporter de tels changements, surtout si elles présentent un risque pour leur engagement et les niveaux d'activité des utilisateurs ?

Haugen, qui est un expert en correspondance de contenu algorithmique, a proposé que les réseaux sociaux soient contraints de cesser complètement d'utiliser des algorithmes basés sur l'engagement, via des réformes des lois de l'article 230, qui protègent actuellement les sociétés de médias sociaux de toute responsabilité légale pour ce que les utilisateurs partagent dans leurs applications. .

Comme l'explique Haugen :

"Si nous avions une surveillance appropriée, ou si nous réformions [l'article] 230 pour rendre Facebook responsable des conséquences de leurs décisions de classement intentionnelles, je pense qu'ils se débarrasseraient du classement basé sur l'engagement."

Le concept ici est que Facebook – et par extension, toutes les plateformes sociales – seraient tenus responsables de la manière dont ils amplifient certains contenus. Donc, si davantage de personnes finissent par voir, par exemple, des informations erronées sur le COVID en raison d'une intervention algorithmique, Facebook pourrait être tenu légalement responsable de tout impact.

Cela ajouterait un risque important à toute prise de décision concernant la construction de tels algorithmes, et comme le note Haugen, cela pourrait alors voir les plates-formes obligées de prendre du recul par rapport aux mesures qui augmentent la portée des publications en fonction de la façon dont les utilisateurs interagissent avec un tel contenu .

Essentiellement, cela obligerait probablement les plateformes sociales à revenir à l'époque pré-algorithme, lorsque Facebook et d'autres applications vous montreraient simplement une liste du contenu des pages et des personnes que vous suivez dans l'ordre chronologique, en fonction de l'heure de publication. Cela, à son tour, réduirait alors la motivation des personnes et des marques à partager des contenus plus controversés et propices à l'engagement afin de jouer dans les caprices de l'algorithme.

L'idée a un certain mérite - comme diverses études l'ont montré, susciter une réponse émotionnelle avec vos messages sociaux est essentiel pour maximiser l'engagement, et donc, atteindre en fonction de l'amplification de l'algorithme, et les émotions les plus efficaces, à cet égard, sont l'humour et la colère. Les blagues et les vidéos amusantes fonctionnent toujours bien sur toutes les plateformes, alimentées par la portée de l'algorithme, mais il en va de même pour les prises à chaud induisant la colère, avec lesquelles les médias partisans et les personnalités ont couru, ce qui pourrait bien être une source clé de la division et de l'angoisse que nous avons maintenant. voir en ligne.

Pour être clair, Facebook ne peut pas être tenu pour seul responsable de tels. Les éditeurs partisans et les personnalités controversées jouent depuis longtemps un rôle dans un discours plus large, et ils suscitaient l'attention et l'engagement avec leurs opinions de centre gauche bien avant l'arrivée de Facebook. La différence est maintenant que les réseaux sociaux facilitent une telle portée, alors qu'ils fournissent également, par le biais de Likes et d'autres formes d'engagement, une incitation directe à cela, les utilisateurs individuels recevant un coup de dopamine en déclenchant une réponse, et les éditeurs générant plus de trafic de référence et gagnant plus d'exposition par la provocation.

Vraiment, un problème clé lorsque l'on considère l'ancien résultat est que tout le monde a maintenant une voix, et lorsque tout le monde a une plate-forme pour partager ses pensées et ses opinions, nous sommes tous beaucoup plus exposés à cela et beaucoup plus conscients. Dans le passé, vous n'aviez probablement aucune idée des convictions politiques de votre oncle, mais maintenant vous le savez, car les médias sociaux vous le rappellent tous les jours, et ce type de partage entre pairs joue également un rôle dans une division plus large.

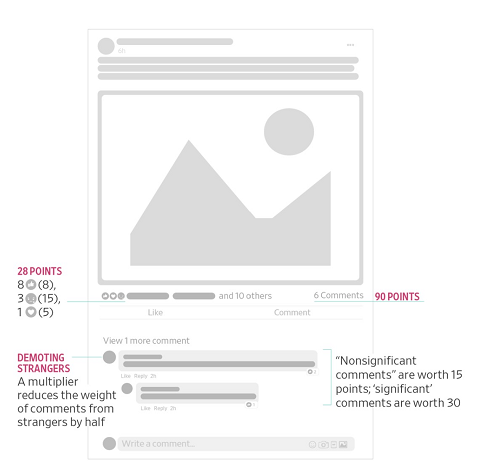

L'argument de Haugen, cependant, est que Facebook encourage cela - par exemple, l'un des rapports que Haugen a divulgués au Wall Street Journal décrit comment Facebook a mis à jour son algorithme de fil d'actualité en 2018 pour mettre davantage l'accent sur l'engagement entre les utilisateurs et réduire les discussions politiques, ce qui était devenu un élément de plus en plus controversé dans l'application. Facebook l'a fait en modifiant sa pondération pour différents types d'engagement avec les publications.

L'idée était que cela inciterait plus de discussions, en pondérant plus fortement les réponses - mais comme vous pouvez l'imaginer, en accordant plus de valeur aux commentaires, afin d'augmenter la portée, cela a également incité plus d'éditeurs et de pages à partager de plus en plus de division, émotionnellement - messages chargés, afin d'inciter plus de réactions, et d'obtenir des scores de partage plus élevés en conséquence. Avec cette mise à jour, les Likes n'étaient plus le principal moteur de portée, comme ils l'avaient été, Facebook rendant les commentaires et les réactions (y compris "Angry") de plus en plus importants. En tant que tel, susciter des discussions sur les tendances politiques est devenu plus important et a exposé davantage d'utilisateurs à ce contenu dans leurs flux.

La suggestion alors, basée sur ces données internes, est que Facebook le savait, il savait que ce changement avait intensifié le contenu qui divise. Mais ils ont choisi de ne pas revenir en arrière ou de mettre en œuvre une autre mise à jour, car l'engagement, une mesure clé de son succès commercial, avait en effet augmenté en conséquence.

En ce sens, supprimer la motivation de l'algorithme aurait du sens - ou peut-être pourriez-vous chercher à supprimer les incitations à l'algorithme pour certains types de publications, comme les discussions politiques, tout en maximisant la portée de publications plus engageantes d'amis, répondant à la fois aux objectifs d'engagement et à la division. préoccupations.

C'est ce que Dave Gillis de Facebook, qui travaille dans l'équipe de sécurité des produits de la plateforme, a souligné dans un fil de tweet, en réponse aux révélations.

Selon Gillis :

" À la fin de l'article du WSJ sur le classement algorithmique des flux, il est mentionné - presque en passant - que nous nous sommes éloignés du classement basé sur l'engagement pour le contenu civique et de santé dans le fil d'actualité. Mais attendez - c'est un gros problème, non ? Il est probablement raisonnable de classer, par exemple, les vidéos de chats et les photos de bébés par goût, etc., mais traitez les autres types de contenu avec plus de soin. Et c'est, en fait, ce que nos équipes ont préconisé de faire : utiliser différents signaux de classement pour les contenus de santé et civiques, en privilégiant la qualité + la fiabilité à l'engagement. Nous avons travaillé dur pour comprendre l'impact, obtenir le leadership à bord - oui, Mark aussi - et c'est un changement important. ”

Cela pourrait être une voie à suivre, en utilisant différents signaux de classement pour différents types de contenu, ce qui peut permettre une amplification optimale du contenu, stimuler l'engagement bénéfique des utilisateurs, tout en réduisant la motivation de certains acteurs à publier du matériel qui divise afin d'alimenter l'algorithme. atteindre.

Est-ce que ça marcherait ? Encore une fois, c'est difficile à dire, parce que les gens pourraient toujours partager des publications, ils pourraient toujours commenter et redistribuer du matériel en ligne, il existe encore de nombreuses façons dont l'amplification peut se produire en dehors de l'algorithme lui-même.

Essentiellement, il y a des mérites aux deux suggestions, que les plateformes sociales pourraient traiter différents types de contenu différemment, ou que les algorithmes pourraient être éliminés pour réduire l'amplification de ce matériel.

Et comme le note Haugen, il est important de se concentrer sur les systèmes eux-mêmes, car les solutions basées sur le contenu ouvrent diverses complexités lorsque le matériel est publié dans d'autres langues et régions.

« Dans le cas de l'Éthiopie, il y a 100 millions d'habitants et six langues. Facebook ne prend en charge que deux de ces langues pour les systèmes d'intégrité. Cette stratégie consistant à se concentrer sur des systèmes spécifiques à la langue et au contenu pour que l'IA nous sauve est vouée à l'échec.

Peut-être, alors, supprimer les algorithmes, ou au moins modifier les réglementations sur le fonctionnement des algorithmes, serait une solution optimale, ce qui pourrait aider à réduire les impacts du contenu négatif et induisant la rage dans la sphère des médias sociaux.

Mais nous revenons ensuite au problème initial que l'algorithme de Facebook a été conçu pour résoudre - en 2015, Facebook a expliqué qu'il avait besoin de l'algorithme du fil d'actualité non seulement pour maximiser l'engagement des utilisateurs, mais aussi pour s'assurer que les gens voient toutes les mises à jour de la plupart pertinence pour eux.

Comme il l'a expliqué, l'utilisateur moyen de Facebook, à cette époque, avait environ 1 500 publications éligibles pour apparaître dans son fil d'actualités un jour donné, en fonction des pages qu'il avait aimées et de ses connexions personnelles - tandis que pour certains utilisateurs plus actifs , ce nombre ressemblait plus à 15 000. Il n'est tout simplement pas possible pour les gens de lire chacune de ces mises à jour chaque jour, donc l'objectif principal de Facebook avec l'algorithme initial était de créer un système qui découvrait le contenu le meilleur et le plus pertinent pour chaque individu, afin de fournir aux utilisateurs le plus expérience engageante, et par la suite les faire revenir.

Comme Chris Cox, directeur des produits de Facebook, l'a expliqué à Time Magazine :

"Si vous pouviez évaluer tout ce qui s'est passé sur Terre aujourd'hui et qui a été publié n'importe où par l'un de vos amis, n'importe quel membre de votre famille, n'importe quelle source d'information, puis choisir les 10 qui sont les plus significatifs à connaître aujourd'hui, ce serait vraiment cool. service pour nous de construire. C'est vraiment ce que nous aspirons à faire devenir News Feed."

L'approche du fil d'actualité a beaucoup évolué depuis lors, mais le défi fondamental qu'il a été conçu pour résoudre demeure. Les gens ont trop de connexions, ils suivent trop de pages, ils sont membres de trop de groupes pour recevoir toutes leurs mises à jour, tous les jours. Sans l'algorithme de flux, ils manqueront des messages pertinents, des mises à jour pertinentes comme les annonces de famille et les anniversaires, et ils ne seront tout simplement pas aussi engagés dans l'expérience Facebook.

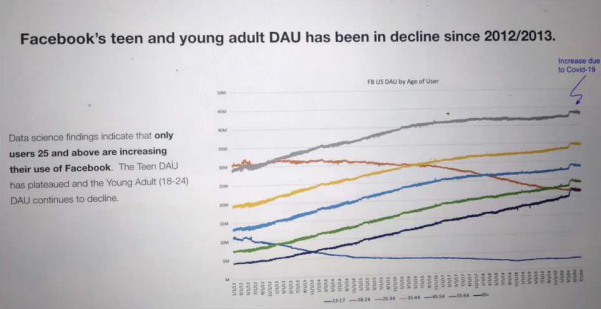

Sans l'algorithme, Facebook sera perdant, en ne parvenant pas à optimiser les désirs du public - et comme le souligne un autre des rapports partagés dans le cadre des fichiers Facebook, il constate déjà une baisse de l'engagement dans certains sous-ensembles démographiques.

Vous pouvez imaginer que si Facebook devait éliminer l'algorithme, ou être obligé de changer de direction à ce sujet, ce graphique ne ferait qu'empirer avec le temps.

Il est donc peu probable que Zuck et Cie soient favorables à cette solution, donc un compromis, comme celui proposé par Gillis, peut être le meilleur que l'on puisse attendre. Mais cela vient avec ses propres défauts et risques.

Quoi qu'il en soit, il convient de noter que le débat doit se concentrer sur les algorithmes plus largement, pas seulement sur Facebook seul, et s'il existe réellement un moyen viable et réalisable de modifier les incitations autour des systèmes basés sur des algorithmes pour limiter la distribution. d'éléments plus diviseurs.

Parce que c'est un problème, peu importe comment Facebook ou quelqu'un d'autre essaie de le faire tourner, c'est pourquoi la position de Haugen est importante, car elle pourrait bien être l'étincelle qui nous mène à un nouveau débat plus nuancé autour de cet élément clé.