Может ли эффективное регулирование уменьшить влияние разделяющего контента на социальные сети?

Опубликовано: 2022-04-08На фоне новой бури споров, вызванной The Facebook Files, разоблачением различных внутренних исследовательских проектов, которые в некотором роде предполагают, что Facebook недостаточно делает для защиты пользователей от вреда, основной вопрос, который необходимо решить, часто заключается в следующем. искажено врожденной предвзятостью и конкретным таргетингом на Facebook, компанию, а не на социальные сети, и алгоритмическим усилением контента как концепцией.

То есть, что мы делаем, чтобы это исправить? Что реально можно сделать, что реально изменит ситуацию; Какие изменения в регулировании или политике можно реально внести, чтобы уменьшить количество вредных, вызывающих разногласия сообщений, которые вызывают больше беспокойства в обществе в результате растущего влияния приложений социальных сетей?

Здесь важно рассматривать социальные сети более широко, потому что каждая социальная платформа использует алгоритмы для определения распространения и охвата контента. Facebook, безусловно, является крупнейшим и имеет большее влияние на ключевые элементы, такие как новостной контент, и, конечно же, сами результаты исследований в этом случае были получены из Facebook.

Фокус на Facebook, в частности, имеет смысл, но Twitter также расширяет контент, который вызывает большее вовлечение, LinkedIn сортирует свою ленту на основе того, что, по его мнению, будет наиболее привлекательным. Алгоритм TikTok точно соответствует вашим интересам.

Проблема, как подчеркнула разоблачитель Facebook Фрэнсис Хауген, заключается в алгоритмическом распространении, а не в самом Facebook. Итак, какие у нас есть идеи, которые могут реально улучшить этот элемент?

И тогда возникает следующий вопрос: захотят ли социальные платформы вносить такие изменения, особенно если они представляют риск для уровня их вовлеченности и активности пользователей?

Хауген, являющийся экспертом в области алгоритмического сопоставления контента, предложил заставить социальные сети вообще отказаться от использования алгоритмов, основанных на взаимодействии, путем реформирования 230-й статьи законов, которые в настоящее время защищают компании социальных сетей от юридической ответственности за то, чем пользователи делятся в своих приложениях. .

Как объяснил Хауген:

«Если бы у нас был соответствующий надзор или если бы мы реформировали [Раздел] 230, чтобы возложить на Facebook ответственность за последствия их преднамеренных решений о ранжировании, я думаю, они бы избавились от рейтинга, основанного на вовлеченности».

Идея здесь заключается в том, что Facebook — и, соответственно, все социальные платформы — будут нести ответственность за то, как они распространяют определенный контент. Поэтому, если больше людей в конечном итоге увидят, скажем, дезинформацию о COVID из-за алгоритмического вмешательства, Facebook может быть привлечен к юридической ответственности за любые последствия.

Это добавит значительный риск любому принятию решений, связанных с созданием таких алгоритмов, и, как отмечает Хауген, может привести к тому, что платформы будут вынуждены сделать шаг назад от мер, которые увеличивают охват постов в зависимости от того, как пользователи взаимодействуют с таким контентом. .

По сути, это, вероятно, приведет к тому, что социальные платформы будут вынуждены вернуться к доалгоритмическим дням, когда Facebook и другие приложения просто показывали бы вам список контента со страниц и людей, на которых вы подписаны, в хронологическом порядке, в зависимости от времени публикации. Это, в свою очередь, уменьшит мотивацию людей и брендов делиться более спорным, вызывающим интерес контентом, чтобы играть на капризах алгоритма.

У этой идеи есть некоторые достоинства — как показали различные исследования, вызывание эмоционального отклика на ваши посты в социальных сетях является ключом к максимальному вовлечению и, следовательно, охвату на основе усиления алгоритма, а наиболее эффективными эмоциями в этом отношении являются юмор и гнев. Шутки и забавные видеоролики по-прежнему популярны на всех платформах благодаря охвату алгоритма, но то же самое можно сказать и о вызывающих гнев горячих кадрах, с которыми бегают пристрастные новостные агентства и личности, что вполне может быть ключевым источником разделения и беспокойства, которые мы сейчас смотрите онлайн.

Чтобы было ясно, Facebook не может нести за это единоличную ответственность. Партийные издатели и неоднозначные фигуры уже давно играют роль в более широком дискурсе, и они привлекали внимание и привлекали внимание своими левоцентристскими мнениями задолго до того, как появился Facebook. Разница сейчас в том, что социальные сети способствуют такому широкому охвату, в то же время они также, посредством лайков и других форм взаимодействия, обеспечивают прямой стимул для этого, при этом отдельные пользователи получают выброс дофамина, вызывая отклик, а издатели направляют больше реферального трафика и получают больше разоблачения через провокацию.

На самом деле, ключевой вопрос при рассмотрении первого результата заключается в том, что каждый теперь имеет право голоса, и когда у каждого есть платформа, чтобы поделиться своими мыслями и мнениями, мы все гораздо более подвержены этому и гораздо более осведомлены. В прошлом вы, вероятно, не знали о политических убеждениях вашего дяди, но теперь вы знаете, потому что социальные сети напоминают вам каждый день, и такой тип обмена мнениями также играет роль в более широком разделении.

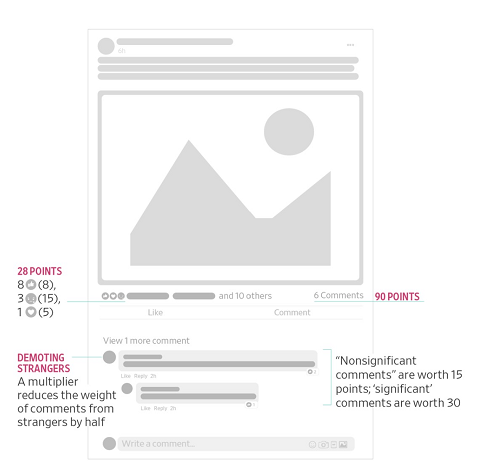

Аргумент Хаугена, однако, заключается в том, что Facebook стимулирует это — например, в одном из отчетов, которые Хауген просочился в Wall Street Journal, рассказывается, как Facebook обновил свой алгоритм новостной ленты в 2018 году, чтобы сделать больший упор на взаимодействие между пользователями и уменьшить политические дискуссии, которые становился все более спорным элементом в приложении. Facebook сделал это, изменив свой вес для разных типов взаимодействия с публикациями.

Идея заключалась в том, что это побудит к большему обсуждению, более взвешивая ответы, но, как вы можете себе представить, придавая больше значения комментариям, чтобы увеличить охват, это также побудило больше издателей и страниц делиться все более противоречивыми, эмоционально- заряженные посты, чтобы спровоцировать больше реакций и в результате получить более высокие баллы по репостам. С этим обновлением лайки больше не были ключевым фактором охвата, как раньше, а Facebook делал комментарии и реакции (включая «сердитые») все более важными. Таким образом, разжигание дискуссий о политических тенденциях стало более заметным и привлекло больше пользователей к такому контенту в их лентах.

Таким образом, предположение, основанное на этих внутренних данных, состоит в том, что Facebook знал об этом, он знал, что это изменение усилило разногласия в контенте. Но они решили не возвращаться назад или внедрять еще одно обновление, потому что в результате вовлеченность, ключевой показатель их успеха в бизнесе, действительно увеличилась.

В этом смысле удаление мотивации алгоритма имело бы смысл — или, может быть, вы могли бы попытаться удалить алгоритмические стимулы для определенных типов сообщений, таких как политическая дискуссия, в то же время максимизируя охват более привлекательных сообщений от друзей, удовлетворяя как цели вовлечения, так и разногласия. обеспокоенность.

Это то, на что Дэйв Гиллис из Facebook, который работает в группе безопасности продуктов платформы, указал в ветке твита в ответ на разоблачения.

Согласно Гиллису:

« В конце статьи WSJ об алгоритмическом ранжировании фидов почти мимоходом упоминается, что мы отказались от ранжирования на основе вовлеченности гражданского и медицинского контента в новостной ленте. Но подождите - это что-то большое, не так ли? Вероятно, разумно ранжировать, скажем, видео с кошками и детские фотографии по лайкам и т. д., но относиться к другим видам контента следует с большей осторожностью. И это, по сути, то, за что выступали наши команды: использовать разные сигналы ранжирования для здоровья и гражданского контента, отдавая предпочтение качеству + надежности, а не вовлеченности. Мы усердно работали, чтобы понять влияние, привлечь к себе руководство — да, Марк тоже — и это важное изменение. ”

Это может быть шагом вперед, используя разные сигналы ранжирования для разных типов контента, которые могут работать для обеспечения оптимального распространения контента, повышения полезного взаимодействия с пользователями, а также снижения мотивации для определенных участников публиковать материалы, вызывающие разногласия, чтобы использовать их в алгоритмическом анализе. достигать.

Будет ли это работать? Опять же, трудно сказать, потому что люди по-прежнему смогут делиться сообщениями, они по-прежнему смогут комментировать и повторно распространять материалы в Интернете, есть еще много способов, которыми усиление может происходить вне самого алгоритма.

По сути, у обоих предложений есть свои достоинства: социальные платформы могут по-разному обрабатывать разные типы контента или что алгоритмы могут быть устранены, чтобы уменьшить распространение такого материала.

И, как отмечает Хауген, важно сосредоточиться на самих системах, потому что решения на основе контента открывают различные сложности, когда материал размещается на других языках и в других регионах.

«В случае с Эфиопией 100 миллионов человек и шесть языков. Facebook поддерживает только два из этих языков для систем целостности. Эта стратегия сосредоточения внимания на системах, специфичных для языка и контента, для ИИ, чтобы спасти нас, обречена на провал».

Возможно, тогда удаление алгоритмов или, по крайней мере, изменение правил работы алгоритмов было бы оптимальным решением, которое могло бы помочь уменьшить влияние негативного, вызывающего гнев контента в сфере социальных сетей.

Но затем мы возвращаемся к исходной проблеме, для решения которой был разработан алгоритм Facebook: еще в 2015 году Facebook объяснил, что ему нужен алгоритм новостной ленты не только для максимального вовлечения пользователей, но и для обеспечения того, чтобы люди видели все обновления большинства актуальность для них.

Как поясняется, средний пользователь Facebook в то время имел около 1500 сообщений, которые могли появиться в его новостной ленте в любой день, в зависимости от понравившихся страниц и их личных связей, в то время как для некоторых более активных пользователей , это число было больше похоже на 15 000. Люди просто не могут читать каждое из этих обновлений каждый день, поэтому ключевой задачей Facebook с первоначальным алгоритмом было создание системы, которая выявляла бы лучший, наиболее релевантный контент для каждого человека, чтобы предоставить пользователям наиболее захватывающий опыт, а впоследствии заставлять их возвращаться.

Как пояснил директор по продуктам Facebook Крис Кокс журналу Time:

«Если бы вы могли оценить все, что произошло на Земле сегодня, что было опубликовано кем-либо из ваших друзей, любого члена вашей семьи, любого источника новостей, а затем выбрать 10 наиболее значимых для сегодняшнего дня событий, это было бы действительно круто. сервис для нас, чтобы построить. Это действительно то, что мы стремимся сделать новостной лентой ".

С тех пор подход новостной ленты сильно изменился, но фундаментальная проблема, для решения которой он был разработан, осталась. У людей слишком много связей, они подписаны на слишком много страниц, они являются членами слишком многих групп, чтобы получать все свои обновления каждый день. Без алгоритма подачи они будут пропускать релевантные посты, актуальные обновления, такие как семейные объявления и дни рождения, и просто не будут так активно пользоваться Facebook.

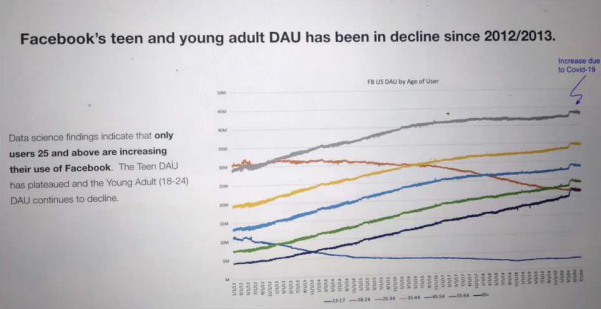

Без алгоритма Facebook проиграет из-за того, что не сможет оптимизировать запросы аудитории — и, как подчеркивается в другом отчете, опубликованном как часть файлов Facebook, на самом деле уже наблюдается снижение вовлеченности в некоторых демографических подмножествах.

Вы можете себе представить, что если Facebook устранит алгоритм или будет вынужден изменить свое направление в этом, то этот график со временем будет только ухудшаться.

Таким образом, Цуку и Ко вряд ли понравится такое решение, поэтому компромисс, подобный предложенному Гиллисом, может быть лучшим, на что можно рассчитывать. Но это сопряжено со своими недостатками и рисками.

В любом случае, стоит отметить, что фокус дебатов должен быть смещен на алгоритмы в более широком смысле, а не только на Facebook, и на то, существует ли на самом деле жизнеспособный, работающий способ изменить стимулы вокруг систем, основанных на алгоритмах, чтобы ограничить распространение. более разобщающих элементов.

Потому что это проблема, независимо от того, как Facebook или кто-либо еще пытается ее раскрутить, поэтому позиция Хаугена важна, поскольку она вполне может стать искрой, которая приведет нас к новым, более тонким дебатам вокруг этого ключевого элемента.