Kann eine wirksame Regulierung die Auswirkungen von spaltenden Inhalten auf soziale Netzwerke verringern?

Veröffentlicht: 2022-04-08Inmitten eines neuen Kontroversensturms, der von The Facebook Files ausgelöst wurde, einer Enthüllung verschiedener interner Forschungsprojekte, die in gewisser Weise darauf hindeuten, dass Facebook nicht genug tut, um Benutzer vor Schaden zu schützen, lautet die Kernfrage, die häufig angegangen werden muss verzerrt durch inhärente Voreingenommenheit und spezifisches Targeting von Facebook, dem Unternehmen, im Gegensatz zu sozialen Medien, und algorithmischer Inhaltsverstärkung als Konzept.

Das heißt, was tun wir, um es zu beheben? Was realistischerweise getan werden kann, wird tatsächlich einen Unterschied machen; Welche Änderungen an Vorschriften oder Richtlinien könnten machbar umgesetzt werden, um die Verstärkung schädlicher, spaltender Posts zu verringern, die aufgrund des zunehmenden Einflusses von Social-Media-Apps mehr Angst in der Gesellschaft schüren?

Hier ist es wichtig, Social Media breiter zu betrachten, denn jede soziale Plattform verwendet Algorithmen, um die Verbreitung und Reichweite von Inhalten zu definieren. Facebook ist bei weitem das größte und hat mehr Einfluss auf Schlüsselelemente wie Nachrichteninhalte – und natürlich stammen die Forschungserkenntnisse selbst in diesem Fall von Facebook.

Der Fokus auf Facebook ist insbesondere sinnvoll, aber Twitter verstärkt auch Inhalte, die mehr Engagement auslösen, LinkedIn sortiert seinen Feed danach, was seiner Meinung nach am ansprechendsten ist. Der Algorithmus von TikTok ist stark auf Ihre Interessen abgestimmt.

Wie von Facebook-Whistleblowerin Frances Haugen hervorgehoben, ist das Problem die algorithmische Verbreitung, nicht Facebook selbst – also welche Ideen haben wir, um dieses Element realistisch zu verbessern?

Und die weitere Frage ist dann, werden soziale Plattformen bereit sein, solche Änderungen vorzunehmen, insbesondere wenn sie ein Risiko für ihr Engagement und ihre Benutzeraktivität darstellen?

Haugen, ein Experte für algorithmischen Content-Matching, hat vorgeschlagen, dass soziale Netzwerke gezwungen werden sollten, die Verwendung von engagementbasierten Algorithmen ganz einzustellen, und zwar durch Reformen der § 230-Gesetze, die Social-Media-Unternehmen derzeit vor der rechtlichen Haftung für das schützen, was Benutzer in ihren Apps teilen .

Wie von Haugen erklärt:

„Wenn wir eine angemessene Aufsicht hätten oder wenn wir [Section] 230 reformieren würden, um Facebook für die Folgen ihrer absichtlichen Ranking-Entscheidungen verantwortlich zu machen, würden sie meiner Meinung nach das engagementbasierte Ranking abschaffen.“

Das Konzept hier ist, dass Facebook – und damit alle sozialen Plattformen – für die Art und Weise, in der sie bestimmte Inhalte verstärken, zur Rechenschaft gezogen wird. Wenn also mehr Menschen aufgrund algorithmischer Eingriffe beispielsweise COVID-Fehlinformationen sehen, könnte Facebook für etwaige Auswirkungen rechtlich haftbar gemacht werden.

Dies würde jede Entscheidungsfindung rund um die Konstruktion solcher Algorithmen erheblich gefährden, und wie Haugen anmerkt, könnten die Plattformen dann gezwungen sein, einen Schritt zurückzutreten von Maßnahmen, die die Reichweite von Beiträgen auf der Grundlage der Interaktion der Benutzer mit solchen Inhalten erhöhen .

Im Wesentlichen würde dies wahrscheinlich dazu führen, dass soziale Plattformen zu Zeiten vor dem Algorithmus zurückkehren müssten, als Facebook und andere Apps Ihnen einfach eine Auflistung der Inhalte der Seiten und Personen, denen Sie folgen, in chronologischer Reihenfolge basierend auf der Veröffentlichungszeit zeigen würden. Das wiederum würde dann die Motivation für Menschen und Marken verringern, kontroversere Inhalte zu teilen, die das Engagement fördern, um den Launen des Algorithmus freien Lauf zu lassen.

Die Idee hat einige Vorteile – wie verschiedene Studien gezeigt haben, ist das Auslösen einer emotionalen Reaktion mit Ihren sozialen Beiträgen der Schlüssel zur Maximierung des Engagements und damit der Reichweite basierend auf der Algorithmusverstärkung, und die effektivsten Emotionen in dieser Hinsicht sind Humor und Wut. Witze und lustige Videos laufen immer noch gut auf allen Plattformen, angeheizt durch die Reichweite von Algorithmen, aber auch wütend machende Hot Takes, mit denen parteiische Nachrichtenagenturen und Persönlichkeiten gelaufen sind, die durchaus eine Hauptquelle der Spaltung und Angst sein könnten, die wir jetzt haben im Internet sehen.

Um es klarzustellen, Facebook kann nicht allein dafür verantwortlich gemacht werden. Partisanenverleger und umstrittene Persönlichkeiten spielen seit langem eine Rolle im breiteren Diskurs, und sie haben mit ihren linksgerichteten Meinungen Aufmerksamkeit und Engagement erregt, lange bevor es Facebook gab. Der Unterschied besteht jetzt darin, dass soziale Netzwerke eine so große Reichweite ermöglichen, während sie durch Likes und andere Formen des Engagements auch einen direkten Anreiz dafür bieten, wobei einzelne Benutzer einen Dopamin-Hit erhalten, indem sie eine Reaktion auslösen, und Publisher mehr Empfehlungsverkehr generieren und gewinnen mehr Aufmerksamkeit durch Provokation.

Wirklich, ein Schlüsselproblem bei der Betrachtung des früheren Ergebnisses ist, dass jetzt jeder eine Stimme hat, und wenn jeder eine Plattform hat, um seine Gedanken und Meinungen zu teilen, sind wir alle diesen viel stärker ausgesetzt und viel bewusster. In der Vergangenheit hatten Sie wahrscheinlich keine Ahnung von den politischen Überzeugungen Ihres Onkels, aber jetzt wissen Sie es, weil die sozialen Medien Sie jeden Tag daran erinnern, und diese Art von Peer-Sharing spielt auch eine Rolle in der breiteren Spaltung.

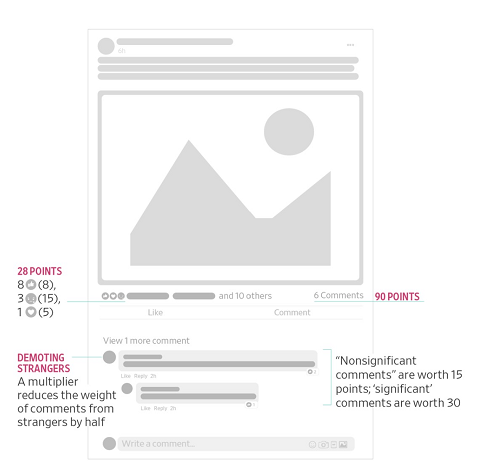

Haugens Argument ist jedoch, dass Facebook dies anregt – zum Beispiel skizziert einer der Berichte, die Haugen an das Wall Street Journal zugespielt hat, wie Facebook seinen Newsfeed-Algorithmus im Jahr 2018 aktualisiert hat, um mehr Wert auf die Interaktion zwischen den Nutzern zu legen und politische Diskussionen zu reduzieren, was war zu einem zunehmend spaltenden Element in der App geworden. Facebook tat dies, indem es seine Gewichtung für verschiedene Arten der Interaktion mit Beiträgen änderte.

Die Idee war, dass dies mehr Diskussionen anregen würde, indem die Antworten stärker gewichtet würden – aber wie Sie sich vorstellen können, veranlasste das mehr Wert auf Kommentare, um mehr Reichweite zu erzielen, auch mehr Publisher und Seiten dazu, zunehmend spaltende, emotionale Inhalte zu teilen. kostenpflichtige Posts, um mehr Reaktionen hervorzurufen und dadurch höhere Share-Scores zu erzielen. Mit diesem Update waren Likes nicht mehr der wichtigste Reichweitentreiber, da Facebook Kommentare und Reaktionen (einschließlich „Wütend“) immer wichtiger machte. Als solches wurde das Entfachen von Diskussionen über politische Trends tatsächlich wichtiger und brachte mehr Benutzer mit solchen Inhalten in ihren Feeds in Berührung.

Der Vorschlag, basierend auf diesen internen Daten, ist dann, dass Facebook dies wusste, es wusste, dass diese Änderung spaltende Inhalte verstärkt hatte. Aber sie entschieden sich dafür, nicht zurückzugehen oder ein weiteres Update zu implementieren, da das Engagement, ein Schlüsselmaß für den Geschäftserfolg, dadurch tatsächlich gestiegen war.

In diesem Sinne wäre es sinnvoll, die Algorithmus-Motivation zu entfernen – oder vielleicht könnten Sie versuchen, Algorithmus-Anreize für bestimmte Post-Typen wie politische Diskussionen zu entfernen und gleichzeitig die Reichweite von ansprechenderen Posts von Freunden zu maximieren, die sowohl den Engagement-Zielen als auch der Spaltung gerecht werden Anliegen.

Darauf hat Dave Gillis von Facebook, der im Produktsicherheitsteam der Plattform arbeitet, in einem Tweet-Thread als Antwort auf die Enthüllungen hingewiesen.

Laut Gillis:

„ Am Ende des WSJ-Beitrags über das algorithmische Feed-Ranking wird – fast nebenbei – erwähnt, dass wir vom Engagement-basierten Ranking für Bürger- und Gesundheitsinhalte im News Feed abgewichen sind. Aber Moment mal – das ist eine große Sache, oder? Es ist wahrscheinlich vernünftig, beispielsweise Katzenvideos und Babyfotos nach Likes usw. zu ordnen, andere Arten von Inhalten jedoch mit größerer Sorgfalt zu behandeln. Und das ist in der Tat das, wofür sich unsere Teams ausgesprochen haben: Verwenden Sie unterschiedliche Ranking-Signale für Gesundheits- und Bürgerinhalte und priorisieren Sie Qualität + Vertrauenswürdigkeit über Engagement. Wir haben hart daran gearbeitet, die Auswirkungen zu verstehen, die Führung an Bord zu holen – ja, Mark auch – und es ist eine wichtige Änderung. ”

Dies könnte ein Weg nach vorne sein, indem verschiedene Ranking-Signale für verschiedene Arten von Inhalten verwendet werden, die dazu beitragen können, eine optimale Verstärkung von Inhalten zu ermöglichen, die positive Benutzerbindung zu steigern und gleichzeitig die Motivation für bestimmte Akteure zu verringern, spaltendes Material zu veröffentlichen, um in die Algorithmen einzuspeisen erreichen.

Funktioniert das? Auch hier ist es schwer zu sagen, denn die Leute könnten immer noch Beiträge teilen, sie könnten immer noch Material online kommentieren und neu verteilen, es gibt immer noch viele Möglichkeiten, wie die Verstärkung außerhalb des Algorithmus selbst erfolgen kann.

Im Wesentlichen haben beide Vorschläge Vorzüge, dass soziale Plattformen verschiedene Arten von Inhalten unterschiedlich behandeln könnten oder dass Algorithmen eliminiert werden könnten, um die Verstärkung solchen Materials zu reduzieren.

Und wie Haugen feststellt, ist es wichtig, sich auf die Systeme selbst zu konzentrieren, da inhaltsbasierte Lösungen verschiedene Komplexitäten eröffnen, wenn das Material in anderen Sprachen und Regionen veröffentlicht wird.

„Im Fall von Äthiopien gibt es 100 Millionen Menschen und sechs Sprachen. Facebook unterstützt nur zwei dieser Sprachen für Integritätssysteme. Diese Strategie, sich auf sprachspezifische, inhaltsspezifische Systeme zu konzentrieren, damit KI uns retten kann, ist zum Scheitern verurteilt.“

Vielleicht wäre das Entfernen von Algorithmen oder zumindest das Ändern der Vorschriften für die Funktionsweise von Algorithmen eine optimale Lösung, die dazu beitragen könnte, die Auswirkungen negativer, wütend machender Inhalte in der gesamten Social-Media-Sphäre zu verringern.

Aber dann sind wir wieder beim ursprünglichen Problem, das der Algorithmus von Facebook lösen sollte – im Jahr 2015 erklärte Facebook, dass es den Newsfeed-Algorithmus nicht nur zur Maximierung der Benutzerinteraktion benötigt, sondern auch, um sicherzustellen, dass die Leute alle Updates der meisten sehen Relevanz für sie.

Wie es erklärt wurde, hatte der durchschnittliche Facebook-Nutzer zu diesem Zeitpunkt rund 1.500 Beiträge, die an einem bestimmten Tag in seinem News Feed erscheinen konnten, basierend auf den Seiten, die er mochte, und seinen persönlichen Verbindungen – während für einige aktivere Nutzer , diese Zahl lag eher bei 15.000. Es ist einfach nicht möglich, jeden Tag jedes einzelne dieser Updates zu lesen, daher lag der Hauptfokus von Facebook mit dem anfänglichen Algorithmus darauf, ein System zu schaffen, das die besten und relevantesten Inhalte für jeden Einzelnen aufdeckt, um den Benutzern das Beste zu bieten fesselnde Erfahrung, und sorgen Sie anschließend dafür, dass sie wiederkommen.

Wie Chris Cox, Chief Product Officer von Facebook, gegenüber dem Time Magazine erklärte:

„Wenn Sie alles bewerten könnten, was heute auf der Erde passiert ist, was irgendwo von einem Ihrer Freunde, einem Familienmitglied oder einer Nachrichtenquelle veröffentlicht wurde, und dann die 10 auswählen könnten, die heute am wichtigsten sind, das zu wissen, wäre das wirklich cool Service, den wir aufbauen können. Das ist wirklich das, was unser News Feed werden soll."

Der Newsfeed-Ansatz hat sich seitdem stark weiterentwickelt, aber die grundlegende Herausforderung, die er lösen sollte, bleibt bestehen. Die Leute haben zu viele Verbindungen, sie folgen zu vielen Seiten, sie sind Mitglieder in zu vielen Gruppen, um jeden Tag alle ihre Updates zu erhalten. Ohne den Feed-Algorithmus verpassen sie relevante Posts, relevante Updates wie Familienankündigungen und Geburtstage, und sie werden sich einfach nicht so sehr an der Facebook-Erfahrung beteiligen.

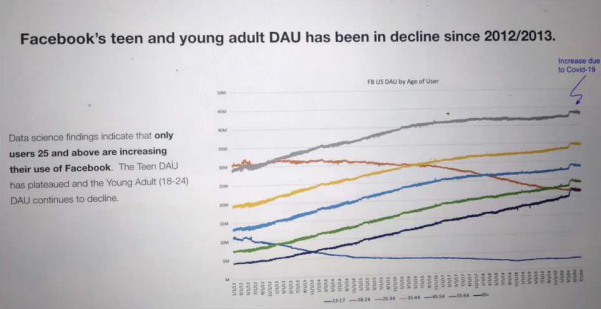

Ohne den Algorithmus wird Facebook verlieren, da es nicht gelingt, die Wünsche des Publikums zu optimieren – und wie in einem anderen der als Teil der Facebook-Dateien geteilten Berichte hervorgehoben wird, sieht es tatsächlich bereits einen Rückgang des Engagements in einigen demografischen Untergruppen.

Sie können sich vorstellen, dass, wenn Facebook den Algorithmus eliminieren oder dazu gezwungen wäre, seine Richtung zu ändern, dieser Graph mit der Zeit nur noch schlechter wird.

Zuck und Co. dürften daher von dieser Lösung nicht begeistert sein, sodass ein Kompromiss, wie der von Gillis vorgeschlagene, das Beste sein dürfte, was zu erwarten ist. Aber das bringt seine eigenen Mängel und Risiken mit sich.

In jedem Fall ist anzumerken, dass sich der Fokus der Debatte breiter auf Algorithmen verlagern muss, nicht nur auf Facebook allein, und ob es tatsächlich einen praktikablen, praktikablen Weg gibt, die Anreize für algorithmenbasierte Systeme zu ändern, um die Verbreitung zu begrenzen von mehr spaltenden Elementen.

Denn das ist ein Problem, egal wie Facebook oder sonst jemand versucht, es zu drehen, weshalb Haugens Haltung wichtig ist, da sie durchaus der Funke sein könnte, der uns zu einer neuen, nuancierteren Debatte um dieses Schlüsselelement führt.