GPT-4: GPT-4 とは? OpenAI の最新モデルについて知っておくべきことすべて

公開: 2023-03-24OpenAI は、その画期的な言語モデルで AI の世界に波を起こしてきました。その最新の作成は、これまでで最も印象的であると約束されています。 モデルのGPTファミリーに追加された最新のGPT-4を紹介します。

GPT-4 は 2023 年 3 月 14 日に打ち上げられて以来、新しいイメージ設定と強化された推論能力で人々の期待を吹き飛ばしてきました。 より正確で安全な応答により、ユースケースの幅も広がりました。

このブログでは、この最新の言語モデルについて知っておくべきことをすべて明らかにし、次のような質問に答えます。

- GPT-4とは?

- GPT-4 は GPT-3.5 とどう違うのですか?

- GPT-4 の使い方

もっと!

GPT-4とは?

GPT-4 は、OpenAI によってトレーニングされた最新の言語モデルです。 新しい画像入力設定を追加することで、人間と AI の相互作用の新しい次元を解き放ちます。 写真やドキュメントを添付して、出力としてテキストを生成できるようになりました。

GPT-4 は、GPT-3.5 よりも信頼性が高く、創造的であり、より微妙な指示を処理できます。 タスクの複雑さが十分なしきい値に達すると、2 つのモデルの違いがより明確になります。

安全性の観点から、GPT-4 は破ることのできない堅牢な使用ガイドラインを作成しました。 GPT-3.5 と比較して、GPT-4 では有害で誤解を招くコンテンツを作成する可能性が低くなります。

GPT-4 は GPT-3 および GPT-3.5 と比較してどうですか?

GPT-4 は、GPT-3.5 および GPT-3 よりもはるかに優れた言語モデルです。 より多くのパラメーターがあるからではなく、モデルの信頼性と安全性を高めるために広範囲にトレーニングされているためです。 GPT-3.5 と比較して GPT-4 が際立っている領域の一部を以下に示します。

GPT-4 はマルチモーダルです

GPT-3 や GPT-3.5 を含む以前の GPT モデルはすべてテキストのみでした。つまり、プロンプトを入力してテキスト出力を受け取っていました。 GPT-4 では、入力セットがテキストと画像に拡張されました。 ドキュメント、写真、図、スクリーンショットを添付することができ、GPT-4 は画像からすべての情報を抽出し、プロンプトに基づいて回答することができます。

この機能はまだ公開されていませんが、画像モデルを ChatGPT に統合する方法を見つけた人もいます。 その一例を以下に示します。ChatGPT は冷蔵庫内の食品を分析し、レシピを生成します。

GPT-4 は、ChatGPT にフックされると、さらに ChatGPT になります。 ChatGPT-4 を使用してコンテンツ作成プロセスを自動化する方法の詳細をご覧ください。

GPT-4 に冷蔵庫の写真を渡して、60 秒以内に料理のレシピを考え出すように依頼した方法を次に示します。 pic.twitter.com/CLBCWTJEab

— スダルシャン (@sudu_cb) 2023年3月15日

GPT-4 はより長いコンテキストを理解します

ChatGPT の最大の問題の 1 つは、より長いコンテキストを処理できないことでした。

3000 ワードを超えると、入力テキストを短くするよう求めるポップアップが生成されます。 GPT-3 の場合、最大リクエストは 2000 ワードでした。

GPT-4 を使用すると、25,000 語を超えるリクエストを行うことができ、拡張された会話、ドキュメント分析、および長い形式のコンテンツの作成に対してモデルの信頼性を高めることができます。 より多くのコンテキストを持つことは、出力がより正確になり、モデルが特定の詳細を追跡できなくなることを意味します。

これを示す例を次に示します。

GPT-4 はより複雑なタスクを処理します

GPT-4 は、GPT-3.5 よりも高度な推論タスクを成功させることができます。 OpenAI が実施したテストに基づくと、GPT-4 はすべての模擬試験で 90% 以上のスコアを獲得しています。 競争力のある司法試験と SAT 試験でも、GPT-4 は GPT-3.5 よりも高いパーセンタイルを取得できました。

現実の世界では、GPT-4 の知的能力をさまざまなアプリケーションに利用できます。 より複雑なゲームを構築できます。 AI を使用して、ジェネレーティブ アートのスクリプトとアルゴリズムを記述できます。 などなど! GPT-4 の複雑な推論を示す例の 1 つを以下に示します。

車にGPT-4を接続しました🚗

— カシム・ムニエ (@qasimmunye) 2023年3月17日

追加のコンテキスト (8k と 4k) は、複雑なユースケースに非常に役立ちます - 32k で遊ぶのが待ちきれません! @gdb pic.twitter.com/tjSjQzULAJ

GPT-4 は AI 動作の微調整を可能にします

GPT-3 などの以前のモデルでは、個性的なチャットボットを構築することはできませんでした。つまり、特定の境界内でチャットボットを操作することはできませんでした。 たとえば、チャットボットをインタビュアーにしたい場合、いくつかのメッセージの後、会話の流れが変わる可能性があります.

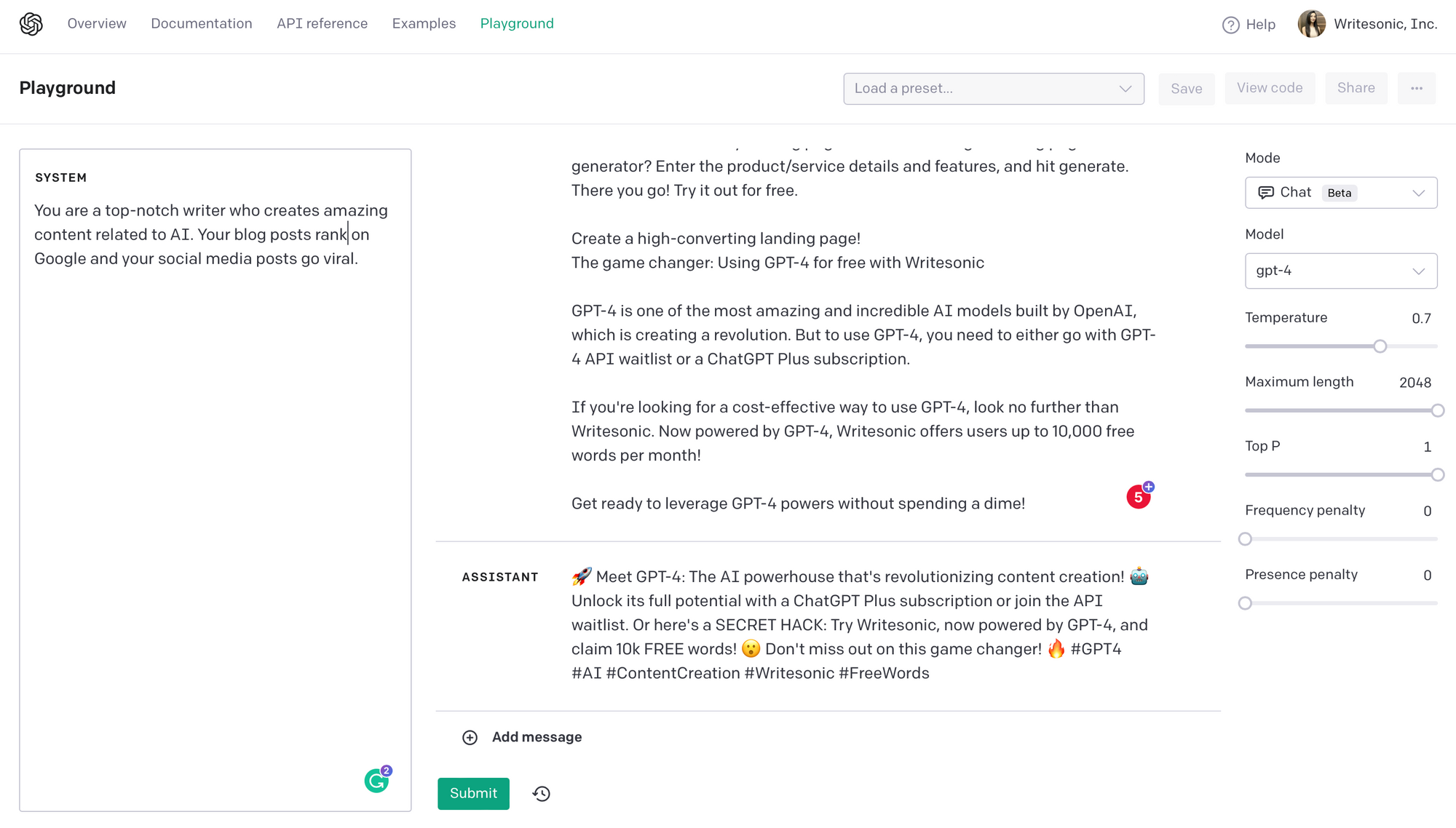

主な理由は、GPT-3 および GPT-3.5 モデルでシステム プロンプトを入力できなかったことです。 システム プロンプトは、必要なパーソナリティのフレームワークを作成し、会話を変更しようとしてもチャットボットの一貫性を維持できることを意味します。 システム プロンプトのこの機能は、GPT-3.5 ターボおよび GPT-4 モードで使用できます。

GPT-4 では、OpenAI はこの AI 動作の操縦性の微調整を呼び出しています。

たとえば、数学の家庭教師として機能するチャットボットが必要だとします。 あなたは数学を学び、それが得意になりたいです。 したがって、モデルからの直接的な回答は必要なく、自分で考えて正しい解決策にたどり着く必要があります。 このような条件と境界を作成することで、AI の動作を微調整しています。

GPT-4 は実行コストが高い

GPT-4 がすべてのベンチマークで以前のモデルよりも優れている場合、GPT-4 のコストが高くなるのは当然のことです。 より長いコンテキストを理解し、より創造的な出力を生成できるため、クエリを実行するコストは GPT-3 および GPT-3.5 よりも高くなります。

GPT ファミリの最初の大きな飛躍は、1,750 億を超えるパラメーターを持つ GPT-3 によって実現されました。 GPT-3 では、1,000 トークンあたり 0.02 ドル未満の費用がかかります。 次のバージョンである GPT-3.5 では、価格を 1,000 トークンあたり 0.002 ドルに引き下げることで、コスト効率が大幅に向上しました。

GPT-4 の場合、複数のコンテキスト ウィンドウがあるため、計算が少し複雑になります。 8K コンテキスト ウィンドウの場合、GPT-4 のコストは 1,000 トークンあたり 0.03 USD ですが、32K ウィンドウでは 1,000 トークンあたり 0.06 USD のコストがかかります。 これらの価格はプロンプト トークンの価格であることを忘れないでください。 完了トークンにも追加コストがかかります。

したがって、GPT-4 は以前のモデルよりもはるかに高度です。 ただし、その機能がすべてのユース ケースに適しているとは限りません。 つまり、プロンプトを送信する前に、使用するモデルを慎重に選択する必要があります。 最初は小さく見えるかもしれませんが、これらのコストは時間の経過とともに大幅に増加します。

GPT-4 | GPT-3.5 | GPT-3 | |

モデルの種類 | テキストとビジュアルの両方 | テキストのみ | テキストのみ |

パラメータ数 | 1兆(未確認) | 1750億 | 1750億 |

API リクエストあたりのトークン制限 | 32,000トークン | 4,096トークン | 2,048トークン |

1,000 トークンあたりのコスト | $0.06 | $0.002 | $0.02 |

サブスクリプション | ChatGPT プラス加入者 | 無料 | 無料 |

GPT-4 の制限事項

GPT-4 はすべての NLP ベンチマークで GPT-3.5 よりも優れていますが、それでも同じ一連の制限があります。 ハイステークスのコンテキストで使用する際に覚えておくべき重要なもののいくつかを以下に示します。

リアルタイムの洞察

GPT-4 は、Chatsonic やその他の ChatGPT の代替手段のようなリアルタイムの洞察を提供することはできません. これは主に、トレーニング前のデータが 2021 年 9 月に打ち切られたためです。

そのため、過去 6 か月間に GPT-4 トレーニングが行われましたが、使用された基本データは同じであり、インターネットに接続されていません。

幻覚

GPT-4 は、幻覚を見たり、でっちあげたりする傾向があります。 以前のモデルと比較して、GPT-4 は OpenAI の事実性評価で 19% 多くのスコアを獲得しました。 そのため、AI モデルの出力への依存が状況にとって重要な場合、GPT-4 に依存することはできません。

表面的には、モデルがコンテキストをよりよく理解しているため、出力は説得力のあるものになる可能性があります。 しかし、アウトプットは誤解や誤報の結果である可能性があります。 したがって、タスクを続行する前に、常に出力を再確認し、ソースを確認する必要があります。

AI アライメント

GPT-4 が AGI ステータスに到達するまでには長い道のりがあるため、人間の価値観に対する AI の調整は依然として懸念事項です。

OpenAI は、ドメイン エキスパートを使用して、望ましくないコンテンツを生成する可能性を減らすために多大な努力を払っています。 これらの専門家は、GPT-4 への安全でない入力をより適切にラベル付けするために、調査結果を共有しました。 これに続いて、GPT-4 が安全でない入力を拒否し、公正な要求を許可したことに対して報酬を受け取る、追加の報酬信号を使用した強化トレーニングが行われました。

AI の安全性と調整に向けたこれらの取り組みにより、GPT-4 が有害なコンテンツを生成する可能性が 82% 低くなると予測されています。 ただし、OpenAI は、GPT-4 をジェイルブレイクして使用ガイドラインに違反する可能性があることを認めています。 そのため、そのようなケースを監視し、より安全な GPT モデルを最適化するのは OpenAI にかかっています。

画像生成

GPT-4 は最新の画像入力設定を備えたマルチモーダルですが、その出力はテキストのみに制限されています。 したがって、画像を分析することはできますが、生成することはできません。

OpenAI がこのルートに進んだ考えられる理由の 1 つは、機能をゆっくりと安全に展開したいからです。 OpenAI の CEO である Sam Altman は、ベンチャー キャピタルのイベントで次のように述べています。

GPT-4 でできること

GPT-4 の両側がどのように見えるかがわかったので、この新しいテクノロジをどのように活用できるかを見ていきましょう。 これまでに発見されたエキサイティングなユースケースのいくつかを以下に示します。

本を書く

あなたはその権利を読んだ!

GPT-4 を使用すると、最大 25,000 語を生成および分析できるため、冗長性のない長い形式のコンテンツを作成できます。

それがどのように見えるか疑問に思いますか? リード・ホフマンが書いた Impromptu という最新の本をチェックしてください。 GPT-4 で書かれた最初の本です。

@OpenAI の最新かつ最も強力な大規模言語モデルを使って新しい本を書きました。

— リード・ホフマン (@reidhoffman) 2023 年 3 月 15 日

それは Impromptu と呼ばれます: AI を通じて私たちの人間性を増幅します。

私の知る限り、これは GPT-4 で書かれた最初の本です。

これがすべての始まりです… https://t.co/M19e1ISGpb

ビデオゲームを作成する

ゲームの作成は多くの人にとって魅力的です。 しかし、始めるには特定の専門知識が必要です。 もう違います!

GPT-4 は、ビデオ ゲームのコードを記述し、テストと展開をガイドします。 GPT-4 が Pong のゲームを 60 秒未満で再現した最新の例を見てください。 結果はここからさらに良くなり、ゲーム開発の分野に大きな違いをもたらすでしょう.

AGI でなくてもかまいません。GPT-4 は信じられないほど革新的なテクノロジです。

— ピエトロ・スキラーノ (@skirano) 2023年3月14日

Pong のゲームを 60 秒以内で再現しました。

初めての試みでした。

物事は決して同じではありません。 #gpt4 pic.twitter.com/8YMUK0UQmd

スポット コードの脆弱性

前述のように、GPT-4 はより長いコンテキストを分析できます。 コード検索に適用すると、セキュリティの脆弱性やその他のバグを見つけるのに役立ちます。 この使用例の良い例は、GPT-4 に Ethereum スマート コントラクトを悪用する方法を見つけるように依頼することです。

ライブ イーサリアム コントラクトを GPT-4 にダンプしました。

— コナー (@jconorgrogan) 2023年3月14日

すぐに、多くのセキュリティの脆弱性が強調され、コントラクトが悪用される可能性のある表面領域が指摘されました。 次に、契約を悪用できる特定の方法を検証しました pic.twitter.com/its5puakUW

モバイルアプリの開発

モバイルアプリのアイデアはありますか? 建てる。 それ。 今。

GPT-4 は、コードの記述、デバッグ、デプロイを行うことができます。 チャットボットを正しい方向に向けるだけです。 これは、AI が正しい改善を行えるように、詳細で具体的なプロンプトをコンテキストとともに提供する必要があることを意味します。 これを行う方法をより明確にするには、次の例を確認してください。

gpt4 さん、毎日 5 つの新しい映画 + 予告編 + どこで見るかをお勧めする iPhone アプリを作ってください。

— モーテン・ジャスト (@mortenjust) 2023年3月15日

私たちが進むにつれて、私の野心は大きくなりました👇 pic.twitter.com/oPUzT5Bjzi

独自の ChatBot を構築する

特定のタスクに合わせて調整されたチャットボットを作成することで、数え切れないほどの時間を節約できます。 あなたが開発者であれば、すべてのドキュメントを知っているチャットボットを作成できます。 このように、答えを探すのに時間を無駄にする必要はありません。 代わりに、個人のチャットボットに直接質問して、建物に戻ることができます。 同様の使用例を以下に示します。

✨ 私はこの 48 時間、GPT-4 が @solana バリデーターのコードベース全体を読み取ってドキュメントを作成できるように費やしたので、@aeyakovenko はその必要がありません。

— サム・ホーガン (@0xSamHogan) 2023 年 3 月 19 日

https://t.co/spDDFkqtcC の紹介 — コードだけで訓練された AI 搭載のチャットボットは、深い回答が可能です https://t.co/RLpWc2Y85A… pic.twitter.com/2VGsVmmylF

ChatGPT の最良の代替手段であり、GPT-4 を搭載した Writesonic の ChatSonic には、ビジネス向けのコード不要の ChatSonic AI ボットがあり、ブランドの詳細を入力するだけで Web サイトに統合できます。 この AI チャットボットは、背後に人がいなくても人間らしい会話をします。

その他の潜在的なユースケース

GPT-4 には、さまざまな業界で真のゲームチェンジャーになる可能性がたくさんあります。 新しい画像設定により、人間とのやり取りをまったく新しいレベルに引き上げることができます。 たとえば、画像の解釈、分類、および翻訳に GPT-4 を使用できます。

GPT-4 は、より長いコンテキスト ウィンドウで個性を維持することにも優れており、毎回より魅力的で異なる会話につながります。 そのため、GPT-4 に関してはまだ未知の領域にあり、近い将来、さらに多くの画期的な使用例が見られるでしょう。

GPT-4 の使用方法を理解したところで、開始を妨げているものは何ですか?

企業はどのように GPT-4 を製品に統合していますか?

GPT-4 はもはや単なる AI チャットボットではありません。 その力は、世界クラスの製品やサービスに見られるようになります。

OpenAI はすでにさまざまな企業と協力して GPT-4 を組み込んでおり、他の多くの企業がビジネス モデルを将来にわたって保証するために並んでいます。 GPT-4 を統合している企業の一部を以下に示します。

デュオリンゴ

Duolingo は OpenAI と提携して、言語教育プラットフォームをよりパーソナライズしました。 最新のサブスクリプション モデル Duolingo Max を使用すると、AI を活用した独自の語学教師を持つことができます。

新しいサブスクリプションは、学習を次のレベルに引き上げる 2 つのユニークな機能を提供します。 まず、レッスンの回答を詳細に説明する「私の回答を説明する」機能があります。 間違った回答をした場合、この新しい機能を使用して、より多くのコンテキストを求めることができるようになりました。

2 つ目の機能はロールプレイです。 学ぶ言語ごとに、異なる性格を持つことになります。 そして、このキャラクターは現実世界の会話に参加し、あらゆる状況であらゆる可能性に備えることができます.

AI と教育は良い組み合わせです。

— デュオリンゴ (@duolingo) 2023年3月14日

Duolingo Max のご紹介です。 最新の @OpenAI テクノロジーで開発された 2 つの機能、Explain My Answer と Roleplay を通じて、AI を利用した自分だけの言語チューターにアクセスできる、Super より上のサブスクリプション層です。

詳細は🧵で pic.twitter.com/L0qwMVd9dB

ビー・マイ・アイズ

Be My Eyes は、目の不自由な人と視覚障害者をつなぎ、自立した生活を送れるようにするモバイル アプリです。 OpenAI は Be My Eyes と提携して、アプリをよりユーザーフレンドリーにしました。

GPT-4 の最新の入力画像設定を使用することで、OpenAI はバーチャル ボランティアと呼ばれる Be My Eyes の新機能を有効にしました。 この機能は、ユーザーが物を識別し、視覚的な支援が必要な場合に役立ちます。 ユーザーは仮想ボランティアに画像を送信することで必要な支援を受けることができ、音声メッセージが返されます。

Be My Eyes での AI の使用例は無限です。 Web ページの要約からオンライン ショッピングのサポートの提供まで、GPT-4 は視覚障害者の生活の大きな穴を真に埋めます。

@OpenAI の GPT-4 言語モデルを搭載したデジタル ビジュアル アシスタント、Virtual Volunteer™ を発表できることを嬉しく思います。 バーチャル ボランティアは、画像に関するあらゆる質問に答え、アプリ内でリアルタイムで瞬時に視覚的な支援を提供します。 #アクセシビリティ #インクルージョン #CSUN pic.twitter.com/IxDCVfriGX

— ビーマイアイズ (@BeMyEyes) 2023年3月14日

ストライプ

Stripe は OpenAI のチャットボットを使用して、製品の有効性と全体的なユーザー エクスペリエンスを強化しています。 1 つには、AI を使用して詐欺を減らし、コンバージョン率を向上させています。 また、Stripe は顧客サポートに AI チャットボットを使用して、エージェントがより迅速な解決方法を見つけられるようにします。

GPT-4 により、Stripe は運用をさらに合理化する予定です。 最初に見つかったユース ケースは、AI を活用したドキュメントです。 Stripe は、GPT-4 を使用して開発者用資料を作成しました。これにより、開発者はドキュメントのページを掘り下げることなく答えを見つけることができます。 これにより、情報検索に費やす時間が短縮され、開発者はアプリケーションの構築に専念できます。

OpenAI + ストライプ: https://t.co/lToKb1sQXp. pic.twitter.com/MwKn0CvWbu

— ストライプ (@stripe) 2023年3月15日

カーンアカデミー

教育業界は、GPT-4 のようなモデルによって破壊されています。 学生向けのチートコードになっています。 そのため、この最新の AI の進歩に前向きな光を当てるために、Khan Academy は OpenAI と協力してパイロット プロジェクトを開始しています。

パイロット ランでは、学生と教師がアクセスできるようになります。 学生の場合、チャットボットが家庭教師になります。 チャットボットは、直接的な回答を提供するのではなく、生徒が正しい方向に考え、自分で解決策にたどり着くのに役立ちます。 教師の場合、チャットボットは管理作業を支援し、教育に集中する時間を増やすことができます。

聞こえたの? 👀 Khan Academy は @OpenAI の GPT-4 を使用して学習の未来を形作っています。

— カーンアカデミー (@khanacademy) 2023年3月14日

今日からサインアップして、AI を活用したガイド、Khanmigo をテストできます。 学習者向けの家庭教師。 教師のアシスタント。

私たちと一緒に探検しましょう! ✨

払わないで

DoNotPay は、プラットフォーム上のさまざまな機能のために GPT-4 を統合することを計画しています。 GPT-4 は入力として画像を受け入れるため、DoNotPay はこれを使用して医療費をスキャンし、予期せぬ請求書や高額な薬を特定したいと考えています。

さらに、チャットボットの弁護士は、GPT-4 を使用してロボコールに対する訴訟を起草したいと考えています。 以前のモデルでは、高度な法務に対応できなかったため、これは不可能でした。 しかし、GPT-4 API を使用すると、数分でロボコールを書き起こし、訴訟を起こすことができます。

DoNotPay は、GPT-4 を使用して「ワンクリック訴訟」を生成し、1,500 ドルでロボコールを訴える作業を行っています。 電話がかかってきて、ボタンをクリックすると、通話が文字に起こされ、1,000 語の訴訟が発生することを想像してみてください。 GPT-3.5は十分ではありませんでしたが、GPT-4は非常にうまく機能します: pic.twitter.com/gplf79kaqG

— ジョシュア・ブラウダー (@jbrowder1) 2023 年 3 月 14 日

チャットソニック

欠点に対処することなく GPT-4 のパワーを活用したい場合は、ChatSonic が最適です。

ChatSonic は、GPT-4 を搭載した AI チャットボットです。 ただし、GPT-4 モデルとは異なり、ChatSonic は Google 検索を統合することでリアルタイムの洞察を提供します。 画像生成も可能です。

さらに、ChatSonic を使用すると、チャットボットのパーソナリティを変更できて便利です。 GPT-4 のように詳細なプロンプトを入力する代わりに、チャットしたいキャラクターを選択するだけです!

ChatSonic を使用した音声検索もあります。 もう入力する必要はありません。 この機能は時間を節約するだけでなく、会話をよりインタラクティブにします。 ChatSonic はモバイルで利用できるため、ユーザー エクスペリエンスも大幅に向上します。

ライトソニック

最高の AI ライティング ツールがアップグレードされました。

Writesonic は現在、GPT-4 のすべての機能を備えており、AI ライターの世界で優れた選択肢となっています。 GPT-4 はより長いコンテキストを処理できるため、ブログやエッセイの作成に Writesonic をより効果的に使用できます。

さらに、GPT-4 はより創造的になり、Writesonic はより少ない冗長性でアイデアを生成する際の信頼性を高めました。 これは、ブログのタイトル、短編小説、広告コピーがよりユニークに感じられることを意味し、比較や選択が容易になります.

追加機能に加えて、Writesonic はさまざまなコンテンツ形式のテンプレートを作成することで、作業をさらに簡単にします。 したがって、空欄を埋めて、好きなものを選択するだけです。

GPT-4 は無料で利用できますか?

まだ。

OpenAI は最終的にすべての人に GPT-4 アクセスを提供しますが、現在のところ ChatGPT Plus サブスクライバーのみに提供しています。 したがって、GPT-4 アクセスを取得する方法を知りたい場合は、プレミアム プランに加入し、月額 20 ドルを支払うだけです。

ただし、落とし穴があります。 ChatGPT Plus 内で GPT-4 がオンになっている場合、3 時間に 25 件を超えるメッセージを送信することはできません。 これはほとんどのユーザーにとって問題にはなりませんが、ChatGPT はシステム パフォーマンスに関してまだ制限があることに注意することが重要です。

日常的な使用を超えて、GPT-4 を使用してアプリケーションやサービスを構築したい場合は、GPT-4 ベータ プログラムに申し込む必要があります。 GPT-4 API の待機リストにアクセスして詳細を入力するだけです。 プログラムに招待された場合、API アクセスを取得するための次の手順を説明するメールが届きます。

アプリケーションを送信する際に覚えておくべき主なことは、AI での以前の経験と、OpenAI の貴重なパートナーになる方法を強調することです。 両方をうまくやれば、目立つようになり、すぐにアクセスできるようになります。

ChatGPT Plus または API アクセスのいずれかを手に入れることができなかった場合は、Chatsonic を試してみてください。 Chatsonic は、欠点のない GPT-4 のすべての天才を提供します。最高の部分は、サインアップ時に 10,000 の無料の単語を取得できることです。

始めたばかり

GPT-4 のような GPT の巨人が率いる AI 蜂起が話題になっています。 人間は初めて、首から機械の息が漏れるのを感じます。 不完全ではありますが、反復するたびに、これらの言語モデルは進化し、より人間的な傾向を誇示します。

GPT-4 を使用すると、これまでに見られた大幅な改善が見られます。 画像の分析からより長いコンテキストの理解まで、GPT-4 はチャットボットとして卓越した能力を発揮しています。 さらに重要なことは、適切な安全性とプライバシー ポリシーを使用することで、より安全なテクノロジになったことです。

GPT-4 の現実世界への影響も重要です。これは主に、人々が OpenAI の API を使用して新しいアプリケーションを構築し、既存のアプリケーションを効率化できるためです。 さらに、人々はパーソナライズされた代替手段を好むため、カスタムのチャットボットとアプリが標準になります。

ただし、予測不可能な性質など、GPT-4 にも欠点があります。 OpenAI はそのトレーニング セット、アーキテクチャ、およびエネルギー消費に関する詳細を開示していないため、その成功と失敗を説明し、社会への影響を予測する方法がわかりません。

結論として、GPT-4 は GPT ファミリーへの印象的な追加であり、AI 技術の急速な進歩の証です。 しかし、人間レベルで実行するには、まだいくつかの課題に直面しています。 したがって、これから起こることに備えたい場合は、これらのモデルに適応し、それらを有利に利用する必要があります。