Ce que vous devez savoir sur l'annotation d'images dans l'apprentissage automatique

Publié: 2022-11-09Contrairement aux humains, les systèmes informatiques ne peuvent pas détecter, classer et identifier les images de manière inhérente. Cependant, les progrès technologiques ont rendu ces tâches possibles grâce à la vision par ordinateur.

En tant que l'une des nombreuses branches de l'intelligence artificielle, la vision par ordinateur s'appuie sur des modèles d'apprentissage automatique supervisés pour voir, identifier et traiter les informations à partir d'entrées visuelles. Il imite la façon dont une personne réagit lorsqu'elle regarde des stimuli.

Article connexe : Éditeur et annotateur PDF Freebie avec qualité garantie - UPDF

Des entreprises manufacturières de premier plan, comme des voitures, des drones et des équipements médicaux, ont intégré cette technologie dans leurs produits. Bien qu'il s'agisse d'un domaine émergent, la valeur du secteur n'est en aucun cas médiocre, estimée à 11,7 milliards USD en 2021. Le secteur pourrait atteindre 21,3 milliards USD d'ici 2030 si l'industrie croît à un taux composé de 6,9 % à partir de cette année.

Si le sujet vous intéresse, vous êtes au bon endroit. Lisez la suite pour en savoir plus sur l'annotation d'images, en commençant par la question la plus évidente.

Qu'est-ce que l'annotation d'images ?

L'annotation d'image fait référence à des processus qui incluent l'étiquetage d'images qui commencent généralement par des entrées humaines et une plate-forme d'outil d'annotation d'image. L'outil facilite l'ajout d'informations à l'image numérique, qui est ensuite traitée par des algorithmes d'apprentissage automatique qui fonctionnent sur l'apprentissage en profondeur.

Ce processus crée des métadonnées, indiquant à la machine quels objets s'y trouvent. L'étiquetage peut également inclure la fourniture d'informations sur la façon dont les éléments de l'image sont liés. L'annotation d'images est la tâche la plus importante pour préparer un modèle d'apprentissage automatique pour la vision par ordinateur. En termes simples, cela permet aux machines de voir et de traiter des images.

Comment ça marche?

L'apprentissage en profondeur fonctionne souvent sur des réseaux de neurones artificiels ou ANN. Ce modèle fonctionne de la même manière que les nerfs du cerveau humain, permettant aux machines d'ajuster et d'adapter leurs sorties comme les humains. Son sous-secteur CNN (Convolution Neural Networks) est souvent utilisé pour résoudre des problèmes liés à la vision par ordinateur.

Avec des données de haute qualité et la bonne plate-forme pour les former, le modèle peut identifier et classer les caractéristiques et les objets, puis générer des descriptions en fonction de la façon dont il a été enseigné.

Telle est l'importance des réseaux de neurones artificiels (ANN) pour jeter les bases des modèles d'apprentissage automatique et d'autres plates-formes d'intelligence artificielle.

Différents types d'annotations d'images

Les ingénieurs en apprentissage automatique et les membres de l'équipe utilisent différents types d'annotations pour des projets spécifiques. Voici les méthodes les plus courantes pour étiqueter les images numériques :

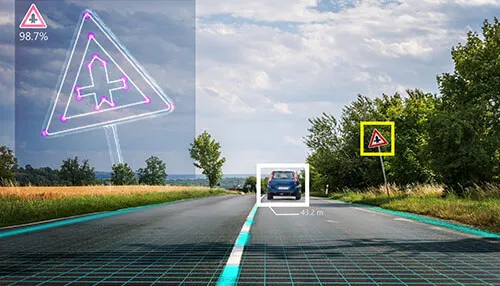

1. Annotations de la boîte englobante

Les annotateurs tracent un cadre autour des objets qu'ils souhaitent étiqueter dans une image spécifique. Il est souvent utilisé pour entraîner des algorithmes à reconnaître des éléments tels que des voitures, des personnes, des animaux, des plantes et bien d'autres.

L'étiquetage peut inclure un seul objet cible, comme tous les véhicules automobiles dans une image. Parfois, il peut s'agir de plusieurs ou de tous les éléments de la photo. Par exemple, outre la reconnaissance d'automobiles, le procédé de traitement peut inclure d'autres objets dans une image. En prenant le modèle ci-dessus, outre les voitures, l'équipe peut également étiqueter les panneaux de signalisation, les panneaux de signalisation, les piétons et autres.

L'annotation de boîte englobante plus avancée comprend l'étiquetage cuboïde ou 3D, qui indique la profondeur ou la distance estimée des objets cibles les uns par rapport aux autres.

2. Annotation de polygone

Dans l'annotation, les limites d'un objet doivent être identifiées pour permettre aux algorithmes d'étiqueter les éléments avec plus de précision. Malheureusement, les objets cibles aux formes irrégulières peuvent être difficiles à placer dans une boîte englobante. Une annotation polygonale est une bonne solution, car elle permet de présenter correctement toutes les arêtes d'un élément.

L'annotation polygonale peut être utilisée dans les applications de reconnaissance faciale, entre autres. C'est similaire à ce que fait votre application de médias sociaux lorsque vous téléchargez une photo et que vous choisissez de taguer vos amis automatiquement.

3. Classement des images

Ce type d'annotation s'appuie sur des algorithmes pour identifier et classer correctement les images. La machine est programmée pour associer un objet et l'étiqueter de la même manière dans cette méthode.

Ce type est utile lorsque vous recherchez une application qui catégorise correctement divers éléments, comme les espèces d'un organisme vivant. La classification des images peut également être utilisée pour repérer des anomalies dans le corps humain, comme c'est le cas pour les systèmes d'imagerie médicale. La clé d'une classification d'images réussie est d'alimenter le modèle en données de haute qualité et de l'entraîner à catégoriser les images plus efficacement.

4. Annotation des polylignes

Cette méthode d'annotation fait référence à la mise d'étiquettes sur des images avec des lignes droites et courbes. Cette méthode d'annotation permet de définir des limites et de détecter les lignes de route et les trottoirs, ce qui la rend utile dans les applications de circulation et de véhicules autonomes. Les algorithmes d'apprentissage automatique sous ce modèle peuvent former des robots pour placer ou emballer soigneusement des articles dans une rangée dans les lignes de fabrication.

5. Segmentation sémantique

Au lieu de se concentrer sur les objets, l'équipe peut étiqueter les photos numériques à l'aide de pixels. C'est pourquoi on l'appelle aussi pigmentation de l'image.

Dans ce processus de formation ML, l'équipe d'annotation recevra des étiquettes de segment au lieu des noms d'objets et des balises. Chaque segment se voit attribuer une couleur spécifique et les annotateurs sont censés dessiner autour d'eux, identifier les pixels et placer les balises ou étiquettes appropriées.

Applications industrielles d'annotation d'images

La vision par ordinateur est utilisée dans plusieurs applications industrielles dans le monde. Le marché est divisé en matériel, logiciel et services. Parmi ces sous-secteurs, le matériel devrait se tailler la part du lion des revenus de ces sous-secteurs. Au fur et à mesure que les fabricants créent des produits plus avancés, les annotateurs peuvent améliorer la précision de la vision par ordinateur pour s'adapter à davantage de fonctions industrielles telles que :

- la reconnaissance faciale

- véhicules autonomes

- véhicules aériens sans équipage ou drones

- fabrication de robots

- applications de cybersécurité

- systèmes de sécurité et de surveillance

- systèmes d'imagerie médicale

- Segmentation de la clientèle du commerce électronique et de la vente au détail

Cette liste n'est pas exhaustive car l'utilisation de la vision par ordinateur continue de se développer.

Conclusion

L'adoption de la vision par ordinateur dans des fonctions telles que les applications de cybersécurité et les systèmes d'imagerie médicale nécessite un investissement substantiel, il est donc important de bien faire les choses du premier coup.

Un projet d'annotation d'images est crucial dans tout projet de vision par ordinateur car il entraîne les modèles d'apprentissage automatique. Les ensembles de données d'entraînement doivent être précis et de haute qualité pour un modèle de ML réussi. Plus important encore, l'équipe de projet doit connaître les bons outils et méthodes d'annotation pour produire les meilleurs résultats.

Références

1. https://www.techtarget.com/searchenterpriseai/definition/convolutional-neural-network

2. https://www.techopedia.com/definition/5967/artificial-neural-network-ann

3. https://www.geeksforgeeks.org/how-to-draw-bounding-boxes-on-an-image-in-pytorch/?ref=gcse

4. https://www.cnet.com/tech/tech-industry/facial-recognition-is-getting-better-at-making-matches-around-face-masks/